Dans l'économie numérique, les données sont le nouvel or noir. Mais que se passe-t-il lorsque ce pétrole est siphonné à votre insu ? Découvrez la menace croissante du web scraping piloté par l'IA, où des agents automatisés extraient des informations sensibles ou confidentielles de sites web, d'API ou de plateformes sans votre consentement. Ce document décrit les risques pour la vie privée, la propriété intellectuelle et l'avantage concurrentiel, ainsi que les stratégies de détection et de prévention. Ce vol silencieux et sophistiqué, orchestré par des techniques de web scraping avancées par l'IA, représente une menace importante et croissante pour les entreprises du monde entier. Il ne s'agit plus des activités de bots maladroites et facilement bloquables d'autrefois. La menace actuelle est un agent automatisé intelligent, capable d'imiter le comportement humain avec une précision effrayante pour voler vos actifs numériques les plus précieux.

Ces attaques ne se limitent pas à la simple collecte de données. Elles ciblent le cœur même de l'avantage concurrentiel d'une entreprise, des modèles de tarification et des listes de clients au code propriétaire et aux plans stratégiques. À mesure que les organisations dépendent de plus en plus des applications web et des plateformes SaaS, le navigateur est devenu le principal théâtre de ces opérations clandestines. Comprendre les mécanismes du scraping par IA est la première étape vers la mise en place d'une défense efficace.

De la force brute à la finesse : l'évolution du web scraping

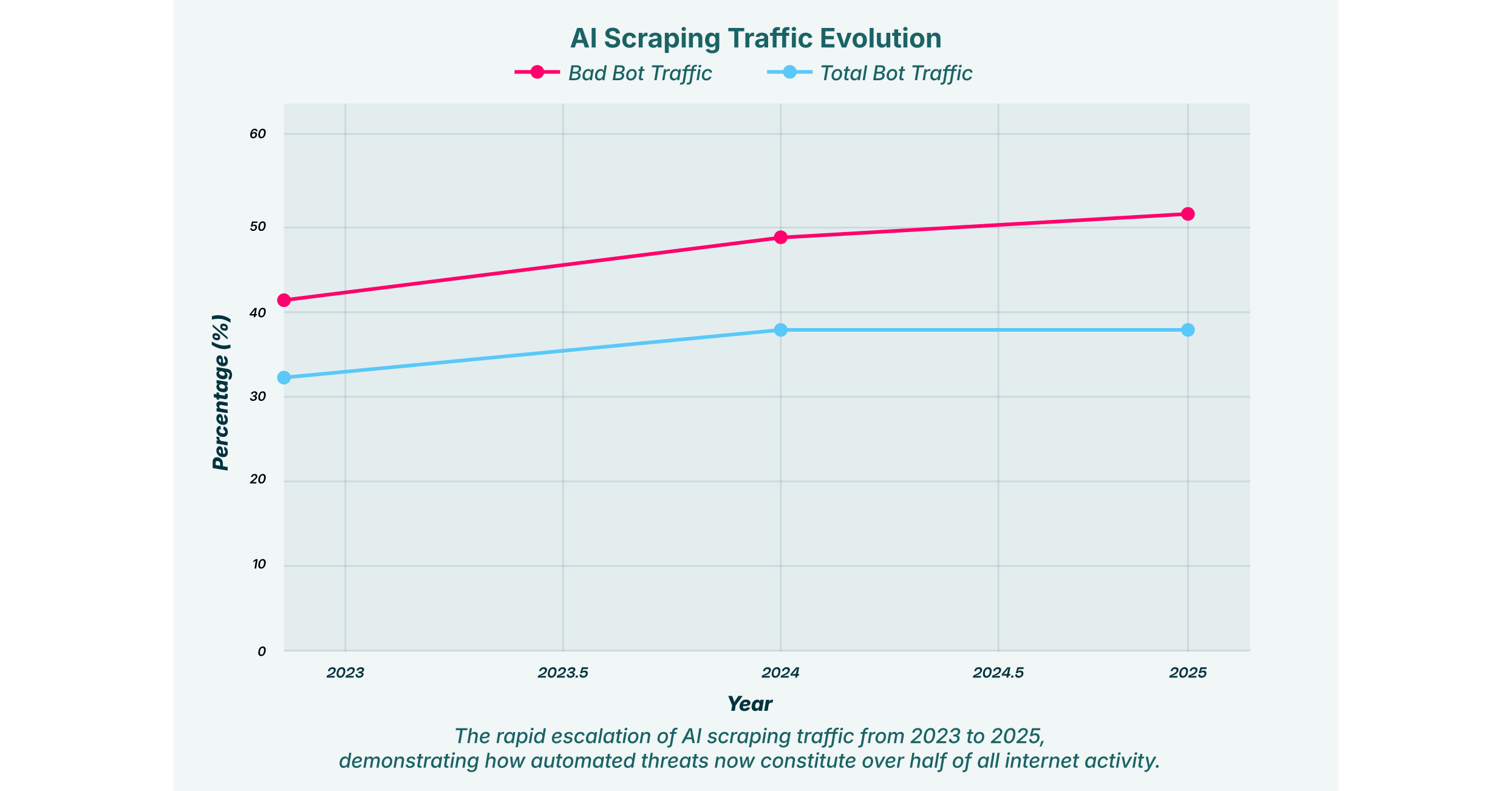

Le web scraping traditionnel reposait souvent sur le volume. Les attaquants déployaient des scripts simples depuis une seule adresse IP pour saturer un site web de requêtes, récupérant ainsi toutes les données publiques disponibles. Ces bots, bruyants et suivant des schémas prévisibles, étaient relativement faciles à identifier et à bloquer par limitation de débit ou mise sur liste noire d'adresses IP. Les équipes de sécurité pouvaient alors contenir l'attaque grâce à des défenses périmétriques classiques.

Cette limite a désormais été franchie.

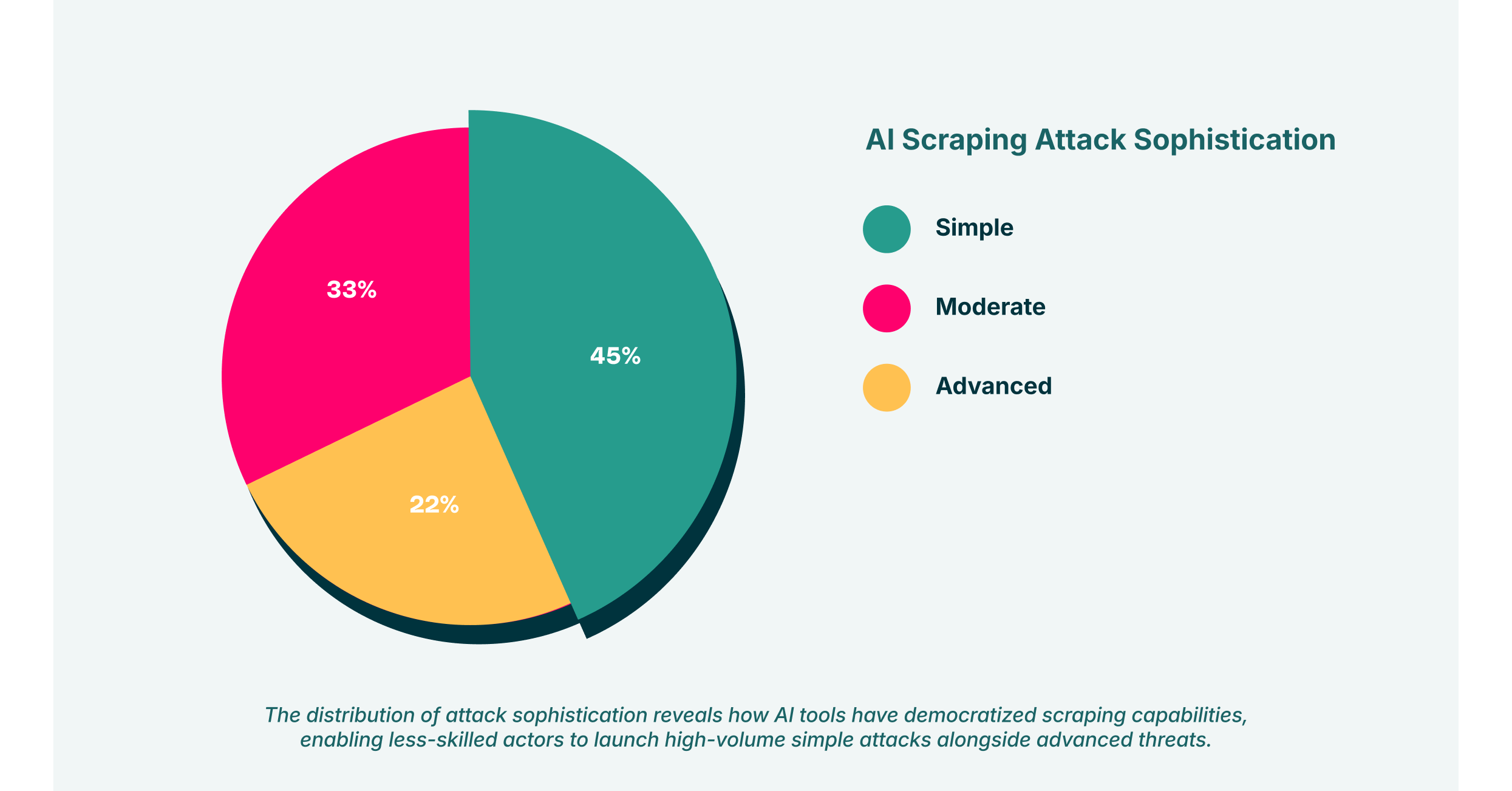

Le scraping par IA moderne opère à un niveau de sophistication différent. Ces scrapers avancés sont conçus pour la furtivité et la persistance, utilisant l'apprentissage automatique pour naviguer dans des environnements web complexes comme le ferait un humain. Ils peuvent :

- Adaptation dynamique : lorsqu’une structure de site Web change, un outil d’extraction de données basé sur l’IA peut s’adapter en temps réel sans intervention humaine, garantissant ainsi un flux de données ininterrompu.

- Imitation du comportement humain : ces agents modifient aléatoirement leurs habitudes de navigation, simulent les mouvements de la souris et résolvent des CAPTCHA complexes qui constituaient autrefois la référence en matière de détection de bots. Ils apparaissent comme du trafic utilisateur légitime, échappant ainsi à tous les filtres de sécurité, à l’exception des plus sophistiqués.

- Attaques distribuées : au lieu de provenir d’une seule adresse IP, les attaques sont distribuées sur de vastes réseaux de proxys résidentiels, rendant le blocage basé sur l’adresse IP totalement inefficace. Chaque requête semble provenir d’un utilisateur différent et légitime.

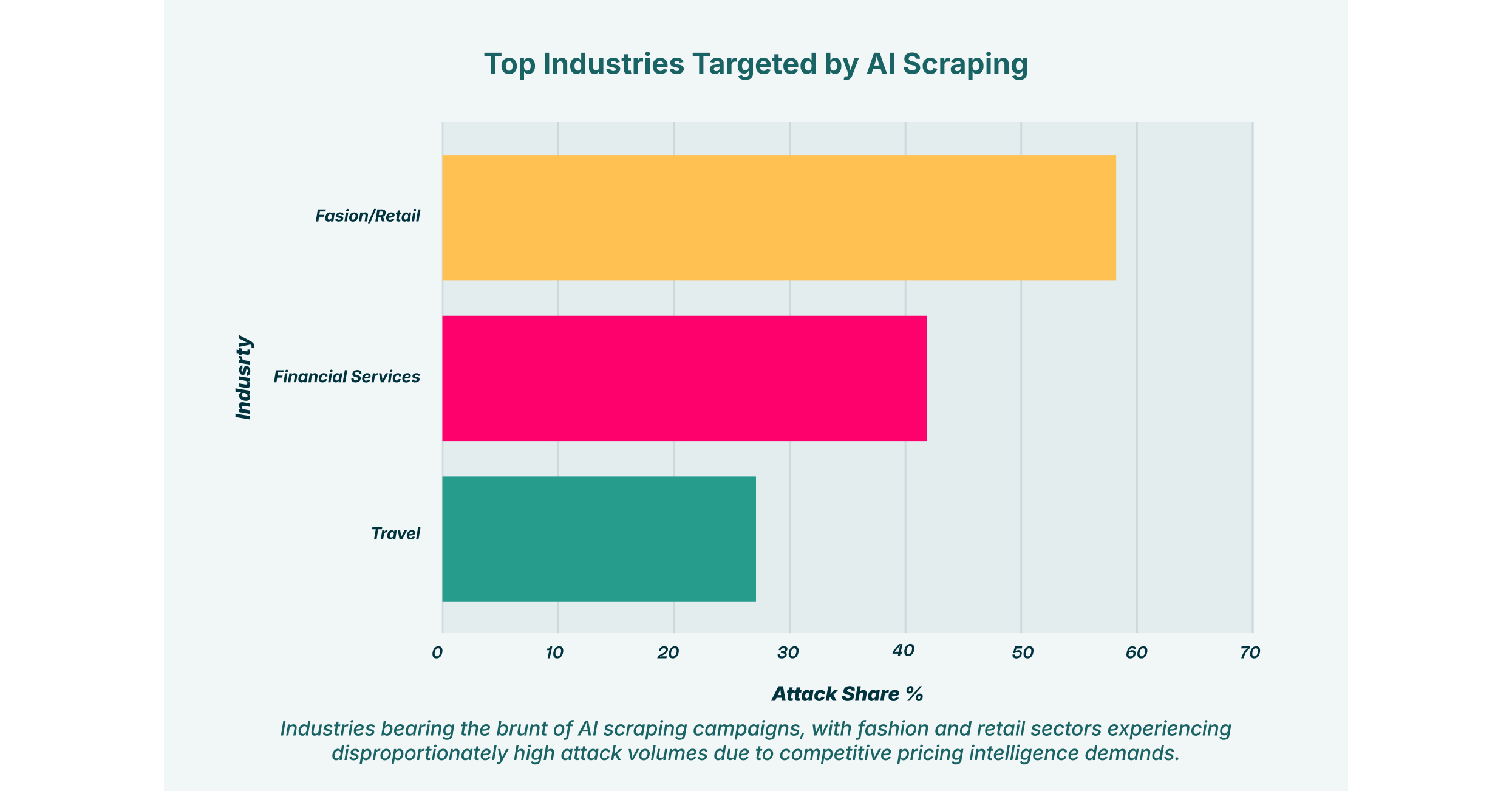

Imaginez un concurrent déployant un agent automatisé pour surveiller en permanence votre plateforme e-commerce. Il ne se contente pas de récupérer les prix une fois par jour. Il analyse vos algorithmes de tarification dynamique, identifie vos produits les plus populaires en suivant les indicateurs d'engagement des utilisateurs et va même jusqu'à extraire les avis clients pour en analyser le ressenti. La propriété intellectuelle de votre stratégie marketing est ainsi décryptée et utilisée contre vous, sans que vous ne vous en aperceviez.

Les conséquences d'une campagne de scraping par IA réussie vont bien au-delà de la simple perte d'avantage concurrentiel. Les dommages opérationnels, financiers et de réputation peuvent être catastrophiques et affecter tous les aspects de l'entreprise. Les principaux risques se concentrent sur le vol de deux types d'actifs critiques : la propriété intellectuelle et les données sensibles.

L'érosion de la propriété intellectuelle

Pour de nombreuses entreprises, leur propriété intellectuelle représente leur atout le plus précieux. Cela englobe tout, du code source et des conceptions de produits aux stratégies marketing et aux bases de connaissances internes. Le scraping par IA constitue une menace directe pour ces fondements. Prenons les exemples suivants :

- Réplication de plateforme SaaS : Une entreprise concurrente peut utiliser un agent automatisé pour cartographier systématiquement l’intégralité de votre application SaaS. Ce dernier récupère les fonctionnalités, les éléments d’interface utilisateur et la logique des flux de travail. Grâce à ce modèle, elle peut développer rapidement un produit concurrent, annulant ainsi votre avantage de pionnier et votre différenciation sur le marché.

- Sabotage de contenu et de référencement : les médias numériques et les entreprises axées sur le contenu sont particulièrement vulnérables. Des pirates peuvent dérober des bibliothèques entières d’articles, d’images et de vidéos, puis les republier sur des sites de spam. Il s’agit non seulement d’un vol, mais cela peut aussi nuire gravement à votre positionnement dans les moteurs de recherche en créant des problèmes de contenu dupliqué.

- Vol d'algorithmes propriétaires : Les entreprises qui s'appuient sur des algorithmes uniques, comme les sociétés de trading financier, les entreprises de logistique ou les moteurs de recommandation, sont des cibles privilégiées. Un agent automatisé peut exploiter des milliers de points de données et analyser les résultats pour reconstituer le modèle sous-jacent, s'emparant ainsi du « secret de fabrication » de l'entreprise.

Cette érosion implacable de la propriété intellectuelle est un tueur silencieux qui sape lentement la capacité d'innovation et la position sur le marché d'une entreprise.

L'exfiltration de données sensibles

Alors que certains scrapers ciblent la logique métier propriétaire, d'autres recherchent un butin plus directement monétisable : les données sensibles. En interagissant avec d'innombrables applications web et services cloud via leurs navigateurs, les employés créent une vaste surface d'attaque propice à l'exfiltration de données. Un agent automatisé, souvent déployé via une extension de navigateur apparemment inoffensive, peut rester indétecté dans le navigateur de l'utilisateur, attendant le moment idéal pour agir.

C’est là que la surface d’attaque entre le navigateur et le cloud devient une faille de sécurité critique. Un employé peut accéder à un CRM d’entreprise, à un portail de santé ou à un système financier. L’agent, s’exécutant avec les identifiants authentifiés de l’utilisateur, peut alors systématiquement extraire et exfiltrer les données suivantes :

- Informations personnelles identifiables (IPI) : Noms, adresses, coordonnées et numéros d'identification gouvernementaux des clients.

- Données financières : numéros de cartes de crédit, coordonnées bancaires et documents financiers de l'entreprise.

- Informations de santé protégées (ISP) : dossiers des patients et autres données protégées par des réglementations telles que la loi HIPAA.

Une seule fuite de données sensibles peut entraîner des amendes réglementaires exorbitantes, des poursuites judiciaires et une perte totale de confiance de la part des clients. Lorsque l'exfiltration est effectuée par un agent automatisé furtif, la fuite peut rester indétectée pendant des mois, aggravant ainsi les dégâts.

La nouvelle frontière : l’extraction de données de l’API GenAI

L'essor récent de l'IA générative a ouvert une nouvelle voie très spécialisée pour l'extraction de données malveillantes : le scraping des API d'IA générative. Les organisations intègrent de plus en plus de modèles de langage à grande échelle (LLM) dans leurs processus et produits via des API. Ces API, bien que puissantes, constituent une cible nouvelle et attrayante pour les attaquants sophistiqués.

Le scraping de l'API GenAI ne consiste pas à voler du contenu superficiel de sites web. Il s'agit d'attaquer le modèle d'IA lui-même. Grâce à des appels d'API soigneusement conçus, un agent automatisé peut :

- Vol de modèles propriétaires : En interrogeant systématiquement un modèle GenAI personnalisé, des attaquants peuvent en déduire son architecture et ses paramètres, ce qui leur permet de le reproduire à leurs propres fins. Il s’agit d’un vol direct d’investissements considérables en recherche et développement.

- Extraction de données d'entraînement : Certaines techniques d'injection de requêtes peuvent amener un modèle à révéler une partie de ses données d'entraînement sous-jacentes. Si ces données contiennent des informations sensibles ou confidentielles, les conséquences peuvent être graves.

- Empoisonnement des résultats du modèle : des agents malveillants peuvent inonder une API GenAI de données biaisées ou nuisibles, tentant ainsi d’« empoisonner » le modèle et de dégrader la qualité de ses réponses pour les utilisateurs légitimes.

Imaginez une entreprise du secteur de la santé qui a entraîné un modèle d'intelligence artificielle générale (GenAI) sur des données sensibles de patients afin d'aider les médecins à établir des diagnostics. Une attaque réussie par extraction de données de l'API de GenAI pourrait non seulement exposer ces données sensibles, mais aussi compromettre l'intégrité de l'outil de diagnostic, mettant ainsi en danger la sécurité des patients.

Pourquoi les défenses traditionnelles échouent

Comment ces attaques sophistiquées parviennent-elles à leurs fins ? En réalité, les outils de sécurité traditionnels n’ont pas été conçus pour ce type de lutte. Les défenses périmétriques, telles que les pare-feu d’applications web (WAF) et les passerelles API, reposent principalement sur la détection par signature et l’analyse du trafic. Elles recherchent des schémas malveillants connus, un volume élevé de requêtes ou des adresses IP suspectes.

Un agent automatisé avancé contourne facilement ces contrôles.

- Il utilise des identifiants d'utilisateurs légitimes, souvent détournés via une extension de navigateur malveillante.

- Il fonctionne à un rythme « lent et discret », rendant son activité indiscernable du comportement normal d'un utilisateur.

- Il achemine le trafic via des serveurs proxy résidentiels, de sorte que chaque requête semble provenir d'une source différente et valide.

Ces agents ne déclenchent pas les alarmes classiques car ils opèrent à partir de dans les L'environnement de confiance de la session de navigation d'un utilisateur authentifié. Le périmètre de sécurité s'est déplacé de la périphérie du réseau vers le navigateur individuel, et la plupart des organisations ne disposent d'aucune visibilité ni d'aucun contrôle significatifs à ce niveau critique.

La solution : Détection et réponse du navigateur

Pour contrer une menace provenant du navigateur, la défense doit elle aussi résider dans le navigateur. C'est le principe de l'extension Enterprise Browser de LayerX. Au lieu de bloquer le trafic malveillant au niveau du réseau, LayerX offre une visibilité approfondie sur la session de navigation elle-même, analysant en temps réel le comportement des scripts et les flux de données afin de détecter et de neutraliser les menaces invisibles pour les pare-feu applicatifs web (WAF) et autres outils réseau.

Voici comment cette approche contrecarre directement la menace du scraping par l'IA :

- Analyse comportementale : LayerX ne se base pas sur des signatures obsolètes. Il analyse le comportement de chaque script exécuté dans le navigateur. Lorsqu'un agent automatisé commence à parcourir systématiquement le DOM d'une application web ou à tenter d'exfiltrer des données, son comportement s'écarte des habitudes humaines. LayerX détecte instantanément cette activité anormale et peut interrompre le script avant toute perte de données sensibles.

- Protection contre le Shadow IT : les employés utilisent constamment des applications SaaS non autorisées (Shadow IT), créant ainsi une faille de sécurité majeure. LayerX fonctionnant au niveau du navigateur, il protège l’utilisateur quel que soit le site web visité ou l’application utilisée. Il empêche efficacement un agent de collecter des données depuis une instance Salesforce d’entreprise, tout comme depuis un compte ChatGPT personnel accessible sur un appareil professionnel. Il assure ainsi une protection essentielle contre le Shadow IT.

- Prévention de l'exfiltration de données via l'IA générale : en surveillant tous les transferts de données provenant du navigateur, LayerX identifie et bloque les tentatives d'envoi de volumes importants de données sensibles vers des destinations non autorisées, notamment les API des plateformes d'IA générale publiques. Ceci empêche les fuites de données accidentelles et malveillantes, et protège la propriété intellectuelle des entreprises à l'ère de l'IA.

La lutte contre le scraping par IA ne se gagnera pas au niveau du périmètre réseau. Elle se gagnera en sécurisant le principal point d'interaction entre les utilisateurs et les applications : le navigateur. En renforçant la sécurité de ce terminal critique, les organisations pourront enfin prendre l'avantage sur la nouvelle génération de menaces intelligentes et automatisées.