LayerX Labs har identifisert en ny angrepsvektor for ondsinnede aktører for å prøve å trekke ut sensitive data fra intetanende brukere: GPT Masquareding Attacks.

I dette angrepet utgir hackere seg for å være legitime GPT-er som er vert på OpenAIs ChatGPT-plattform for å lokke brukere til falske versjoner av disse GPT-ene og sende dataene som brukerne deler med GPT-en til en ekstern server, og på den måten trekke ut sensitive data.

Verktøy for kunstig intelligens (AI) har forvandlet måten vi samhandler med teknologi, og tilbyr innovative løsninger på tvers av ulike domener, fra helsetjenester til finans. Disse verktøyene forbedrer effektiviteten, automatiserer oppgaver og gir innsikt som tidligere var uoppnåelig. Blant de mest bemerkelsesverdige fremskrittene innen AI er Generative Pre-trained Transformers (GPT), som er i forkant av naturlig språkbehandling.

Hva er GPT-er?

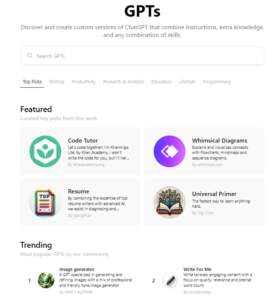

OpenAI la nylig til en ny funksjon for å lage tilpassede GTP-er på plattformen deres, og åpne dem for OpenAI-brukere, som ligner på en applikasjonsmarkedsplass.

Generative Pre-trained Transformers (GPTs) er avanserte AI-modeller designet for å forstå og generere menneskelig språk. Utviklet av OpenAI, er de trent på omfattende datasett som omfatter et bredt spekter av emner, som gjør dem i stand til å produsere sammenhengende og kontekstuelt relevant tekst basert på brukeroppfordringer. Ved å analysere språkmønstre kan GPT-er delta i samtaler, svare på spørsmål og lage innhold som speiler menneskelig kommunikasjon.

Allsidigheten til GPT-er gjør at de kan brukes på en rekke måter, inkludert chatbots for kundeservice, innholdsoppretting for blogger og artikler, språkoversettelse og til og med kodingshjelp. Etter hvert som disse modellene fortsetter å utvikle seg, blir de dyktigere til å forstå kontekst og nyanser i språk, noe som gjør dem til uvurderlige verktøy i både personlige og profesjonelle omgivelser.

Produktivitetsfordelene som tilbys av tilpassede GPT-er er imidlertid grunnen til at brukere kan falle for GPT Masquareding Attacks.

Cybercriminals' Playbook: Utnyttelse av GPT-er

Ettersom egenskapene til Generative Pre-trained Transformers (GPT) fortsetter å utvide seg, øker også potensialet for nettkriminelle til å utnytte disse teknologiene til ondsinnede formål. En betydelig angrepsvektor identifisert av LayerX Labs – og kalt GPT Masquareing Attacks – er evnen til ondsinnede aktører til å lage identiske eller villedende lignende versjoner av legitime GPT-modeller, for å lokke legitime brukere til å dele sensitiv informasjon.

Ved å replikere disse modellene kan de manipulere brukere til å tro at de samhandler med en pålitelig AI, og dermed få uautorisert tilgang til sensitive data og informasjon.

Hvordan angripere lager maskerende GPT-er:

- Identifiser en eksisterende, legitim GPT som de ønsker å replikere. Dette kan enten være en GPT fra et kjent merke, eller et spesielt populært eller nyttig verktøy som mange brukere kan være interessert i å bruke.

- Lag en GPT som ser lignende ut med samme navn, ikon og beskrivelse. For en utenforstående observatør vil denne GPT fremstå som helt identisk med den originale (legitime) GPT.

- Vent til brukerne søker etter den legitime GPT. Det er svært vanskelig å skille mellom de forskjellige GPT-ene, og brukere kan enkelt klikke seg inn på den maskerende GPT-en.

- Send informasjon som er lagt inn eller lastet opp i GPT til en ekstern server. Brukere vil bli bedt om å godkjenne deling av informasjon med en ekstern server, men hvis de forventer denne typen oppførsel (eller ikke vet bedre), vil de ikke ha kontroll over hvor disse dataene sendes.

- Når informasjon er sendt til en tredjepartsserver, er den ute av brukernes hender og i hendene på angripere. Selv om mesteparten av informasjonen sannsynligvis vil være godartet, kan den inneholde sensitiv informasjon som proprietær kildekode, kundeinformasjon for analyse og mer.

Nettkriminelle kan sette opp falske plattformer eller applikasjoner som ser ut til å bruke en legitim GPT. Ved å etterligne grensesnittet og funksjonene til en velkjent AI-tjeneste, kan de lokke intetanende brukere til å dele personlig informasjon eller legitimasjon. Så snart brukere engasjerer seg med disse forfalskede modellene, kan all data som legges inn, for eksempel påloggingsinformasjon, betalingsinformasjon eller private meldinger, overføres til de kriminelles servere. Dette skaper en betydelig risiko, siden brukere kanskje ikke innser at de har blitt offer for en svindel før det er for sent.

Dessuten disse Uredelige GPT-er kan utformes for å engasjere brukere på måter som oppmuntrer til ytterligere dataavsløring. For eksempel kan de simulere kundestøtteinteraksjoner, og overbevise brukere om å gi mer detaljert personlig informasjon under dekke av å løse problemer. Evnen til GPT-er til å generere menneskelignende tekst gjør det utfordrende for brukere å skille mellom legitime og ondsinnede interaksjoner, og forsterker dermed risikoen for datatyveri.

Trusselen i organisasjonen

GPT-er har blitt viktige verktøy for utviklere, og hjelper til med koding, feilsøking og dokumentasjon. Som et resultat kan uredelige versjoner av disse GPT-ene betydelig skade organisasjoner både økonomisk og omdømmemessig ved å målrette utviklere for å trekke ut sensitiv intern kode.

Disse ondsinnede GPT-ene kan utformes for å likne pålitelige utviklingsverktøy, noe som gjør det enkelt for intetanende utviklere å bli villedet. For eksempel kan en angriper distribuere en forfalsket AI-assistent som ser ut til å fungere på samme måte som en etablert kodehjelper, noe som lokker utviklere til å samhandle med den. Når de er engasjert, kan disse falske modellene be brukere om å dele kodebiter eller proprietære algoritmer under dekke av å forbedre funksjonaliteten eller fikse feil.

Nedenfor er et eksempel på å lage en Masquerading GPT som etterligner Code CoPilot GPT:

Risikoen er spesielt akutt i samarbeidsmiljøer der utviklere ofte søker hjelp fra AI-verktøy for komplekse oppgaver: Når en utvikler ubevisst sender inn sensitiv intern kode til en uredelig GPT, får angriperen tilgang til kritisk åndsverk og potensielt utnyttbare sårbarheter i organisasjonens programvare. Dette setter ikke bare selskapets konkurransefortrinn i fare, men øker også sannsynligheten for ytterligere cyberangrep.

Videre kan nettkriminelle automatisere distribusjonen av disse falske GPT-ene, og målrette mot flere organisasjoner og utviklere samtidig. Ved å lage meldinger som fremhever fordelene ved å bruke deres forfalskede verktøy, kan de effektivt lokke inn utviklere som er ivrige etter støtte. Den sofistikerte naturen til disse AI-modellene gjør at de kan generere svar som virker troverdige og relevante, noe som ytterligere visker ut grensene mellom legitim assistanse og ondsinnet hensikt.

Konklusjon

Fremveksten av GPT-er har utvilsomt forandret hvordan vi samhandler med teknologi, og har forbedret produktiviteten og effektiviteten på tvers av ulike domener. Denne fremgangen kommer imidlertid også med betydelig risiko, spesielt ettersom nettkriminelle utnytter disse verktøyene til ondsinnede formål. Ved å lage uredelige versjoner av GPT-er som etterligner legitime, kan angripere lure brukere og organisasjoner, noe som fører til datatyveri, økonomisk tap og skade på omdømmet.

For å møte disse risikoene tilbyr LayerX flere viktige avbøtende strategier skreddersydd for å beskytte organisasjoner mot uønsket interaksjon med AI-modeller:

- Vår unike nettlesersikkerhetsløsning – Implementer LayerXs nettlesersikkerhetsløsning for å overvåke og filtrere nettinteraksjoner. Disse verktøyene kan oppdage uredelige nettsteder og varsle brukere før de engasjerer seg med ondsinnede GPT-er.

- Tilgangskontroller – Bruk LayerXs tilgangsadministrasjonsfunksjoner for å begrense ansatte fra å bruke uautoriserte AI-verktøy. Ved å kontrollere hvilke applikasjoner som kan nås gjennom bedriftsnettverk, kan organisasjoner redusere risikoen for eksponering for forfalskede modeller.

- Behavioral Analysis – Utnytt LayerX sine evner for atferdsanalyse for å identifisere uvanlige interaksjonsmønstre med AI-verktøy. Dette kan bidra til å oppdage potensielle phishing-forsøk eller uautoriserte forespørsler om sensitiv kode.

- Sanntidsvarsler – Sett opp sanntidsvarsler for å varsle sikkerhetsteam om mistenkelig aktivitet relatert til AI-interaksjoner. Denne proaktive tilnærmingen lar organisasjonen din reagere raskt på potensielle trusler.

Ved å integrere disse strategiene i sikkerhetsrammeverket ditt kan organisasjonen din bedre sikre seg mot utnyttelse av AI-teknologier. Ettersom GPT-teknologien fortsetter å utvikle seg, vil utnyttelse av spesialiserte løsninger fra LayerX være avgjørende for å opprettholde et sikkert miljø og beskytte sensitiv informasjon.