Maskinlæringsmodeller er ikke lenger bare analytiske verktøy. De er motorene som driver beslutningstaking på tvers av moderne bedrifter. Denne avhengigheten har skapt en sofistikert trusselvektor kjent som fiendtlige AI-angrep. Dette er ikke tradisjonelle programvareutnyttelser som retter seg mot kodesårbarheter som bufferoverløp. De er optiske illusjoner for algoritmer.

Anatomien til et angrep: Hvordan modeller blir lurt

Angripere bruker subtile inndata for å lure AI-systemer til å foreta feil klassifiseringer eller avsløre sensitive treningsdata. For sikkerhetsledere i 2025 har innsatsen endret seg. Vi er vitne til en overgang fra teoretisk forskning til aktiv våpenbygging. Angripere operasjonaliserer disse teknikkene for å omgå svindeldeteksjon og manipulere økonomiske algoritmer.

De tvangsinnfiltrerer også proprietære data gjennom de samme verktøyene som ansatte bruker daglig. Nettleseren har blitt den primære arenaen for disse inntrengingene. Det er grensesnittet der ansatte limer inn sensitiv kode i LLM-er og hvor ondsinnede utvidelser i stillhet kan injisere giftige ledetekster. Å forstå mekanikken bak fiendtlige angrep på AI er det første trinnet i å sikre nettleser-til-sky-angrepsflaten.

Konkurrerende angrep ser ofte ut som støy for en menneskelig observatør, men tolkes som distinkte signaler av et nevralt nettverk. Denne uoverensstemmelsen lar angripere manipulere resultater uten å utløse tradisjonelle sikkerhetsvarsler. Metodene som brukes til å utføre AI-konkurrerende angrep faller vanligvis inn i tre forskjellige kategorier.

Dataforgiftning: Korrumperer brønnen

Forgiftningsangrep skjer under trenings- eller finjusteringsfasen. Ved å injisere ondsinnede prøver i datasettet kan en angriper opprette en skjult bakdør i modellen. En angriper kan subtilt endre et sett med phishing-e-poster i et treningskorpus. Det resulterende spamfilteret lærer å klassifisere spesifikke ondsinnede mønstre som godartede.

I sammenheng med GenAI er dette spesielt farlig. Hvis en bedrift finjusterer en kodeassistent på interne repositorier som har blitt subtilt tuklet med, er konsekvensene alvorlige. Modellen kan foreslå usikre kodebiter til utviklere, noe som effektivt automatiserer introduksjonen av sårbarheter.

Modellunngåelse: Den digitale håndgrepet

Unnvikelsesangrep skjer ved inferenstidspunktet. Angriperen endrer inndataene slik at modellen feilklassifiserer dem. Dette er den vanligste formen for fiendtlige angrep på AI som sees i naturen i dag. Et klassisk eksempel innebærer å endre noen få piksler i et bilde av et stoppskilt.

Det autonome kjøretøyet oppretter en farlig klassifiseringsfeil og identifiserer den som et fartsgrenseskilt. I bedriftsmiljøet brukes unnvikelsesteknikker for å omgå skadevareklassifiseringer. Dette gjør at våpenbelagte filer kan slippe forbi neste generasjons antivirusløsninger.

Modellutvinning og tyveri

Modelltyveri innebærer at en angriper undersøker et «svart boks»-system for kunstig intelligens med en rekke spørringer. Målet deres er å rekonstruere den underliggende modellen eller trekke ut de private dataene den ble trent på. Ved å analysere resultatene kan de bygge en surrogatmodell som etterligner målets proprietære oppførsel.

Dette stjeler intellektuell eiendom. Det gir også en sandkasse der angriperen kan teste fremtidige unnvikelsesangrep offline. De kan sikre at metodene deres vil fungere mot produksjonssystemet uten å varsle offeret.

Økningen av automatiserte trusler i 2025

Inngangsbarrieren for å utføre disse angrepene har blitt betydelig redusert. Automatiserte verktøysett lar nå selv lavt kvalifiserte aktører lansere sofistikerte kampanjer. Det store antallet hendelser øker aggressivt. Sikkerhetsteam må revurdere sin defensive holdning.

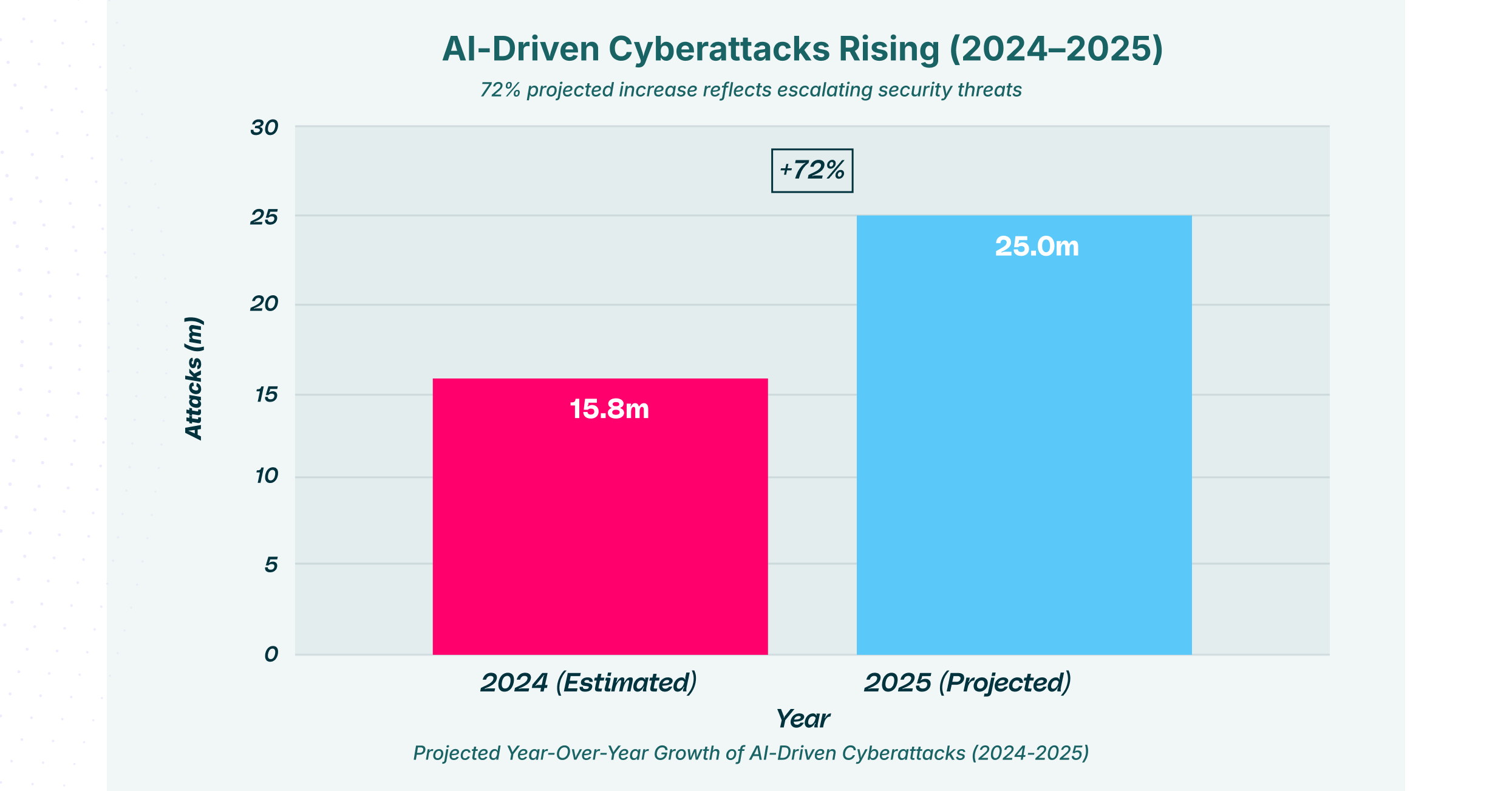

Dette diagrammet illustrerer den anslåtte økningen på 72 % fra år til år i globale cyberhendelser. Etter hvert som organisasjoner tar i bruk flere modeller, forventes volumet av AI-kontingentangrep å nå enestående nivåer, med 28 millioner hendelser anslått for 2025. Denne eksponentielle veksten fremhever hvordan automatiserte verktøy senker inngangsbarrieren for trusselaktører som utfører kontingentangrep med AI i stor skala.

Denne økningen er ikke tilfeldig. Den er drevet av den utbredte bruken av åpen kildekode-verktøy for kunstig intelligens som kan brukes på nytt til angrep. Angripere bruker GenAI til å automatisere oppdagelsen av sårbarheter i andre AI-systemer. Dette skaper en sløyfe av fiendtlig optimalisering som beveger seg raskere enn menneskelige forsvarere kan lappe.

Våpngjøring av GenAI: Phishing-epidemien

Generativ AI har fundamentalt endret spillet for sosial manipulering. Konkurranseangrep i generativ AI handler ikke bare om å lure en modell. De handler om å bruke modellen til å lure mennesker. Angripere bruker nå store språkmodeller (LLM-er) for å lage kontekstuelle, grammatisk perfekte phishing-e-poster.

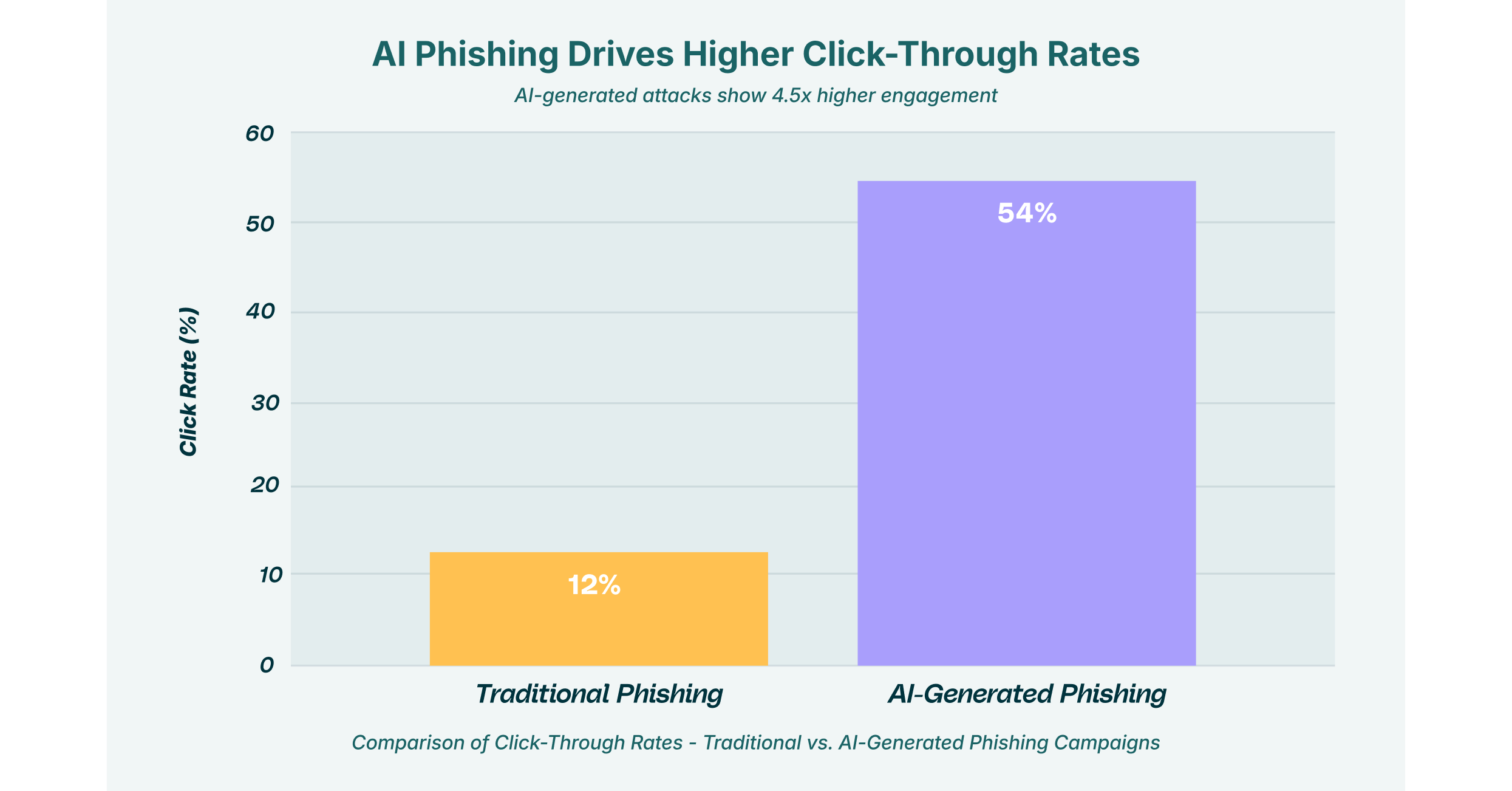

Disse e-postene etterligner tonen og stilen til interne ledere. Effektiviteten til disse AI-drevne kampanjene er alarmerende sammenlignet med tradisjonelle metoder.

En sammenligning av klikkrater avslører den farlige effekten av fiendtlige angrep i generativ AI. Mens tradisjonelle phishing-kampanjer sliter med en suksessrate på 12 %, oppnår AI-genererte lokkemidler, laget for å etterligne pålitelig intern kommunikasjon, en svimlende klikkrate på 54 %. Disse dataene understreker det kritiske behovet for spesialisert nettlesersikkerhet for å oppdage de subtile språklige og strukturelle avvikene i GenAI-drevet sosial manipulering.

Sikkerhetsløsninger for nettlesere må nå utvikles utover enkel URL-filtrering. De må analysere intensjonen og konteksten til innholdet som gjengis. Når en ansatt samhandler med en GenAI-chatbot eller mottar en mistenkelig e-post, fungerer nettleserutvidelsen som det kritiske kontrollpunktet. Den kan flagge avvik som tyder på at innholdet ble syntetisk generert for å lure.

Rask injeksjon: «SQL-injeksjonen» i AI-æraen

En av de mest utbredte formene for fiendtlige angrep i generativ AI er prompt injection («umiddelbar injeksjon»). Denne teknikken innebærer å lage tekstinndata som overstyrer modellens opprinnelige instruksjoner. Det tvinger systemet til å utføre uautoriserte handlinger.

Mekanismer for injeksjon

Risikoen er ikke begrenset til at brukere skriver uønskede ting inn i en chatboks. Den virkelige faren ligger i indirekte prompt injection, eller «Man-in-the-Prompt»-angrep. I dette scenariet kan en LLM behandle en nettside eller et dokument som inneholder skjulte ondsinnede instruksjoner.

LayerX Labs har identifisert vektorer der ondsinnede nettleserutvidelser mater disse giftige meldingene inn i bedriftens LLM-er. Dette skjer uten brukerens samtykke. Dette lar angripere manipulere utdataene fra pålitelige AI-verktøy. Det gjør effektivt en nyttig assistent til en insidertrussel.

Taksonomi for risikoer ved umiddelbar injeksjon

| Angrepstype | Mekanisme | Risikonivå |

| Direkte injeksjon | Angriper skriver manuelt inn ondsinnede ledetekster for å omgå sikkerhetsfiltre (jailbreaking). | Høyt |

| Indirekte injeksjon | Ondsinnede instruksjoner er skjult i eksterne data (f.eks. nettsider) som konsumeres av AI-en | Kritisk |

| Kontekstforgiftning | Manipulering av samtalehistorikk for å påvirke fremtidige modellresponser. | Medium |

Denne tabellen kategoriserer de primære vektorene for umiddelbar injeksjon, en spesifikk delmengde av fiendtlige AI-angrep. Indirekte injeksjon utgjør en kritisk risiko fordi den skjer uten brukerens viten. Det skjer ofte gjennom et «Man-in-the-Prompt»-scenario der en nettleserutvidelse leser en kompromittert nettside og mater den skadelige instruksjonen inn i bedriftens LLM.

Deepfake-dilemmaet og identitetssikring

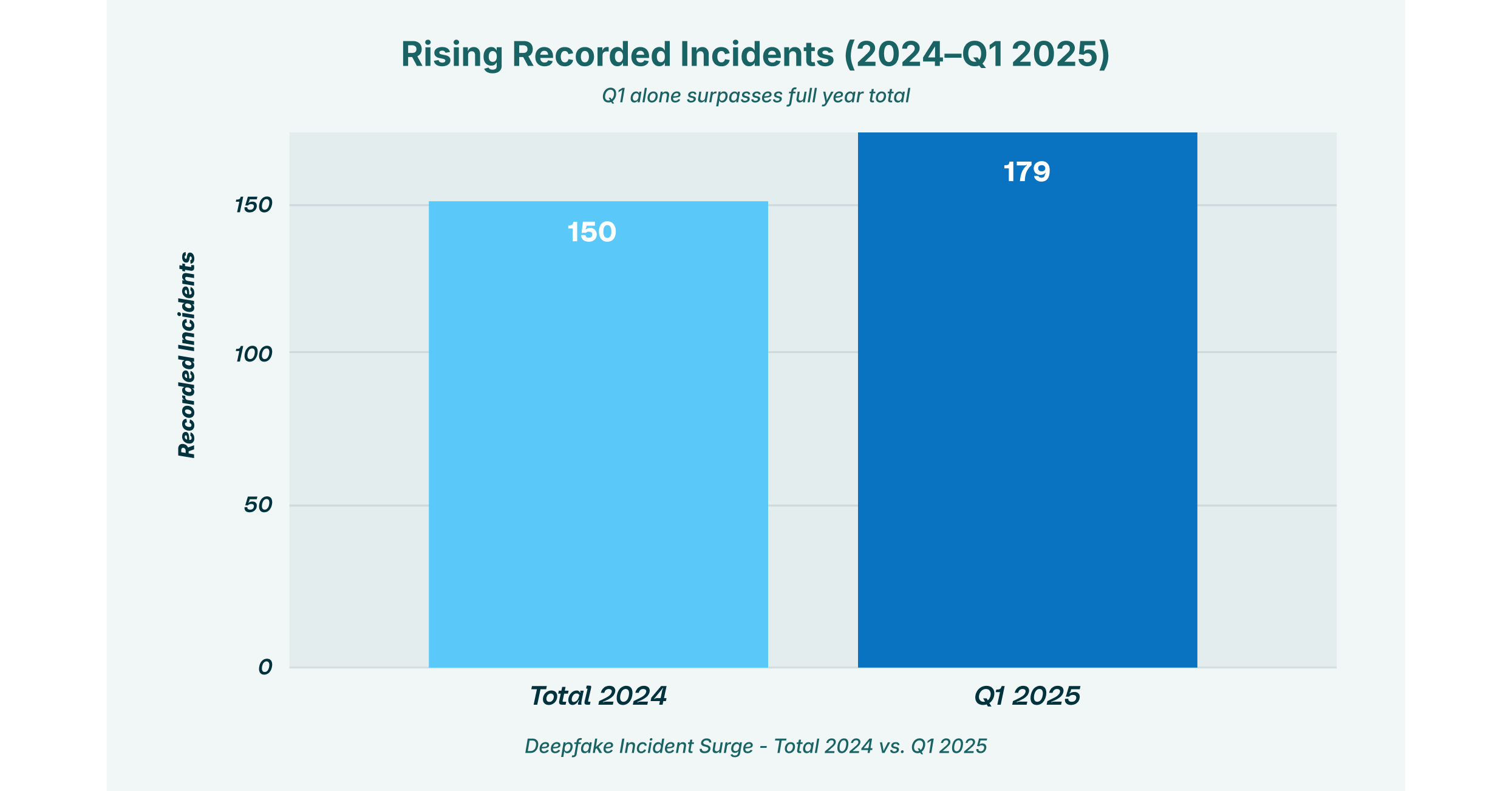

Den samme teknologien som brukes til å lage nyttige avatarer blir nå utnyttet som et våpen for å omgå identitetsverifiseringssystemer. Deepfakes har gått fra å være nyskapende på internett til sikkerhetstrusler på bedriftsnivå.

Disse angrepene manifesterer seg ofte på videokonferanseplattformer eller under eksterne onboarding-prosesser. En angriper bruker et sanntids deepfake-overlegg for å utgi seg for å være en administrerende direktør eller en finansdirektør. De autoriserer falske overføringer eller ber om sensitiv legitimasjon. Organisasjoner må distribuere forsvar som kan oppdage digitale artefakter i syntetiske medier.

Nettleseren: Den primære angrepsflaten

Hvorfor er nettleseren sentral i denne diskusjonen? Fordi det er grensesnittet som ansatte bruker for å få tilgang til GenAI-verktøy som ChatGPT, Gemini eller Claude. Det er porten som AI-angrep når endepunktet gjennom.

Tradisjonelle nettverkssikkerhetsverktøy er blinde for den krypterte trafikken mellom en brukers nettleser og en AI-tjeneste. De kan ikke se om en ansatt limer inn personlig identifiserende informasjon i en chatbot. De kan ikke se om en «Shadow SaaS»-utvidelse skraper disse dataene i stillhet. LayerXs forskning på «Shadow AI» avslører at en betydelig andel av datalekkasje i bedrifter skjer gjennom uadministrerte nettleserutvidelser.

Når vi snakker om å forhindre fiendtlige angrep på AI, må vi se på nettleseren som håndhevingspunktet. Det er det eneste stedet hvor vi kan se brukerens input, modellens output og konteksten for nettøkten samtidig. Denne synligheten muliggjør sanntidsredigering av sensitive data.

Forsvarsstrategier for GenAI-æraen

Å forsvare seg mot disse sofistikerte truslene krever en flerlags tilnærming. Det er ikke nok å stole på sikkerhetsfiltrene som er innebygd i modellene av leverandører. Bedrifter må pakke disse modellene inn i sine egne sikkerhetskontroller.

Rødt lagspill og fuzzing

Organisasjoner bør iverksette proaktiv stresstesting av sine AI-implementeringer. Red teaming innebærer at etiske hackere prøver å jailbreake modeller. De utfører fiendtlige AI-angrep for å identifisere svakheter.

Dette er ofte paret med fuzzing. Fuzzing er en automatisert teknikk der tusenvis av tilfeldige eller semi-tilfeldige input kastes mot modellen. Målet er å se om noen av dem forårsaker at den krasjer eller avslører treningsdata.

Nettleserdeteksjon og -respons (BDR)

En omfattende BDR-løsning fungerer som en brannmur for brukerens nettøkt. Den kan forhindre installasjon av skadelige utvidelser som legger til rette for dataforgiftning eller modelltyveri.

Videre gjør det det mulig for organisasjoner å håndheve policykontroller for bruk av GenAI. Dette sikrer at ansatte ikke utilsiktet deltar i et angrep. Det forhindrer at organisasjonen utsettes for fiendtlige angrep i generativ AI gjennom risikabel atferd.

Sikring av fremtiden for etterretning

Katt-og-mus-leken mellom angripere og forsvarere har gått inn i en ny fase. Konfliktlignende angrep representerer en grunnleggende utfordring for integriteten til systemene vi bygger for fremtiden vår.

Ved å forstå nyansene ved fiendtlige angrep på AI, kan sikkerhetsledere bygge robuste arkitekturer. Veien videre krever ikke at man forlater AI. Den krever at man sikrer økosystemet den opererer i.

Dette betyr å erkjenne at nettleseren ikke lenger bare er en dokumentvisningsenhet. Den er frontlinjen i forsvaret mot fiendtlige angrep innen generativ kunstig intelligens. Gjennom grundig testing og sanntidsovervåking kan bedrifter navigere i dette komplekse landskapet med trygghet.