Integreringen av generativ AI i arbeidsflyter i bedrifter er ikke et fremtidsrettet forslag; det skjer akkurat nå, i et tempo som ofte overgår sikkerhets- og styringskapasiteter. For hver dokumentert, sanksjonert bruk av et AI-verktøy som øker produktiviteten, finnes det utallige tilfeller av "skyggebruk", som utsetter organisasjoner for betydelige trusler. Utfordringen for sikkerhetsanalytikere, IT-sjefer og IT-ledere er tydelig: hvordan muliggjør vi innovasjonen AI lover uten å invitere til uakseptable risikoer? Svaret ligger i en disiplinert, proaktiv tilnærming til AI-risikostyring. Dette handler ikke om å blokkere fremgang; det handler om å bygge rekkverk som lar organisasjonen din akselerere trygt.

Den økende nødvendigheten av AI-styring

Før noen effektiv risikostrategi kan implementeres, må et grunnlag for AI-styring etableres. Den raske, desentraliserte adopsjonen av AI-verktøy betyr at organisasjoner opererer i mørket uten en formell styringsstruktur. Ansatte, ivrige etter å forbedre effektiviteten, vil uavhengig ta i bruk ulike AI-plattformer og plugins, ofte uten å vurdere sikkerhetsmessige implikasjoner. Dette skaper et komplekst nett av usanksjonert SaaS-bruk, hvor sensitive bedriftsdata; fra PII og økonomiske poster til immaterielle rettigheter; utilsiktet kan bli slettet til tredjeparts store språkmodeller (LLM-er).

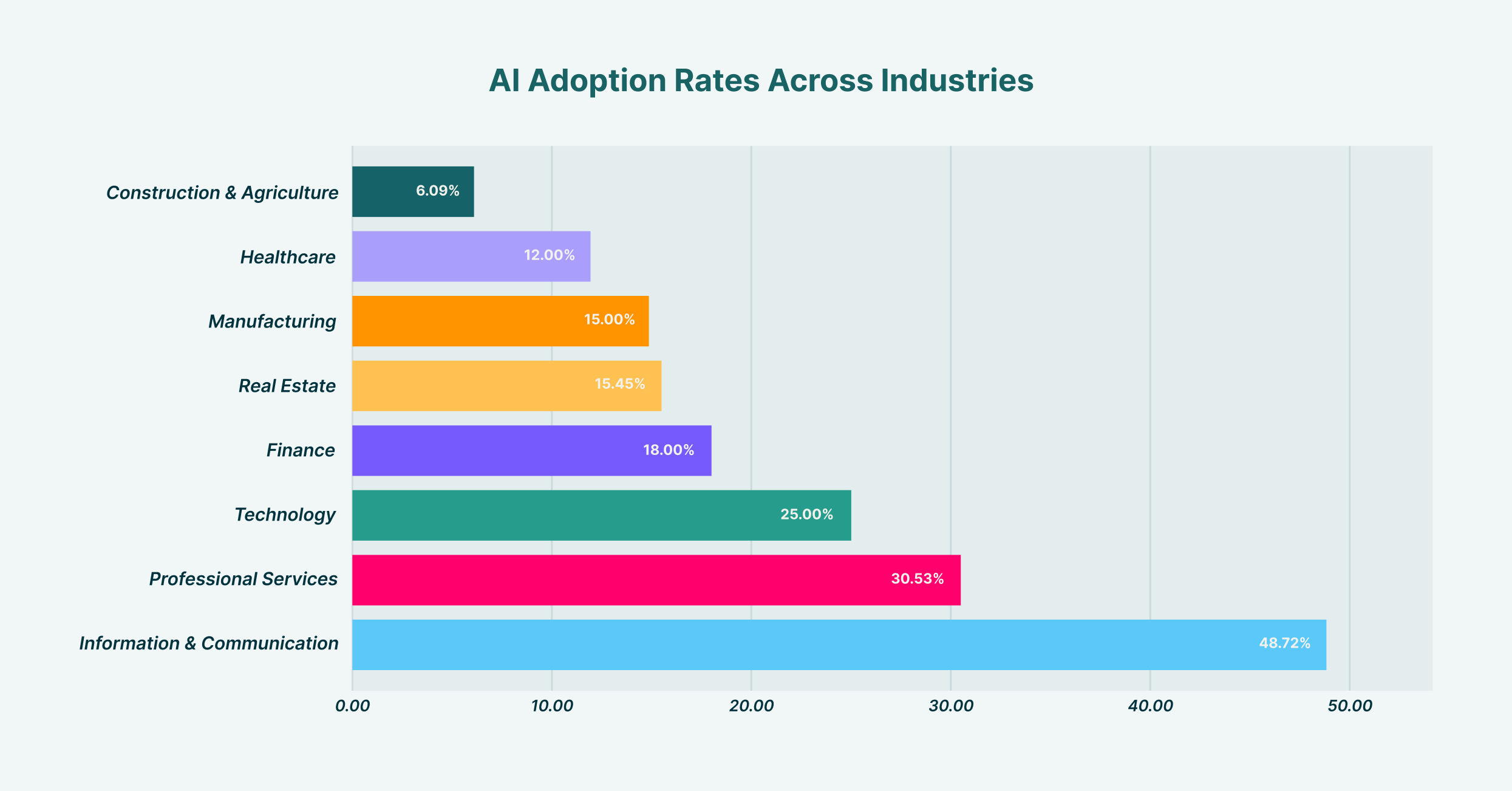

Adopsjonen av AI varierer betydelig mellom bransjer, med informasjon og kommunikasjon som leder med 48.7 % og bygg og landbruk som lavest med 6.1 %.

Å etablere robust styring av AI innebærer å opprette et tverrfaglig team, vanligvis inkludert representanter fra IT-, sikkerhets-, juridiske og forretningsavdelinger. Denne komiteen har i oppgave å definere organisasjonens holdning til AI. Hva er vår risikoappetitt? Hvilke brukstilfeller oppfordres, og hvilke er forbudt? Hvem er ansvarlig når en AI-relatert hendelse inntreffer? Å svare på disse spørsmålene gir den klarheten som trengs for å bygge retningslinjer og kontroller. Uten denne ovenfra-og-ned strategiske retningen blir ethvert forsøk på å håndtere risiko en serie usammenhengende, reaktive tiltak snarere enn et helhetlig forsvar. Dette styringsrammeverket blir blåkopien for all påfølgende sikkerhetsinnsats, og sikrer at teknologi, retningslinjer og brukeratferd er i samsvar.

Bygge ditt rammeverk for risikostyring av kunstig intelligens

Med en styringsstruktur på plass er neste steg å konstruere et formelt rammeverk for risikostyring innen kunstig intelligens. Dette rammeverket operasjonaliserer styringsprinsippene dine og gjør overordnet strategi om til konkrete, repeterbare prosesser. Det gir en strukturert metode for å identifisere, vurdere, redusere og overvåke kunstig intelligens-relaterte risikoer på tvers av organisasjonen. I stedet for å finne opp hjulet på nytt, kan organisasjoner tilpasse etablerte modeller, som NIST AI Risk Management Framework, for å passe til deres spesifikke driftskontekst og trussellandskap.

Utviklingen av et effektivt rammeverk for risikostyring innen AI bør være en metodisk prosess. Den begynner med å lage en omfattende oversikt over alle AI-systemer som er i bruk; både godkjente og ikke-godkjente. Denne innledende oppdagelsesfasen er kritisk; du kan ikke beskytte det du ikke kan se. Etter oppdagelsen bør rammeverket skissere prosedyrer for risikovurdering, tildele poeng basert på faktorer som typen data som behandles, modellens muligheter og dens integrasjon med andre kritiske systemer. Tiltaksstrategier utformes deretter basert på denne vurderingen, alt fra tekniske kontroller og brukeropplæring til fullstendig forbud mot høyrisikoapplikasjoner. Til slutt må rammeverket inkludere en kadens for kontinuerlig overvåking og gjennomgang, fordi både AI-økosystemet og organisasjonens bruk av det vil stadig utvikle seg. Det finnes ulike rammeverk for risikostyring innen AI, men de mest vellykkede er de som ikke er statiske dokumenter, men levende, pustende komponenter i organisasjonens sikkerhetsprogram.

Kategorisering av AI-risikoer: Fra datautvinning til modellforgiftning

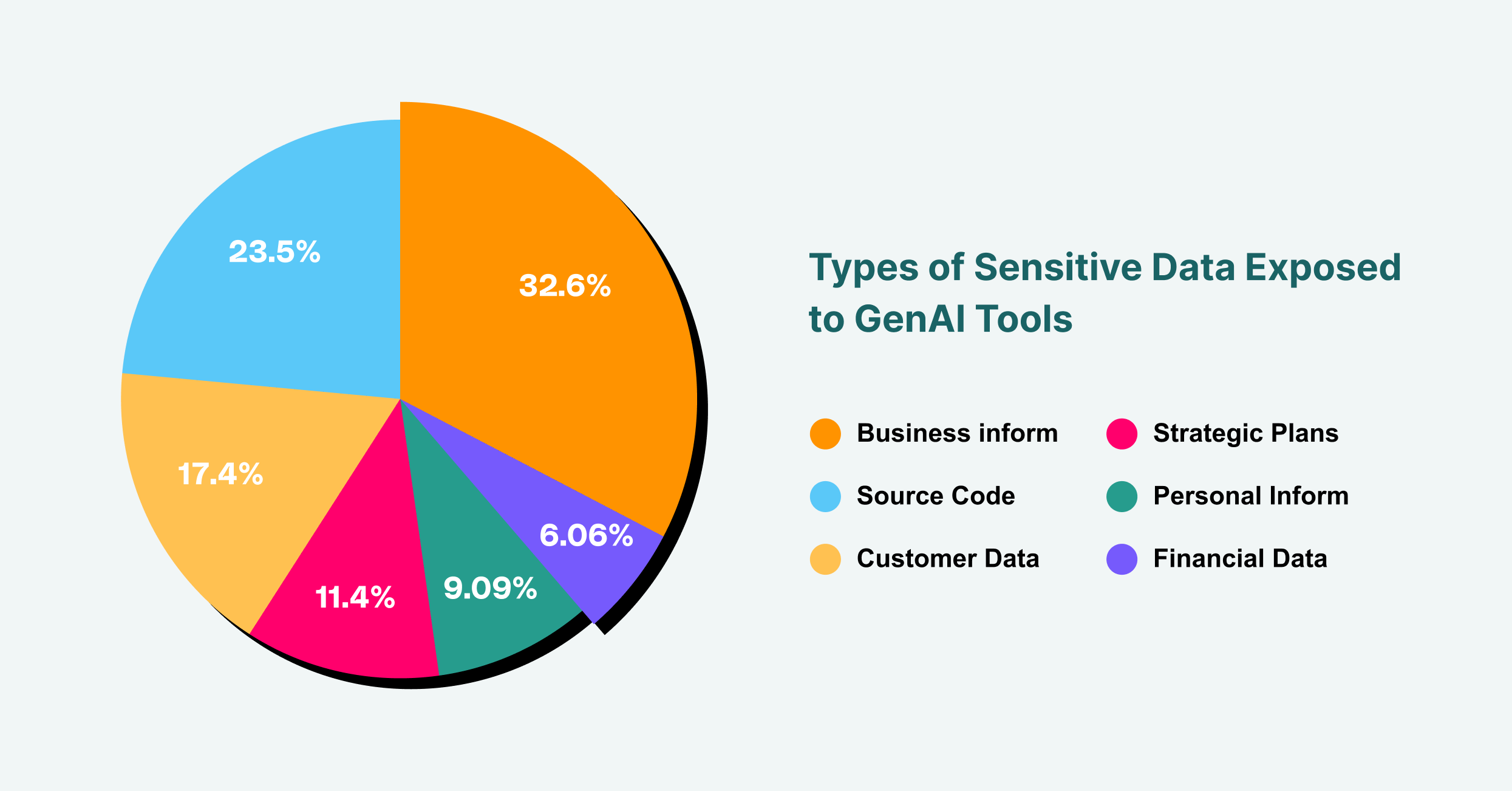

En kjernekomponent i AI og risikostyring er å forstå de spesifikke trusseltypene du står overfor. Risikoene er ikke monolittiske; de spenner over et spekter fra brudd på personvernregler til sofistikerte angrep mot selve AI-modellene. En av de mest umiddelbare og vanlige truslene er datalekkasje. Se for deg en markedsanalytiker som limer inn en liste over verdifulle leads, komplett med kontaktinformasjon, i et offentlig GenAI-verktøy for å utarbeide personlige e-poster. I det øyeblikket har sensitive kundedata blitt exfiltrert og er nå en del av LLMs opplæringsdata, utenfor organisasjonens kontroll og i potensielt brudd på personvernforskrifter som GDPR eller CCPA.

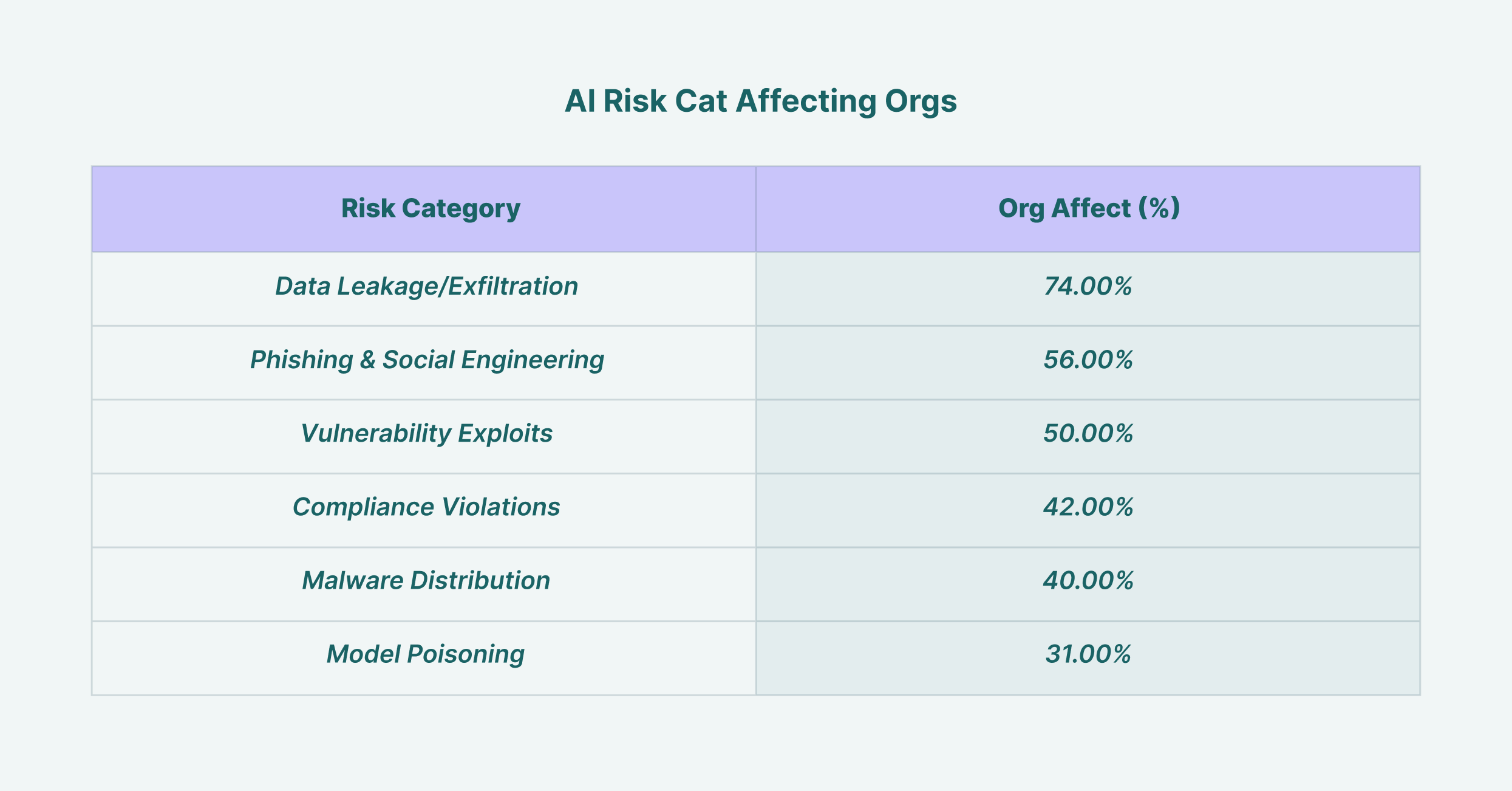

Datalekkasje påvirker 74 % av organisasjoner, noe som gjør det til den mest utbredte AI-sikkerhetsrisikoen, etterfulgt av phishing-angrep med 56 %.

Utover datalekkasje må sikkerhetsledere håndtere mer avanserte trusler. Modellforgiftning skjer når en angriper med vilje mater en modell med skadelige data i løpet av treningsfasen, noe som fører til at den produserer partiske, feilaktige eller skadelige resultater. Unnvikelsesangrep innebærer å lage inndata som er spesielt utviklet for å omgå et AI-systems sikkerhetsfiltre. For IT-sjefer betyr effektiv bruk av AI i risikostyring også å utnytte AI-drevne sikkerhetsverktøy for å oppdage nettopp disse truslene. Avanserte trusseldeteksjonssystemer kan analysere brukeratferd og dataflyter for å identifisere avvikende aktiviteter som indikerer en AI-relatert sikkerhetshendelse, og dermed gjøre teknologien fra en kilde til risiko til en komponent i løsningen.

Den kritiske rollen til en AI-sikkerhetspolicy

For å oversette rammeverket ditt til klare direktiver for dine ansatte, er en dedikert AI-sikkerhetspolicy ikke til forhandling. Dette dokumentet fungerer som den autoritative kilden til akseptabel bruk av AI i organisasjonen. Den bør være klar, konsis og lett tilgjengelig for alle ansatte, og ikke gi rom for tvetydighet. En godt utformet AI-sikkerhetspolicy går utover enkle «gjør og ikke gjør» og gir kontekst, og forklarer hvorfor Visse restriksjoner er på plass for å fremme en kultur av sikkerhetsbevissthet snarere enn bare samsvar.

Retningslinjene må eksplisitt definere flere nøkkelområder. For det første bør de liste opp alle sanksjonerte og godkjente AI-verktøy, sammen med prosessen for å be om evaluering av et nytt verktøy. Dette forhindrer spredning av skygge-AI. For det andre må de etablere klare retningslinjer for datahåndtering, som spesifiserer hvilke typer bedriftsinformasjon (f.eks. offentlig, intern, konfidensiell, begrenset) som kan brukes med hvilken kategori AI-verktøy. For eksempel kan det være akseptabelt å bruke et offentlig GenAI-verktøy for å oppsummere offentlig tilgjengelige nyhetsartikler, men det vil være strengt forbudt å bruke det til å analysere konfidensielle økonomiske prognoser. Retningslinjene bør også skissere brukeransvar, konsekvenser for manglende overholdelse og hendelsesresponsprotokollen for mistenkte AI-relaterte brudd, slik at alle forstår sin rolle i å beskytte organisasjonen.

Evaluering av modeller og plugins: Fokus på risikostyring fra tredjeparter basert på AI

Det moderne AI-økosystemet er bygget på en kompleks forsyningskjede av modeller, plattformer og plugins utviklet av tredjeparter. Denne realiteten gjør AI-risikostyring fra tredjeparter til en kritisk pilar i den overordnede sikkerhetsstrategien din. Hver gang en ansatt aktiverer en ny plugin for sin AI-assistent eller utviklingsteamet ditt integrerer et tredjeparts API, utvider de organisasjonens angrepsflate. Hver av disse eksterne komponentene har sitt eget sett med potensielle sårbarheter, retningslinjer for personvern og sikkerhetstiltak, som nå arves av organisasjonen din.

Forretningsinformasjon står for 43 % av sensitive dataeksponeringer for GenAI, etterfulgt av kildekode med 31 % og kundedata med 23 %.

En grundig evalueringsprosess er derfor viktig. Før et tredjeparts AI-verktøy eller -komponent godkjennes for bruk, må det gjennomgå en grundig sikkerhets- og personverngjennomgang. Dette innebærer å granske leverandørens sikkerhetssertifiseringer, datahåndteringspraksis og hendelsesresponskapasitet. Hvilke data samler verktøyet inn? Hvor lagres de, og hvem har tilgang til dem? Har leverandøren en historie med sikkerhetsbrudd? For AI-plugins, som er en voksende vektor for nettleserbaserte angrep, bør kontrollprosessen være enda strengere. Spørsmål å stille inkluderer: Hvilke tillatelser krever plugin-modulen? Hvem er utvikleren? Har koden blitt revidert? Ved å behandle alle tredjeparts AI-tjenester med samme granskingsnivå som alle andre kritiske leverandører, kan du redusere risikoen for at et angrep i forsyningskjeden kompromitterer organisasjonen din.

Implementering av verktøy for risikostyring av kunstig intelligens

Retningslinjer og prosesser er grunnleggende, men de er utilstrekkelige uten teknisk håndheving. Det er her verktøy for risikostyring innen kunstig intelligens blir avgjørende. Disse løsningene gir den nødvendige oversikten og kontrollen for å sikre at sikkerhetspolicyen for kunstig intelligens følges i praksis, ikke bare i teorien. Gitt at det primære grensesnittet for de fleste brukere som samhandler med GenAI er nettleseren, er verktøy som kan operere på dette laget unikt posisjonert til å gi effektivt tilsyn.

Nettleserutvidelser eller -plattformer for bedrifter, som LayerX, tilbyr en kraftig mekanisme for risikostyring innen kunstig intelligens. De kan oppdage og kartlegge all bruk av GenAI på tvers av organisasjonen, og gi en sanntidsoversikt over hvilke brukere som bruker hvilke plattformer. Denne synligheten er det første trinnet i å stenge ned skygge-AI. Derfra kan disse verktøyene håndheve detaljerte, risikobaserte rekkverk. Du kan for eksempel konfigurere en policy som forhindrer brukere i å lime inn tekst identifisert som «konfidensiell» i en offentlig AI-chatbot, eller som advarer brukere før de laster opp et sensitivt dokument. Dette beskyttelseslaget overvåker og kontrollerer dataflyten mellom brukerens nettleser og nettet, og fungerer effektivt som en løsning for forebygging av datatap (DLP) som er spesielt skreddersydd for kunstig intelligens-alderen. De riktige verktøyene for risikostyring innen kunstig intelligens bygger bro mellom policy og virkelighet, og gir de tekniske midlene for å håndheve styringsbeslutningene dine.

Hendelseshåndtering og -respons i AI-alderen

Selv med de beste forebyggende tiltakene kan hendelser fortsatt oppstå. Hvordan organisasjonen din reagerer er en avgjørende faktor for å minimere virkningen av et sikkerhetsbrudd. En effektiv hendelsesplan for AI må være både spesifikk og godt innøvd. Når et varsel utløses, enten det er fra en brukerrapport eller en automatisert deteksjon av et av sikkerhetsverktøyene dine, trenger responsteamet en tydelig strategi å følge.

Det første trinnet er inneslutning. Hvis en bruker utilsiktet har lekket sensitive data til en LLM, er den umiddelbare prioriteten å tilbakekalle tilgang og forhindre ytterligere eksponering. Dette kan innebære å midlertidig deaktivere brukerens tilgang til verktøyet eller til og med isolere maskinen deres fra nettverket. Neste fase er etterforskning. Hvilke data ble lekket? Hvem var ansvarlig? Hvordan sviktet kontrollene våre? Denne rettsmedisinske analysen er avgjørende for å forstå den underliggende årsaken og forhindre en gjentakelse. Til slutt må planen ta for seg utryddelse og gjenoppretting, som inkluderer å varsle berørte parter som loven krever, iverksette tiltak for å få dataene fjernet av AI-leverandøren hvis mulig, og oppdatere sikkerhetspolicyer og -kontroller basert på erfaringene. En moden holdning til AI og risikostyring betyr å være like forberedt på å reagere på en hendelse som du er på å forhindre en.

Sporing og forbedring av din AI-risikoposisjon

Risikostyring knyttet til AI er ikke et engangsprosjekt; det er en kontinuerlig syklus med vurdering, tiltaksreduksjon og forbedring. Trussellandskapet er dynamisk, med stadig nye AI-verktøy og angrepsvektorer. Derfor er det viktig å spore organisasjonens AI-risikoposisjon over tid for å sikre at forsvaret forblir effektivt. Dette krever en forpliktelse til kontinuerlig overvåking og bruk av målinger for å kvantifisere risikonivået og ytelsen til kontrollene dine.

Nøkkelindikatorer for ytelse (KPI-er) kan inkludere antall oppdagede ikke-godkjente AI-verktøy, volumet av forhindrede datalekkasjehendelser og prosentandelen ansatte som har fullført AI-sikkerhetsopplæring. Regelmessige revisjoner og penetrasjonstester, spesielt fokusert på AI-systemer, kan også gi uvurderlig innsikt i svakheter i forsvaret ditt. Ved kontinuerlig å måle og forbedre tilnærmingen din, skaper du et robust sikkerhetsprogram som tilpasser seg de utviklende utfordringene i den AI-drevne verden. Denne proaktive holdningen sikrer at organisasjonen din kan fortsette å utnytte kraften til AI trygt og sikkert, og transformere en potensiell kilde til katastrofal risiko til en godt administrert strategisk fordel.