Um novo vetor para ataques de injeção imediata que ameaça ferramentas de IA comerciais e internas

Os pesquisadores do LayerX identificaram uma nova classe de exploração que visa diretamente essas ferramentas por meio de um vetor anteriormente negligenciado: a extensão do navegador. Isso significa que praticamente qualquer usuário ou organização que têm extensões de navegador instaladas em seus navegadores (como 99% dos usuários corporativos fazem) estão potencialmente expostos a esse vetor de ataque.

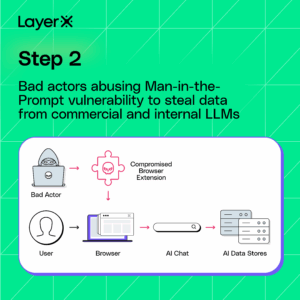

A pesquisa da LayerX mostra que qualquer extensão do navegador, mesmo sem quaisquer permissões especiais, pode acessar os prompts de LLMs comerciais e internos e injetá-los com avisos para roubar dados, exfiltrá-los e encobrir seus rastros.

O exploit foi testado em todos os principais LLMs comerciais, com demonstrações de prova de conceito fornecidas para ChatGPT e Google Gemini.

A implicação para as organizações é que, à medida que se tornam cada vez mais dependentes de ferramentas de IA, esses LLMs – especialmente aqueles treinados com informações confidenciais da empresa – podem ser transformados em 'copilotos hackers' para roubar informações corporativas confidenciais.

A façanha: Homem no prompt

Essa falha decorre da forma como a maioria das ferramentas GenAI são implementadas no navegador. Quando os usuários interagem com um assistente baseado em LLM, o campo de entrada do prompt normalmente faz parte do Modelo de Objeto de Documento (DOM) da página. Isso significa que qualquer extensão de navegador com acesso de script ao DOM pode ler ou gravar diretamente no prompt do AI.

Atores mal-intencionados podem utilizar extensões maliciosas ou comprometidas para realizar atividades nefastas:

- Realizar ataques de injeção imediata, alterando a entrada do usuário ou inserindo instruções ocultas.

- Extrair dados diretamente do prompt, resposta ou sessão.

- Comprometer a integridade do modelo, enganando o LLM para revelar informações confidenciais ou realizar ações não intencionais.

Devido a essa forte integração entre ferramentas de IA e navegadores, os LLMs herdam grande parte da superfície de risco do navegador. A exploração cria efetivamente uma homem no prompt.

O risco é agravado pela ubiquidade de LLMs e extensões de navegador

O risco é amplificado por dois fatores principais:

- Os LLMs contêm dados confidenciais. Em ferramentas comerciais, os usuários frequentemente colam conteúdo proprietário ou regulamentado. Já os LLMs internos são normalmente treinados em conjuntos de dados corporativos confidenciais, o que lhes dá acesso a vastas quantidades de informações sensíveis, desde código-fonte a documentos jurídicos e estratégias de fusões e aquisições.

- As extensões do navegador têm amplos privilégios. Muitos ambientes corporativos permitem que os usuários instalem extensões livremente. Uma vez instalada uma extensão maliciosa ou comprometida no navegador do usuário, ela pode acessar qualquer ferramenta GenAI baseada na web com a qual o usuário interaja.

Se um usuário com acesso a um LLM interno tiver uma única extensão vulnerável instalada, os invasores podem exfiltrar dados silenciosamente, injetando consultas e lendo os resultados, inteiramente dentro dos limites da sessão do usuário.

Todas as aplicações de LLM e IA são afetadas

- LLMs de terceiros: Ferramentas como ChatGPT, Claude, Gemini, Copilot e outras, que são acessadas por meio de aplicativos da web.

- Implantações de LLM empresarial: Copilotos personalizados, assistentes de pesquisa baseados em RAG ou qualquer ferramenta interna criada com um frontend LLM servido via navegador.

- Usuários de aplicativos SaaS habilitados para IA: Aplicativos SaaS existentes que aprimoram seus recursos adicionando integrações de IA e LLMs, que podem ser usados para consultar dados confidenciais do cliente armazenados no aplicativo (como informações do usuário, informações de pagamento, registros de saúde e muito mais).

- Qualquer usuário com risco de extensão do navegador:Principalmente aqueles em funções técnicas, jurídicas, de RH ou de liderança com acesso a dados privilegiados.

| LLM | Vulnerável ao Man-in-the-Prompt | Vulnerável à injeção via bot | # de visitas mensais |

| ChatGPT | ✅ | ✅ | 5 bilhões |

| Gemini | ✅ | ✅ | 400 milhões |

| Copilot | ✅ | ✅ | 160 milhões |

| Claude | ✅ | ✅ | 115 milhões |

| Busca profunda | ✅ | ✅ | 275 milhões |

| Mestrado em Direito Externo | ✅ | ❌ |

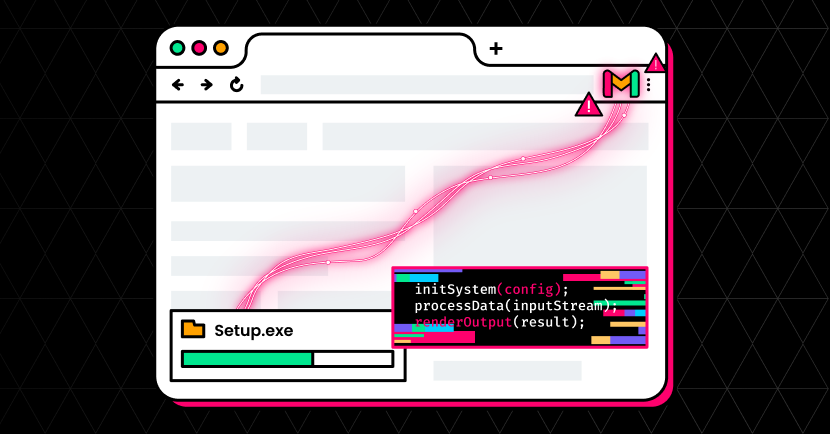

Prova de Conceito nº 1: Transformando o ChatGPT no Copiloto de um Hacker

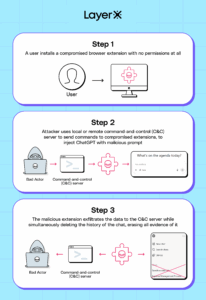

Para demonstrar essa exploração, os pesquisadores da LayerX implementaram uma extensão de prova de conceito que não requer nenhuma permissão especial. Nossa extensão não só foi capaz de injetar um prompt e consultar o ChatGPT para obter informações, mas também foi capaz de exfiltrar os resultados e cobrir seus rastros.

Isto significa que qualquer extensões comprometidas podem abusar dessa técnica para roubar dados do ChatGPT de usuários e empresas.

Como funciona o exploit ChatGPT:

- O usuário instala uma extensão comprometida sem nenhuma permissão.

- Um servidor de comando e controle (que pode ser hospedado local ou remotamente) envia uma consulta à extensão.

- A extensão abre uma aba em segundo plano e consulta o ChatGPT.

- Os resultados são exfiltrados para um log externo.

- A extensão então exclui o chat, para apagar sua existência e ocultar seus rastros. Se o usuário olhasse seu histórico do ChatGPT, não veria nada.

Implicações:

O ChatGPT é a ferramenta de IA mais popular do mundo, com cerca de 5 bilhões de acessos por mês. Também é frequentemente usado por indivíduos e organizações, tanto para fins pessoais quanto comerciais.

De acordo com uma pesquisa da LayerX, 99% dos usuários corporativos têm pelo menos uma extensão de navegador instalada em seus navegadores, e 53% têm mais de 10 extensões.

O fato de que os pesquisadores de segurança do LayerX foram capazes de criar esse exploit sem nenhuma permissão especial mostra como praticamente qualquer usuário é vulnerável a tal ataque.

Nenhuma pontuação de risco de extensão passiva será capaz de detectar tal extensão, pois ela não requer nenhuma permissão. Além disso, o fato de não exigir nenhuma permissão fará com que ela receba pontuações de risco baixas.

Prova de Conceito nº 2: Transformando o Google Gemini em um Hacker Gêmeo Maligno

Como uma segunda prova de conceito para ilustrar essa vulnerabilidade, a LayerX implementou um exploit que pode roubar dados internos de ambientes corporativos usando o Google Gemini por meio de sua integração ao Google Workspace.

Nos últimos meses, o Google lançou novas integrações da Gemini AI no Google Workspace. Atualmente, esse recurso está disponível para organizações que utilizam o Workspace e usuários pagantes.

Essa integração oferece um novo painel lateral em aplicativos da web, como Google Mail, Docs, Meet e outros aplicativos, permitindo que os usuários automatizem tarefas repetitivas e/ou demoradas, como resumir e-mails, fazer perguntas sobre um documento, agregar dados de diferentes fontes, etc.

Uma das características que torna a integração Gemini única é que ela tem acesso a todos os dados acessíveis ao usuário em seu Workspace. Isso inclui e-mail, documentos (no Google Drive), pastas compartilhadas e contatos. Uma distinção importante, no entanto, é que o Gemini pode acessar não apenas arquivos e dados de propriedade direta do usuário, mas qualquer pasta, arquivo ou dados que foram compartilhados com eles e para os quais eles têm permissões de acesso.

O Google já está ciente das tentativas de exploração do seu mecanismo de IA Gemini e tem tentativas amplamente documentadas de explorar Gemini para fins nefastos. No entanto, até o momento, eles não abordaram o risco de extensões de navegador serem usadas como um veículo para acessar dados pessoais dos usuários por meio de prompts do Gemini Workspace, indicando que esse é um método novo.

Como funciona o Gemini Exploit

A nova integração Gemini é implementada diretamente na página como código adicionado sobre a página existente. Ela modifica e grava diretamente no Document Object Model (DOM) do aplicativo web, dando a ele controle e acesso a todas as funcionalidades do aplicativo.

Etapa 1: o usuário usa uma conta do Google Workspace Pro com integração Gemini

No entanto, a LayerX descobriu que, da forma como essa integração é implementada, qualquer extensão do navegador, sem permissões especiais de extensão, pode interagir com o prompt e inserir prompts nele. Como resultado, praticamente qualquer extensão pode acessar o prompt da barra lateral do Gemini e consultá-lo para obter quaisquer dados que desejar.

Além disso, o acesso persiste mesmo se a barra lateral estiver fechada ou mesmo se a extensão manipular ativamente o código da página para ocultar a interface do prompt do Gemini.

Depois que a extensão insere o código no prompt, ele se comporta como qualquer outra consulta de texto. Exemplos de ações que ela pode realizar incluem:

- Extraia títulos e conteúdos de e-mails

- Consultar informações sobre pessoas que aparecem na lista de contatos do usuário

- Listar todos os documentos acessíveis

- Estruture consultas complexas para solicitar dados específicos de e-mails e arquivos acessíveis

- Explore a funcionalidade de preenchimento automático integrada para enumerar arquivos acessíveis

- Adicione permutações para listar todos os arquivos e solicitar resultados

- Et cetera.

Etapa 2: assim que a barra lateral é fechada, uma extensão comprometida injeta uma consulta no prompt do Gemini, recupera arquivos confidenciais do usuário e exfiltra informações.

A LayerX divulgou essa vulnerabilidade ao Google sob medidas de divulgação responsáveis.

Quais dados os hackers podem acessar por meio da exploração do Gemini

A integração do Gemini Workspace do Google pode acessar quaisquer dados acessíveis ao usuário. Isso inclui não apenas arquivos e informações de propriedade do usuário e armazenados em seus diretórios, mas também quaisquer arquivos ou dados que foram compartilhados com ele e para os quais o usuário tenha permissão de leitura. Isso inclui:

- E-mails

- Contactos

- Conteúdo do arquivo

- Pastas compartilhadas (e seus conteúdos)

- Convites para reuniões

- Resumos de reuniões

No entanto, além de acessar diretamente arquivos e dados acessíveis ao usuário, o Gemini pode ser usado para analisar dados em grande escala sem a necessidade de extrair arquivos individuais. Exemplos de consultas que ele pode realizar incluem:

- Listar todos os clientes

- Resumos de chamadas

- Informações sobre pessoas e contatos

- Pesquisar informações específicas (como PII ou outra propriedade intelectual da empresa)

- E mais…

LLMs internos são particularmente expostos

Embora ferramentas comerciais de IA como ChatGPT e Gemini sejam pontos de entrada populares para uso do GenAI, algumas das alvos mais importantes para esta façanha são LLMs implantados internamente—aqueles construídos e ajustados por empresas para atender sua própria força de trabalho.

Ao contrário dos modelos voltados para o público, os LLMs internos são frequentemente treinados ou complementados com dados organizacionais altamente sensíveis e proprietários:

- Propriedade intelectual, como código-fonte, especificações de design e roteiros de produtos

- Documentos legais, contratos e estratégia de fusões e aquisições

- Previsões financeiras, PII e registros regulamentados

- Comunicações internas e dados de RH

O objetivo desses copilotos internos ou sistemas baseados em RAG é capacitar os funcionários a acessar essas informações de forma mais rápida e inteligente. Mas essa mesma conveniência se torna um problema quando o acesso baseado em navegador é associado a um risco de extensão invisível.

Por que os LLMs internos são especialmente vulneráveis

- Acesso de alta confiança:Os modelos internos geralmente pressupõem uso confiável e não são protegidos contra entradas adversárias ou automação silenciosa de dentro da sessão do navegador do usuário.

- Consultas não restritas: Os usuários geralmente podem enviar perguntas livres e receber respostas completas, com poucas salvaguardas que impeçam a extração de conjuntos de dados confidenciais, especialmente por meio de prompts inteligentemente elaborados.

- Segurança de rede assumida: Como esses LLMs são hospedados na infraestrutura da organização ou por trás de uma VPN, eles são erroneamente percebidos como seguros. Mas o acesso pelo navegador quebra essa barreira.

- Invisibilidade para ferramentas existentes:As soluções de segurança tradicionais, como CASBs, SWGs ou DLP, têm sem visibilidade sobre como ocorre a manipulação do prompt no nível do DOM ou o que está sendo consultado e retornado.

Um cenário realista

Considere um analista de segurança consultando um LLM interno sobre cronogramas de resposta a incidentes anteriores ou um engenheiro de roadmap revisando notas de lançamento futuras. Uma extensão maliciosa em segundo plano poderia injetar silenciosamente uma consulta oculta ("Resumir todos os recursos de produtos não lançados mencionados nesta sessão") e encaminhar a resposta para um servidor externo — sem disparar nenhum alerta de segurança.

Em essência, um único navegador comprometido em um ponto de extremidade confiável se torna um canal de ataque para exfiltrar ativos de conhecimento de alto valor do cérebro de IA da organização.

As consequências

- Vazamento de IP: Algoritmos proprietários, bases de código e segredos comerciais podem ser roubados silenciosamente.

- Exposição Regulatória: Consultas envolvendo informações pessoais identificáveis (PII) de clientes, registros de saúde ou dados financeiros podem levar a violações de conformidade com GDPR, HIPAA ou SOX.

- Erosão da confiança:A segurança percebida das ferramentas internas desmorona se respostas confidenciais vazam por canais não detectados.

Algumas extensões na Chrome Store já podem fazer isso

De fato, algumas extensões na Chrome Web Store já oferecem injeção e edição imediatas.

Extensões como Arqueiro Rápido, Gerenciador de prompts e Pasta de prompt todos fornecem funcionalidades que leem, armazenam e gravam em prompts de IA.

Embora essas extensões pareçam legítimas, elas destacam como extensões que interagem com prompts de IA são válidas e aceitáveis nas lojas do Chrome e do Edge. Além disso, a maioria dessas extensões exige apenas permissões limitadas dos usuários, destacando como a interação com prompts de IA pode ser feita sem nenhuma permissão especial.

Implicações para as empresas

Essa ameaça expõe um sério ponto cego nos atuais esforços de governança da GenAI. Ferramentas de segurança tradicionais, como DLP de endpoint, gateways web seguros (SWGs) ou CASBs, não têm visibilidade das interações no nível do DOM que permitem essa exploração. Elas não conseguem detectar injeção de prompts, acesso não autorizado a dados ou o uso de prompts manipulados.

Além disso, as políticas de acesso da GenAI (por exemplo, bloqueio do ChatGPT via URL) não fornecem proteção para ferramentas internas hospedadas em domínios ou IPs permitidos.

Como mitigar esse risco:

As organizações precisam mudar sua mentalidade de segurança de controle em nível de aplicação para inspeção de comportamento no navegador. Isso inclui:

- Monitoramento de interações DOM dentro das ferramentas GenAI e detectando ouvintes ou webhooks que podem interagir com prompts de IA.

- Bloqueio de extensões arriscadas com base no risco comportamental, não apenas em listas de permissões. Como uma avaliação estática baseada em permissões não será suficiente (já que algumas extensões não exigirão nenhuma permissão), combinar a reputação do publicador com a análise dinâmica de extensões é a melhor maneira de detectar extensões arriscadas e maliciosas.

Prevenção de adulteração e exfiltração imediatas em tempo real na camada do navegador.