A rápida integração da IA generativa nos fluxos de trabalho diários criou uma lacuna significativa de visibilidade para as equipes de segurança corporativa. Os funcionários não esperam mais pela aprovação da TI para adotar novas ferramentas. Eles buscam ativamente extensões de navegador e chatbots baseados na web para aumentar sua produtividade. Essa adoção descentralizada tornou as defesas de perímetro tradicionais amplamente ineficazes. Não se pode proteger o que não se vê. Para retomar o controle sobre esse ecossistema em expansão, as organizações devem iniciar uma auditoria abrangente de IA.

Este processo não é um mero exercício de conformidade. É um requisito operacional crítico para 2025. O objetivo é descobrir os aplicativos e fluxos de dados específicos que existem atualmente em seu ambiente. Ao identificar o uso não autorizado, muitas vezes chamado de "IA paralela", você pode começar a quantificar sua exposição real ao risco. Uma auditoria eficaz transforma sua postura de segurança, passando de uma abordagem reativa de combate a incêndios para uma governança proativa. Ela permite que você entenda não apenas quais ferramentas estão presentes, mas como elas estão sendo usadas e quais dados corporativos as alimentam.

O Escopo Oculto da IA Sombra

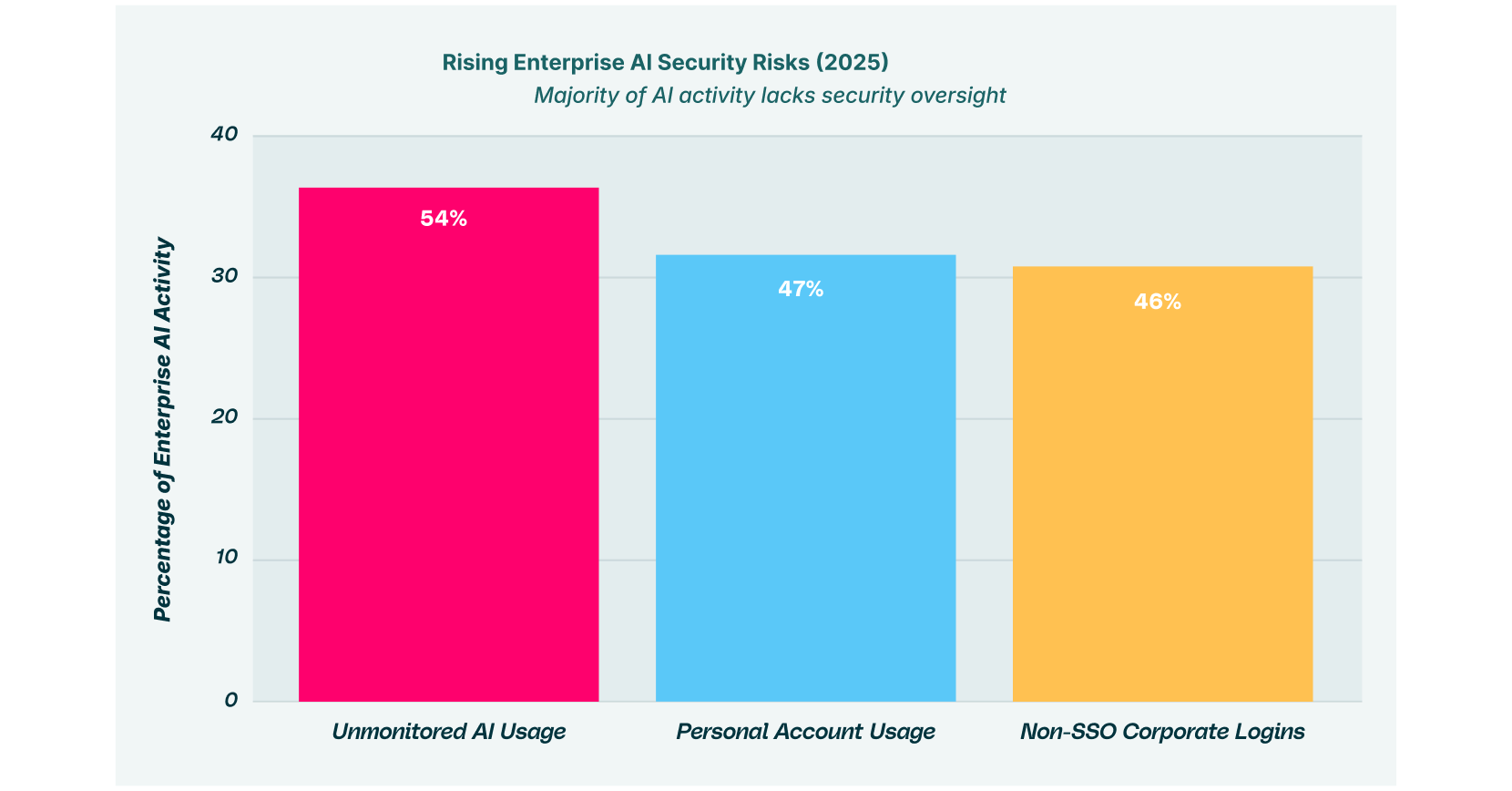

Como ilustrado na Figura 1 acima, a escala da atividade não monitorada costuma ser chocante para os líderes de segurança. Quando 89% do uso de IA ocorre fora da supervisão corporativa, os registros de segurança padrão não conseguem fornecer uma visão precisa do risco. Os funcionários frequentemente usam contas de e-mail pessoais para acessar esses serviços, ignorando os protocolos de Single Sign-On (SSO) que normalmente acionariam uma trilha de auditoria. Isso cria um cenário de identidades fragmentado, onde os dados corporativos residem em contas que a TI não pode acessar ou desativar.

Uma auditoria de IA serve como o principal mecanismo para elucidar essa atividade invisível. Ela vai além da análise de tráfego em nível de rede, que muitas vezes tem dificuldades para decifrar o conteúdo das sessões web modernas. Em vez disso, uma auditoria centrada no navegador examina a renderização das páginas web e a execução de extensões. Esse nível de detalhamento é necessário para distinguir entre uma visita inofensiva a um blog de tecnologia e uma sessão ativa onde código proprietário está sendo inserido em um chatbot para otimização.

Essa visibilidade é crucial para mapear sua "superfície de ataque". Cada extensão de navegador não monitorada é um ponto de entrada potencial para ataques à cadeia de suprimentos. Cada conta pessoal do GenAI é um potencial ponto de vazamento de dados. Ao trazer esses ativos ocultos à luz, você dá o primeiro passo definitivo rumo a um ambiente de navegador corporativo seguro.

Construindo sua estrutura de auditoria de IA

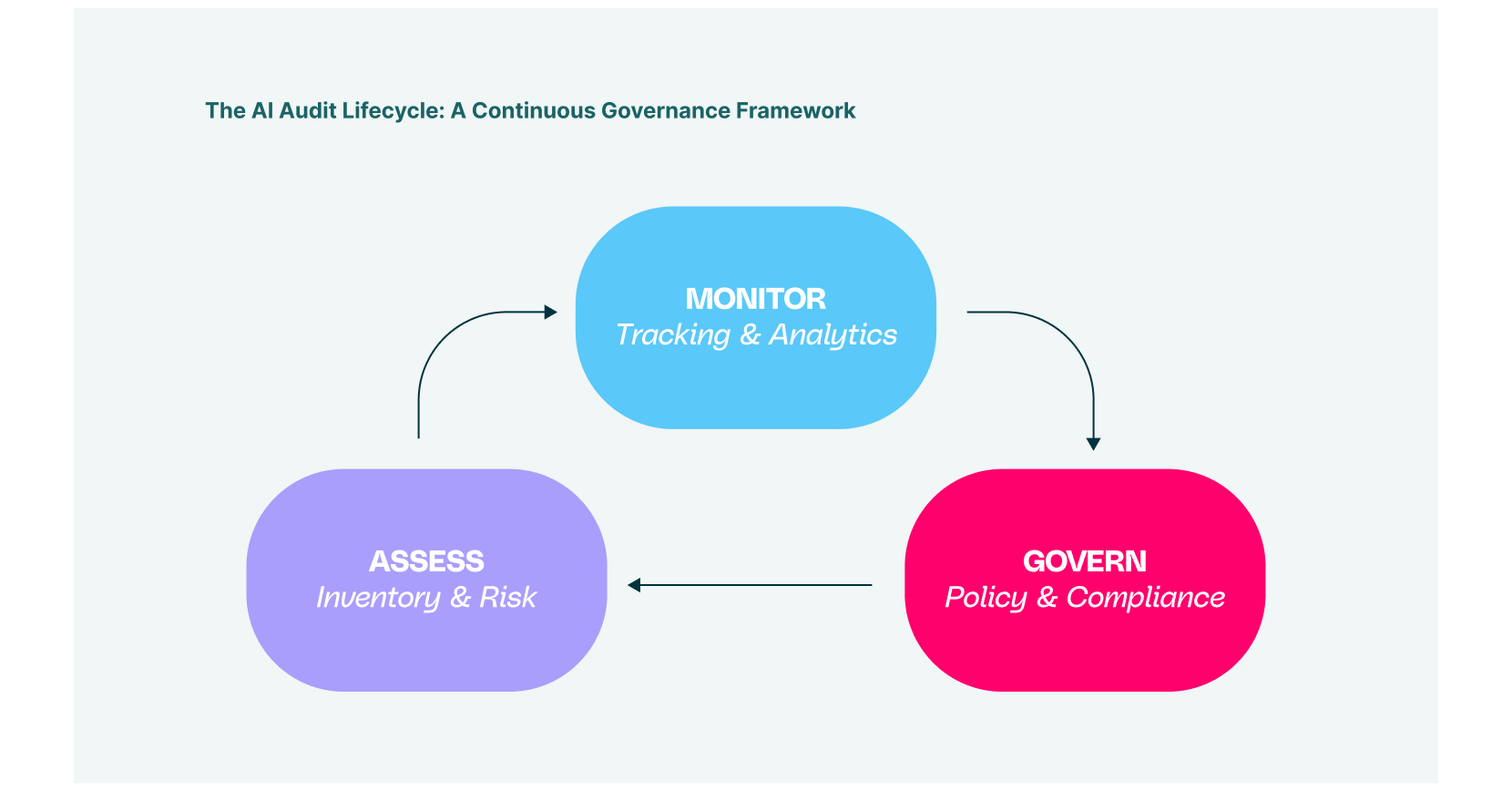

Estabelecer uma abordagem estruturada é essencial para o sucesso. Uma revisão esporádica ou pontual produzirá apenas resultados parciais. Os líderes de segurança devem, em vez disso, adotar uma estrutura de auditoria de IA cíclica que trate a segurança como um processo contínuo, e não como um evento isolado. Essa estrutura deve levar em conta a natureza dinâmica do mercado de IA de geração de dados (GenAI), onde novos modelos com recursos inovadores são lançados semanalmente.

A estrutura se baseia em três pilares fundamentais: Avaliação, Monitoramento e Governança. Essas fases são interconectadas. Sua avaliação orienta sua estratégia de monitoramento, que, por sua vez, gera os dados necessários para uma governança eficaz. Ao contrário de ativos de software estáticos, os modelos de IA evoluem com base em suas entradas e dados de treinamento. Portanto, sua estrutura de auditoria de IA deve ser ágil o suficiente para se adaptar a essas mudanças sem exigir uma reformulação completa de suas políticas a cada trimestre.

Fase 1: Avaliação e Descoberta de Ativos

O ciclo de vida começa com um rigoroso processo de inventário. A fase inicial da sua auditoria de segurança de IA deve focar na descoberta completa. Isso vai muito além de simplesmente listar os fornecedores pelos quais você paga atualmente. Você precisa identificar todos os pontos de contato digitais onde os dados corporativos interagem com um modelo algorítmico. Na empresa moderna, essa interação ocorre predominantemente no navegador web, tornando-o o sensor mais crítico em sua estrutura de segurança.

As equipes de segurança precisam implementar ferramentas capazes de inspecionar o tráfego do navegador para identificar chamadas de API para serviços de IA. Isso inclui plataformas importantes como OpenAI e Anthropic, mas também a vasta gama de milhares de ferramentas de IA de nicho para produtividade. Uma auditoria completa de segurança de IA geralmente revela centenas de aplicativos não aprovados, desde corretores gramaticais até aplicativos automatizados para anotações de reuniões, que se instalaram silenciosamente no fluxo de trabalho corporativo.

É fundamental também categorizar esses ativos de acordo com seu perfil de risco. A ferramenta reivindica a propriedade dos dados de entrada? Ela compartilha dados com terceiros para fins de treinamento? Seu inventário deve diferenciar entre instâncias "Empresariais" que oferecem garantias de privacidade de dados e versões "Para Consumidores" que não oferecem. Essa distinção costuma ser o que diferencia um fluxo de trabalho seguro de uma violação de conformidade.

Fase 2: Análise Detalhada da Auditoria de Segurança de IA/ML

Após estabelecer um inventário claro, o foco muda para os próprios modelos. Embora a maioria das empresas consuma IA via SaaS, aquelas que desenvolvem ferramentas internas enfrentam um conjunto único de desafios. Uma auditoria de segurança de IA/ML é necessária para avaliar a integridade do modelo e seu pipeline de treinamento. É aqui que você examina minuciosamente os "ingredientes" de seus projetos internos de IA.

Este tipo específico de auditoria examina a proveniência dos seus dados e a segurança das suas bibliotecas. Você está usando componentes de código aberto com vulnerabilidades conhecidas? Os dados de treinamento utilizados nos seus modelos estão livres de ataques de envenenamento? Em uma auditoria de segurança de IA/ML, você busca por fragilidades que um adversário poderia explorar para manipular a saída do modelo ou inferir dados de treinamento sensíveis por meio de ataques de inversão.

Por exemplo, imagine um cenário em que um modelo financeiro interno seja treinado com dados públicos não tratados. Se esses dados contiverem padrões maliciosos ocultos, o modelo poderá ser enganado e fazer previsões errôneas. Ao testar a resistência dos seus modelos proprietários contra essas técnicas adversárias, você garante que suas inovações internas não se tornem um problema. Esse nível de rigor é essencial para organizações que implementam agentes de IA voltados para o cliente.

Combatendo os riscos de vazamento de dados

Talvez a preocupação mais premente para os CISOs hoje seja a exfiltração de dados. É surpreendentemente fácil para um funcionário colar inocentemente uma lista de clientes confidenciais em um chatbot para "formatá-la direitinho". Essa simples ação constitui uma violação de dados. Uma auditoria de segurança de dados com IA se concentra especificamente nesses fluxos de dados para evitar perdas irreversíveis.

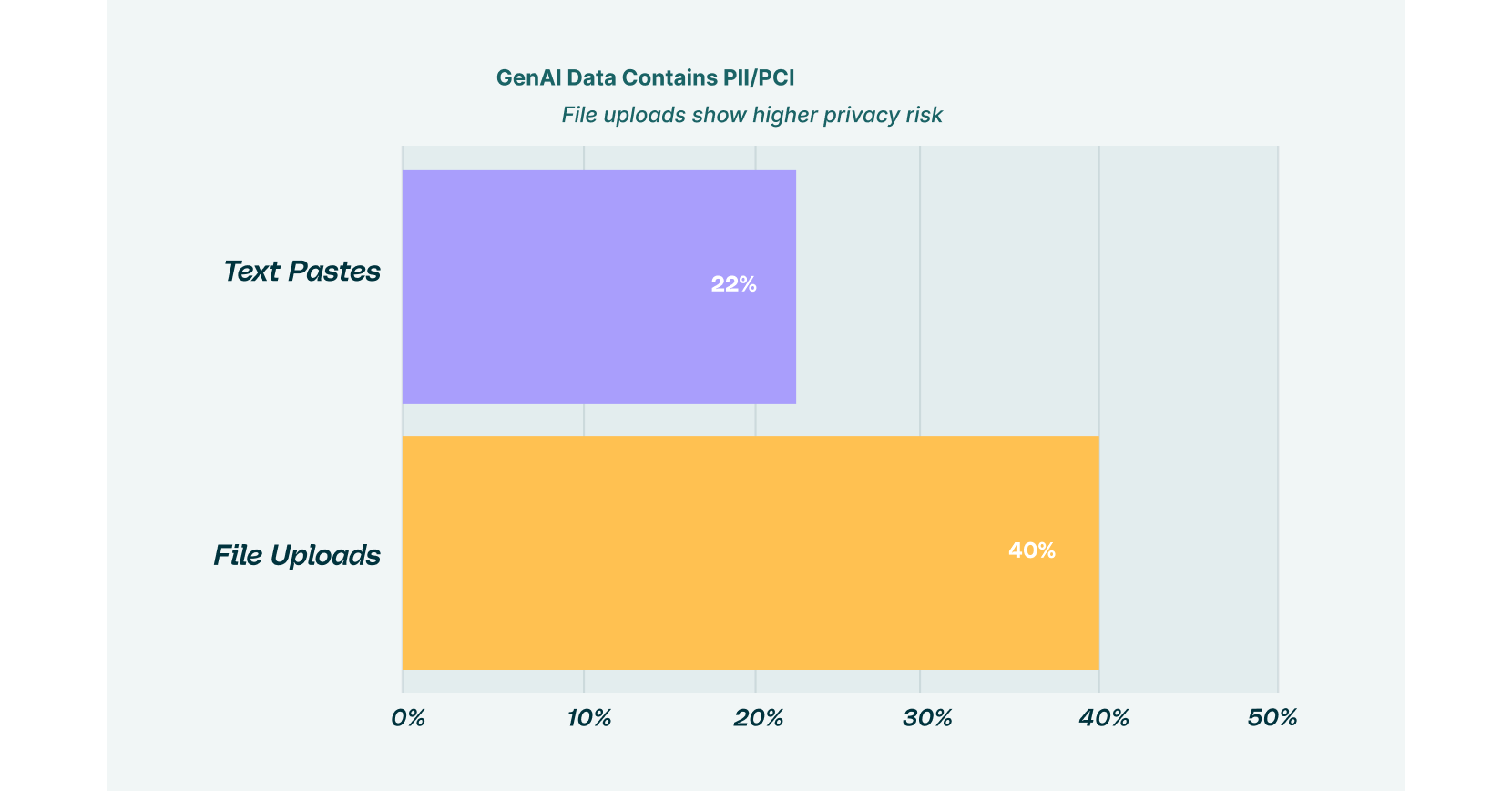

O navegador funciona como porta de entrada para esses dados. Colagens de texto, uploads de arquivos e envios de formulários são os principais mecanismos de exfiltração. Sua auditoria precisa categorizar essas interações com precisão. Não basta saber que um usuário visitou um site da GenAI; você precisa saber o que ele enviou e por quê.

Realização de uma auditoria de segurança de dados de IA

Como demonstra a Figura 3, o envio de arquivos é particularmente perigoso. Os documentos frequentemente contêm dados não estruturados, projeções financeiras, estratégias jurídicas e informações pessoais identificáveis (PII), que são mais difíceis de filtrar do que simples sequências de texto. Uma auditoria rigorosa de segurança de dados com IA implementará regras de DLP (Prevenção de Perda de Dados) que analisam esses envios em tempo real. Isso garante que os arquivos que correspondam a padrões sensíveis sejam bloqueados antes mesmo de saírem do navegador.

Você também deve considerar o contexto dos dados. Um desenvolvedor colando código em uma ferramenta de IA segura e aprovada pela empresa pode ser aceitável. Já o mesmo desenvolvedor colando o mesmo código em um chatbot público e gratuito representa um risco elevado. Sua auditoria de segurança de dados de IA deve ajudá-lo a definir esses limites contextuais. Ela permite que você crie políticas suficientemente detalhadas para impedir comportamentos inadequados sem bloquear o trabalho legítimo.

Além disso, esse processo de auditoria deve avaliar o risco de "injeção indireta". Isso ocorre quando instruções maliciosas são ocultadas no conteúdo processado por uma IA. Se seus funcionários usam IA para resumir páginas da web ou e-mails, eles podem estar vulneráveis a ataques indiretos que manipulam a IA para extrair dados. Sua auditoria deve verificar se suas ferramentas de segurança do navegador conseguem detectar e isolar essas ameaças potenciais.

Monitoramento contínuo com BDR

Uma auditoria que termina com um relatório estático em PDF é uma auditoria falha. As conclusões devem evoluir para um estado de monitoramento ativo e contínuo. É aqui que o conceito de Detecção e Resposta de Navegador (BDR) se torna essencial para a estrutura de auditoria com IA. As ferramentas de BDR fornecem a telemetria necessária para manter a fase de "Monitoramento" do ciclo de vida, transformando um instantâneo em um fluxo de vídeo ao vivo da sua postura de segurança.

O BDR oferece visibilidade do DOM (Document Object Model) real da página da web. Isso permite que as equipes de segurança vejam exatamente como os usuários interagem com as ferramentas de IA em tempo real. É possível rastrear quais extensões estão sendo instaladas, quais formulários estão sendo preenchidos e para onde os dados estão trafegando. Esse fluxo contínuo de dados garante que sua auditoria de IA permaneça relevante mesmo com a mudança no comportamento do usuário.

Essa capacidade de monitoramento em tempo real é crucial para identificar desvios de uso. Com o tempo, as ferramentas aprovadas podem alterar seus termos de serviço, ou os funcionários podem voltar a usar contas pessoais não autorizadas. O monitoramento contínuo detecta essas mudanças imediatamente. Ele permite que você intervenha no momento em que um novo risco surge, em vez de esperar pelo próximo ciclo de avaliação anual.

Governança e Aplicação de Políticas

A peça final do quebra-cabeça é a governança. Regulamentações como a Lei de IA da UE e diversas leis de privacidade de dados exigem rigorosa prestação de contas. Sua estrutura de auditoria de IA deve gerar os artefatos necessários para comprovar a conformidade. Isso envolve documentar não apenas quais ferramentas são usadas, mas também como as decisões são tomadas em relação à sua aprovação e uso.

Se uma auditoria de segurança de IA/ML revelar um modelo de alto risco, o registro de governança deve mostrar as medidas corretivas tomadas. O modelo foi desativado? Foram implementadas proteções adicionais? A geração automatizada de relatórios é vital nesse processo. As equipes de segurança não podem se dar ao luxo de gastar semanas compilando planilhas manualmente para os auditores. Relatórios baseados em painéis que extraem dados diretamente da telemetria do navegador garantem que suas evidências estejam sempre prontas e precisas.

Essa camada de governança também permite políticas de "orientação". Em vez de uma abordagem binária de "permitir" ou "bloquear", que muitas vezes leva os usuários à TI paralela (Shadow IT), você pode implementar a educação do usuário em tempo real. Se um usuário tentar uma ação arriscada, o navegador pode intervir com um pop-up explicando o risco e sugerindo uma alternativa segura. Isso respeita a intenção do usuário de ser produtivo, ao mesmo tempo que impõe os limites de segurança necessários.

Como integrar a IA na sua empresa?

A integração da IA nas empresas é inevitável. As organizações que prosperarão nesta nova era serão aquelas que conseguirem aproveitar seu poder com segurança, sem comprometer seus dados. Uma auditoria de IA dedicada é o passo fundamental nessa jornada. Ela dissipa a névoa da IA oculta, identifica as brechas por onde os dados podem vazar e estabelece um ritmo de melhoria contínua.

Ao adotar uma estrutura de auditoria de IA com foco no navegador, você coloca a segurança exatamente onde o trabalho acontece. Você obtém a visibilidade necessária para avaliar riscos com precisão, o poder de monitorar interações em tempo real e a sabedoria para governar com nuances. Comece sua avaliação hoje mesmo. Faça um inventário de seus ativos, analise seus fluxos de dados e proteja o navegador. O futuro da inteligência da sua empresa depende disso.