Com a corrida das organizações para a adoção da IA GenAI, a implementação de uma segurança eficaz para o ChatGPT tornou-se a principal prioridade para os CISOs em 2026. Este guia analisa as principais soluções que previnem o vazamento de dados, bloqueiam injeções de prompts e controlam o uso de IA não autorizada sem comprometer a produtividade da força de trabalho.

O que são as ferramentas de segurança do ChatGPT e por que elas são importantes?

As ferramentas de segurança ChatGPT são soluções especializadas projetadas para monitorar, governar e proteger a interação entre usuários corporativos e plataformas de IA generativa. Ao contrário dos firewalls tradicionais ou dos sistemas DLP legados, essas ferramentas se integram diretamente ao fluxo de trabalho do usuário, geralmente dentro do navegador, para inspecionar solicitações e respostas em tempo real. Elas impedem que os funcionários colem acidentalmente informações pessoais identificáveis (PII) ou endereços IP confidenciais em modelos públicos, além de bloquear extensões maliciosas que tentam sequestrar sessões.

Para os líderes de segurança corporativa, essas ferramentas são a única linha de defesa contra a superfície de ataque "do navegador à nuvem". Com o ChatGPT se tornando o sistema operacional padrão para muitas funções, o risco de SaaS paralelo explodiu. Ferramentas de segurança dedicadas fornecem a visibilidade necessária para verificar quais aplicativos de IA estão realmente em execução, garantindo que os dados corporativos permaneçam isolados de modelos de treinamento públicos e que todo o uso esteja em conformidade com as novas regulamentações de 2026.

Principais tendências de segurança do ChatGPT para acompanhar em 2026

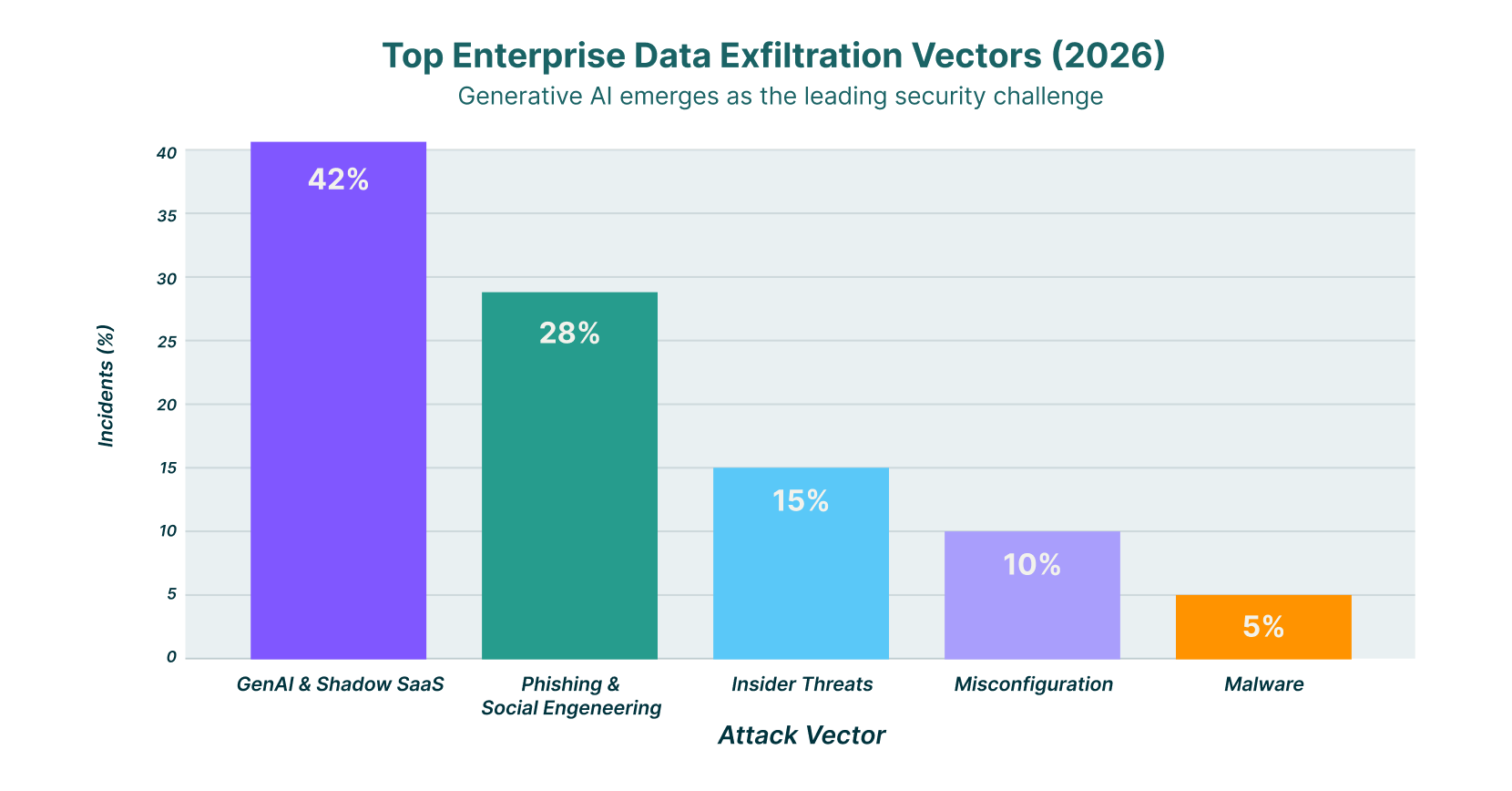

Em 2026, a IA ultrapassou oficialmente o phishing como o principal vetor de exfiltração de dados em empresas. Os atacantes não estão mais apenas tentando roubar credenciais; eles estão manipulando os próprios modelos de IA. Novas pesquisas revelaram vulnerabilidades como "ZombieAgent" e "HackedGPT", em que os atacantes usam injeção indireta de prompts para transformar o assistente de IA do próprio funcionário em uma ferramenta para exfiltrar dados privados e histórico de conversas.

A ascensão da "IA Agenética", em que sistemas de IA podem executar ações de forma autônoma, introduziu novos riscos significativos. Navegadores que integram esses agentes, como o ChatGPT Atlas, apresentam vulnerabilidades que permitem que extensões maliciosas contornem as barreiras de segurança padrão. Essa mudança significa que as equipes de segurança não podem mais simplesmente bloquear URLs; elas precisam monitorar a intenção real e a lógica de execução dos agentes de IA em execução na sessão do navegador.

A comercialização de crimes cibernéticos com IA também está remodelando o cenário de ameaças. Plataformas de "jailbreak como serviço" agora são vendidas na dark web, permitindo que até mesmo atacantes com pouca experiência contornem as proteções de segurança dos sistemas de gerenciamento de vida corporativos. Em resposta, a pressão regulatória está forçando as organizações a comprovarem que possuem supervisão humana e governança de dados granular para cada interação com IA, transformando a conformidade de um mero cumprimento de requisitos em uma exigência operacional contínua.

8 Melhores Ferramentas de Segurança para ChatGPT em 2026

A lista a seguir destaca as principais soluções para proteger o uso do GenAI, desde plataformas nativas de navegador até firewalls dedicados ao GenAI.

| Solução | Principais características | Destaques |

| LayerX | DLP em tempo real no navegador, rastreamento completo de conversas e bloqueio de IA oculta. | Proteção universal em qualquer navegador |

| Islândia | Ambiente de navegador empresarial completo, DLP integrado, sessões isoladas | Equipes substituindo navegadores padrão |

| Segurança Harmônica | Proteção de dados "sem intervenção", visibilidade de conformidade e monitoramento de IA oculta. | Governança de dados sem atritos |

| QuadradoX | Detecção de extensões maliciosas, isolamento de arquivos, proteção nativa do navegador | Impedindo ataques do lado do cliente |

| Segurança Menlo | Isolamento remoto do navegador (RBI), proteção contra colagem e controles de upload de arquivos. | Isolamento de usuários de alto risco |

| Koi Security | Descoberta de TI paralela, avaliação de risco de extensão e prevenção de venda de dados. | Gerenciando os riscos das extensões do navegador |

| Segurança rápida | Proteção imediata contra injeções, detecção de TI paralela e moderação de conteúdo. | Prevenção de ataques baseados em prompts |

| Segurança Seráfica | Prevenção de exploração, anti-phishing, controles de dados refinados | Prevenção de exploits em navegadores |

1. LayerX

LayerX é uma plataforma de segurança nativa do navegador que oferece proteção em tempo real contra vazamento de dados do ChatGPT e ameaças transmitidas pela web. Distribuída como uma extensão leve, ela transforma qualquer navegador comercial em um ambiente de trabalho seguro sem exigir uma nova infraestrutura de navegador. O LayerX oferece visibilidade completa das interações do usuário, capturando todo o contexto da conversa, incluindo mensagens e respostas, para detectar quando dados sensíveis, como informações pessoais identificáveis (PII) ou código-fonte, estão sendo compartilhados.

Além do monitoramento, o LayerX aplica ativamente políticas granulares para bloquear ações de risco antes que elas aconteçam. Ele pode desativar a função "colar" para tipos de dados específicos, bloquear extensões de navegador não autorizadas que tentam ler sessões do ChatGPT e eliminar a IA oculta restringindo o acesso a ferramentas não autorizadas. Sua capacidade de agir no nível da sessão garante que a segurança acompanhe o usuário, seja ele um dispositivo gerenciado ou um dispositivo BYOD (Traga Seu Próprio Dispositivo).

2. ilha

A Island adota uma abordagem diferente, substituindo o navegador padrão do consumidor por um "Navegador Empresarial" dedicado. Isso proporciona às equipes de TI controle total sobre todo o ambiente de navegação, incluindo a capacidade de incorporar controles de segurança diretamente na interface do usuário. O mecanismo DLP integrado da Island pode impedir que dados confidenciais sejam colados no ChatGPT, restringir o envio de arquivos e até mesmo bloquear capturas de tela de sessões sensíveis.

Para 2026, a Island integrou recursos como o "Assistente de IA da Island", que permite aos usuários acessar as funcionalidades do ChatGPT em uma barra lateral controlada e totalmente monitorada pelas políticas corporativas. Isso garante que os funcionários tenham acesso a ferramentas de produtividade, enquanto a organização mantém limites rigorosos em relação à movimentação de dados. É uma solução poderosa para organizações que desejam migrar sua força de trabalho para uma nova interface de navegador.

3. Segurança Harmônica

A Harmonic Security adota uma filosofia de proteção de dados "zero toque", visando impedir vazamentos de dados sem sufocar a inovação ou frustrar os funcionários. A plataforma prioriza a visibilidade, identificando o uso de "IA paralela" para que as equipes de segurança possam ver exatamente quais ferramentas estão sendo acessadas e quais dados estão sendo transmitidos para elas. Ela utiliza modelos de proteção de dados predefinidos para identificar informações sensíveis sem a necessidade de configurações manuais complexas.

A solução foi projetada para ajudar as organizações a adotarem a IA, fornecendo as salvaguardas de conformidade necessárias. A Harmonic monitora os dados em repouso e em trânsito, garantindo que o uso de ferramentas como o ChatGPT pelos funcionários esteja em conformidade com as políticas de privacidade. Sua abordagem descomplicada é ideal para culturas que priorizam a agilidade e desejam evitar políticas de bloqueio rigorosas.

4. SquareX

A SquareX concentra-se em neutralizar ameaças do lado do cliente que visam o navegador, incluindo extensões maliciosas e ataques baseados em arquivos. Sua plataforma é particularmente eficaz na detecção de extensões "Shadow IT" que os usuários podem instalar para aprimorar sua experiência com o ChatGPT, mas que, na verdade, coletam registros de bate-papo confidenciais. A SquareX isola esses riscos em tempo real, impedindo a execução de código não autorizado na sessão do navegador.

Em 2026, a SquareX expandiu suas capacidades para proteger contra a "falsificação de barra lateral por IA", uma técnica na qual os atacantes imitam assistentes de IA para enganar os usuários e obter suas credenciais. Ao monitorar o DOM em busca de modificações suspeitas, a SquareX garante que a interface do ChatGPT com a qual os usuários interagem seja genuína e segura. Isso a torna uma ferramenta essencial para organizações preocupadas com a engenharia social sofisticada baseada em navegadores.

5. Menlo Security

A Menlo Security utiliza sua tecnologia principal de Isolamento Remoto de Navegador (RBI) para criar uma camada de segurança entre o usuário e as plataformas GenAI. Ao executar a sessão do navegador em um contêiner remoto, a Menlo garante que nenhum código malicioso de uma ferramenta de IA comprometida possa alcançar o endpoint. Para proteção de dados, aplica controles rigorosos de copiar e colar, impedindo que os usuários movam dados confidenciais de sua área de transferência local para a sessão remota do ChatGPT.

A plataforma também inspeciona os arquivos enviados para as ferramentas GenAI, removendo metadados e buscando ameaças ocultas antes do processamento dos arquivos. Essa abordagem de isolamento é altamente eficaz para usuários ou departamentos de alto risco que interagem frequentemente com conteúdo externo não confiável. Ela permite que as organizações aproveitem os benefícios de produtividade do ChatGPT, mantendo uma postura de "Confiança Zero" em relação ao conteúdo da web.

6. Segurança Koi

A Koi Security é especializada na gestão dos riscos associados a extensões de navegador, um dos principais vetores de vazamento de dados em ambientes de IA GenAI. Sua plataforma inventaria todas as extensões instaladas e as classifica com base em suas práticas de coleta de dados, sinalizando aquelas que comprovadamente vendem dados de usuários ou leem o histórico de navegação. Essa visibilidade ajuda as equipes de TI a identificar assistentes de escrita com IA "gratuitos" que, na verdade, estão monetizando a propriedade intelectual corporativa.

Ao bloquear extensões de alto risco, o Koi impede que ferramentas de terceiros extraiam o texto dentro das janelas do ChatGPT. Isso garante que conversas confidenciais permaneçam privadas e não sejam extraídas silenciosamente por processos em segundo plano. Para organizações com uma grande força de trabalho descentralizada que utiliza o Chrome ou o Edge, o Koi fornece uma camada essencial de governança sobre o ecossistema de extensões de navegador.

7. Segurança imediata

A Prompt Security concentra-se em proteger todo o ciclo de vida da adoção de IA generativa, desde o uso de ferramentas públicas pelos funcionários até o desenvolvimento de aplicativos internos de aprendizado de máquina. Sua plataforma inspeciona cada solicitação e resposta do modelo para evitar a exposição de dados e bloquear ataques de injeção de solicitações. Inclui módulos específicos para detecção de "IA paralela", ajudando as equipes de TI a descobrir e categorizar todas as ferramentas de IA generativa em uso na rede.

A ferramenta se destaca na moderação e higienização de conteúdo. Ela pode redigir automaticamente informações sensíveis de prompts em tempo real, garantindo que dados pessoais nunca saiam do perímetro da organização. Para empresas que desenvolvem seus próprios agentes de IA, o Prompt Security oferece proteção contra tentativas de jailbreak e saídas maliciosas, tornando-se uma excelente opção para equipes de engenharia que implementam IA voltada para o cliente.

8. Segurança Seráfica

A Seraphic Security transforma qualquer navegador padrão em um navegador empresarial seguro por meio de um agente leve, oferecendo proteção contra explorações e perda de dados. Seu mecanismo de "Prevenção de Exploração" utiliza princípios de engenharia do caos para tornar o ambiente do navegador imprevisível para os atacantes, impedindo explorações de dia zero que possam visar vulnerabilidades no mecanismo subjacente do navegador ou nas interfaces GenAI.

Para a segurança do ChatGPT, a Seraphic aplica políticas detalhadas que controlam quais dados podem ser compartilhados. Ela pode desativar recursos específicos do navegador, como captura de tela ou ferramentas de desenvolvedor, enquanto o usuário estiver no domínio da OpenAI, reduzindo o risco de roubo de dados. Essa abordagem oferece controles de segurança robustos sem a necessidade de infraestrutura complexa como a de uma infraestrutura de VDI ou a substituição completa do navegador.

Como escolher a melhor ferramenta de segurança para ChatGPT

- Avalie se você precisa de uma extensão independente de navegador, como o LayerX, ou se está disposto a substituir todo o seu navegador por uma solução como o Island.

- Priorize ferramentas que ofereçam "bloqueio de colagem" em tempo real e redação de dados para impedir vazamentos antes que eles saiam do endpoint.

- Procure por recursos de descoberta de "IA Sombra" que possam identificar aplicativos GenAI não autorizados em execução fora do seu ambiente SSO.

- Certifique-se de que a solução consiga inspecionar o tráfego criptografado e compreender o contexto da conversa, e não apenas filtrar URLs de forma simples.

- Selecione um fornecedor que ofereça registros de auditoria detalhados, tanto de solicitações quanto de respostas, para atender aos requisitos de conformidade emergentes de 2026.

Perguntas

1. O ChatGPT será seguro para uso corporativo em 2026?

O ChatGPT Enterprise oferece criptografia robusta e conformidade com o SOC 2, mas o principal risco continua sendo o comportamento do usuário e a configuração da conta. Embora a OpenAI proteja a infraestrutura, ela não pode impedir que um funcionário cole voluntariamente um banco de dados de clientes em um prompt. O uso seguro exige uma camada adicional de governança no navegador para controlar quais dados entram no modelo.

2. Como posso impedir que os funcionários colem dados confidenciais no ChatGPT?

O método mais eficaz é usar uma plataforma ou extensão de segurança do navegador que inspecione os campos de entrada de texto em tempo real. Ferramentas como LayerX e Nightfall AI podem detectar quando um usuário tenta colar informações pessoais ou o endereço IP na janela do ChatGPT e bloquear a ação imediatamente, exibindo um aviso ao usuário explicando a violação da política.

3. Qual a diferença entre um navegador empresarial seguro e uma extensão de navegador?

Um navegador empresarial seguro, como o Island, é um aplicativo independente que substitui completamente o Chrome ou o Edge, oferecendo controle total sobre o ambiente, mas exigindo uma mudança no comportamento do usuário. Uma extensão de navegador, como o LayerX, é instalada sobre os navegadores existentes, adicionando recursos de segurança e monitoramento sem forçar os usuários a mudar para uma nova interface ou perder suas configurações personalizadas.

4. As ferramentas DLP legadas conseguem proteger contra vazamentos de dados do GenAI?

As ferramentas DLP legadas geralmente têm dificuldades com a Inteligência Artificial Geral (GenAI) porque normalmente operam no nível da rede ou do arquivo, perdendo o contexto dos dados colados em um formulário da web. Elas podem bloquear um site inteiro, mas não conseguem filtrar com precisão sequências de texto específicas dentro de uma sessão de bate-papo. As ferramentas de segurança modernas, nativas do navegador, são projetadas especificamente para entender as interações no nível do DOM e fornecer a granularidade necessária.

5. Quais são os riscos da “IA Agentística”?

A Inteligência Artificial Agenética refere-se a sistemas de IA capazes de executar tarefas de forma autônoma, como navegar na web ou enviar e-mails em nome do usuário. O risco reside no fato de que, se esses agentes forem comprometidos (por exemplo, por meio de injeção de prompt), eles podem ser manipulados para realizar ações maliciosas, como exfiltrar dados ou instalar malware sem o consentimento explícito do usuário. As ferramentas de segurança agora precisam monitorar as ações desses agentes, e não apenas o texto que eles geram.