A integração da IA Generativa (GenAI) aos fluxos de trabalho corporativos representa um salto monumental em produtividade. Ferramentas como o Gemini, do Google, estão na vanguarda dessa transformação, oferecendo recursos avançados para criação de conteúdo, análise de dados e resolução de problemas complexos. No entanto, esse poder introduz novos e significativos desafios de segurança. O potencial de uma violação de dados do Gemini é uma das principais preocupações de analistas de segurança e CISOs, que agora têm a tarefa de proteger os ativos corporativos em um ecossistema digital expandido. Entender a mecânica de como tal violação pode ocorrer é o primeiro passo para construir uma defesa resiliente.

Este artigo investiga os incidentes e vulnerabilidades associados ao uso do Gemini nas empresas, com foco em causas como reutilização imediata e vulnerabilidades de vazamento de sessão. Analisaremos o impacto potencial de uma violação de IA e descreveremos as lições cruciais para organizações que buscam aproveitar os benefícios do GenAI sem sucumbir aos seus riscos. A questão central que exploramos não é apenas se um vazamento de dados do Gemini pode ocorrer, mas quais medidas proativas, incluindo DLP robusto e controles de acesso, podem ser implementadas para evitá-lo.

A anatomia de uma violação de segurança em Gemini

Uma violação de segurança no Gemini não precisa ser um evento catastrófico orquestrado por um invasor externo sofisticado. Mais frequentemente, trata-se de um vazamento silencioso e lento de informações confidenciais, originado de um comportamento legítimo, embora arriscado, do usuário. O principal vetor de ameaça é a interação entre um funcionário e a própria plataforma GenAI. Cada solicitação inserida e cada arquivo carregado é um ponto potencial de exposição de dados.

Imagine um gerente de marketing usando o Gemini para resumir anotações de uma reunião confidencial de estratégia de M&A. Ele cola a transcrição completa da reunião no prompt, solicitando à IA que destrinche os principais itens de ação. Nesse momento, detalhes confidenciais sobre finanças, pessoal e estratégia corporativa são transferidos para um ambiente de nuvem de terceiros. Sem controles adequados, esses dados podem ser usados para treinar o modelo, ser retidos em registros de conversas ou potencialmente expostos por meio de uma vulnerabilidade da plataforma.

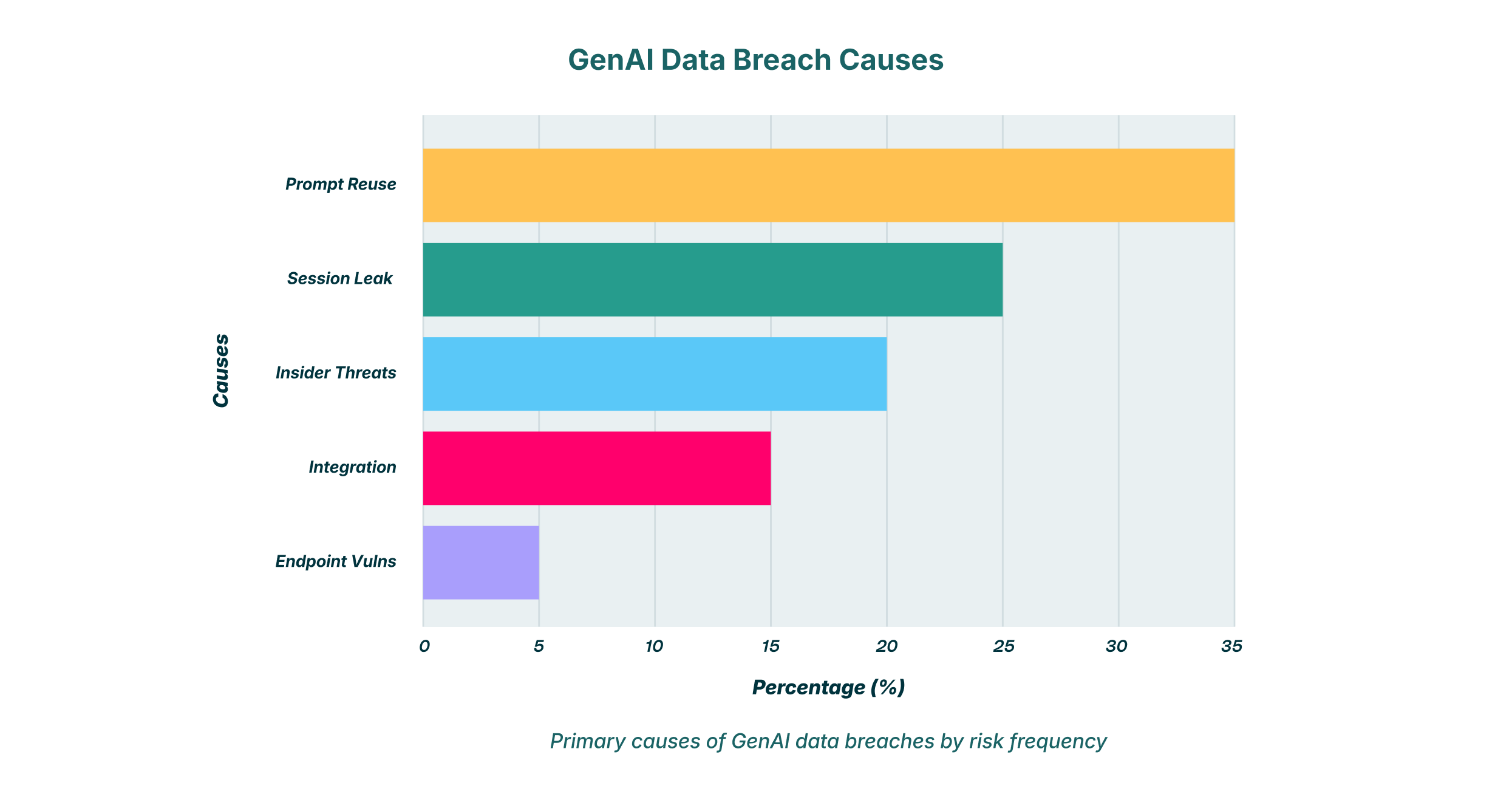

Várias vulnerabilidades importantes podem levar a um evento significativo de exposição de dados quando os funcionários usam ferramentas GenAI como o Gemini.

Reutilização rápida e treinamento de modelo

Um dos riscos mais discutidos é a reutilização imediata, em que os dados enviados pelos usuários são incorporados ao conjunto de dados de treinamento do LLM. Embora grandes provedores, como o Google, tenham políticas contra o uso de dados enviados pela API para o treinamento de seus modelos públicos, as políticas para versões públicas dessas ferramentas, voltadas para o consumidor, podem ser diferentes. Um funcionário que utiliza uma conta pessoal do Gemini em um dispositivo corporativo pode, inadvertidamente, contribuir com informações confidenciais para a base de conhecimento do modelo. Essas informações podem, teoricamente, aparecer na consulta de outro usuário, levando a um vazamento imprevisível e irreversível de dados do Gemini.

Vazamento de sessão e sequestro

Um vazamento de sessão é uma vulnerabilidade mais técnica, mas igualmente perigosa. Se a sessão de um funcionário com o Gemini for comprometida, por meio de uma extensão maliciosa do navegador, uma rede Wi-Fi insegura ou um ataque de phishing, um invasor poderá obter acesso a todo o histórico de conversas. Esse histórico pode conter um tesouro de dados confidenciais compartilhados ao longo de semanas ou meses. A facilidade com que malwares modernos podem realizar sequestros de sessão torna isso um vetor de ameaça crítico para qualquer aplicação web, incluindo plataformas GenAI.

Ameaças internas e uso não autorizado

O risco nem sempre é externo. Um funcionário insatisfeito pode exfiltrar dados intencionalmente, inserindo-os no Gemini e, em seguida, acessando-os de um dispositivo pessoal. Mais comumente, a ameaça é acidental. Um funcionário bem-intencionado, sem conhecimento dos riscos, pode usar o Gemini para tarefas que envolvam informações de identificação pessoal (PII), propriedade intelectual ou código-fonte, criando um problema de TI oculto que as ferramentas de segurança tradicionais não conseguem ver ou controlar. Esse uso não autorizado do GenAI é um dos principais impulsionadores da violação da IA moderna.

A questão crítica: a Gemini vaza dados?

Então, o Gemini vaza dados? A resposta é complexa. Por padrão, o Gemini possui controles de segurança robustos, e o Google investe pesado na proteção de sua infraestrutura. A plataforma em si não é inerentemente "vazada". No entanto, o risco de vazamento está fundamentalmente ligado ao seu uso. Sem sobreposições de segurança específicas, qualquer ferramenta poderosa pode ser mal utilizada. Os principais canais para um vazamento de dados são:

- Entrada do usuário: funcionários colando texto confidencial ou enviando documentos confidenciais.

- Riscos de integração: Conexões inseguras entre APIs Gemini e outros aplicativos corporativos.

- Vulnerabilidades de endpoint: navegadores ou dispositivos comprometidos que expõem sessões de usuários a invasores.

Portanto, a responsabilidade de evitar um vazamento de dados Gemini é compartilhada. Enquanto o provedor protege a plataforma, a empresa deve proteger como seus funcionários e sistemas interagem com ela.

Prevenção e Mitigação: Uma Abordagem Moderna à Segurança da IA

Para evitar uma violação de segurança no Gemini, é preciso ir além da segurança tradicional baseada em rede e implementar soluções que ofereçam visibilidade e controle diretamente no ponto de interação: o navegador. É aqui que uma plataforma de Detecção e Resposta de Navegador (BDR), como a Enterprise Browser Extension da LayerX, se torna essencial.

Uma etapa crítica é implantar uma solução DLP que compreenda o contexto das interações da GenAI. Ferramentas DLP legadas frequentemente enfrentam dificuldades com tráfego da web e APIs. Uma solução moderna deve ser capaz de:

- Monitoramento de prompts: análise do conteúdo dos prompts em tempo real para detectar e bloquear o envio de dados confidenciais, como PII, informações financeiras ou palavras-chave de um projeto confidencial.

- Controlando uploads de arquivos: impedindo que funcionários enviem documentos confidenciais para o Gemini.

- Aplicação de políticas: aplicação de proteções baseadas em risco que podem, por exemplo, permitir consultas gerais, mas bloquear o envio de qualquer conteúdo que corresponda a um padrão de dados predefinido.

Mitigar riscos baseados em sessão

Para combater a ameaça de vazamento de sessão, as equipes de segurança precisam de visibilidade da atividade do navegador. Uma extensão de navegador empresarial pode identificar e bloquear extensões maliciosas que tentam sequestrar sessões, alertar sobre atividades suspeitas de scripts na aba Gemini e garantir que todas as interações ocorram em um ambiente monitorado e seguro. Isso fornece uma camada crucial de defesa contra ataques baseados em endpoints direcionados às ferramentas GenAI.

Descubra e proteja a IA de sombra

Os funcionários inevitavelmente usarão uma combinação de ferramentas de IA sancionadas e não sancionadas. Uma estratégia de segurança abrangente deve incluir a descoberta desse uso de "IA oculta". Ao monitorar toda a atividade do navegador, as organizações podem identificar quais funcionários estão usando o Gemini (e outras ferramentas GenAI), se estão usando contas corporativas ou pessoais, e que tipo de risco esse uso representa. Essa visibilidade permite que as equipes de TI e segurança apliquem políticas consistentes em todos os aplicativos, sancionados ou não.

Lições aprendidas para um futuro seguro de GenAI

A ascensão de ferramentas como o Gemini não precisa ser motivo de preocupação com a segurança. Ao adotar uma estratégia de segurança moderna e focada no usuário, as organizações podem promover a inovação e, ao mesmo tempo, proteger seus ativos mais valiosos. As principais lições são claras:

- Assuma o risco gerado pelo usuário: a principal ameaça de um evento de exposição de dados advém das ações do usuário. As estratégias de segurança devem se concentrar no monitoramento e controle da interação do usuário com o aplicativo.

- Contexto é tudo: as ferramentas de segurança precisam entender a diferença entre uma consulta benigna e um envio de dados de alto risco. O DLP com reconhecimento de contexto é inegociável para proteger o GenAI.

- O navegador é o novo ponto final: à medida que os aplicativos migram para a web, o navegador se tornou o ponto central de risco e controle. Proteger o navegador é proteger a empresa.

Prevenir uma violação de IA significa permitir que os funcionários utilizem ferramentas poderosas com segurança. Isso requer uma mudança estratégica, passando do bloqueio de acesso para o gerenciamento do uso com controles inteligentes e granulares. Com a abordagem certa, as organizações podem abraçar com confiança o futuro do trabalho, impulsionadas pela GenAI e protegidas por uma defesa proativa e adaptável.