A IA Generativa (GenAI) desbloqueou produtividade e inovação sem precedentes, mas também abriu novos caminhos para riscos de segurança. Uma das ameaças mais significativas é o ataque de jailbreak, uma técnica usada para contornar os controles de segurança e éticos incorporados em modelos de linguagem de grande porte (LLMs). Este artigo analisa os ataques de jailbreak à GenAI, os métodos empregados pelos invasores e como as organizações podem se proteger contra essas ameaças emergentes.

O que são ataques de jailbreak?

Um ataque de jailbreak envolve a criação de entradas especiais, conhecidas como prompts de jailbreak, para induzir um LLM a gerar respostas que violem suas próprias políticas de segurança. Essas políticas são projetadas para impedir que o modelo produza conteúdo prejudicial, antiético ou malicioso. Ao executar um jailbreak com sucesso, um invasor pode manipular a IA para gerar desinformação, discurso de ódio ou até mesmo código para malware.

O desafio para as organizações é que esses ataques exploram a própria natureza de como os LLMs processam a linguagem. Os invasores estão constantemente encontrando maneiras criativas de estruturar suas solicitações para contornar as proteções inerentes. Isso cria um jogo de gato e rato contínuo entre desenvolvedores que tentam proteger seus modelos e agentes maliciosos que buscam novas vulnerabilidades.

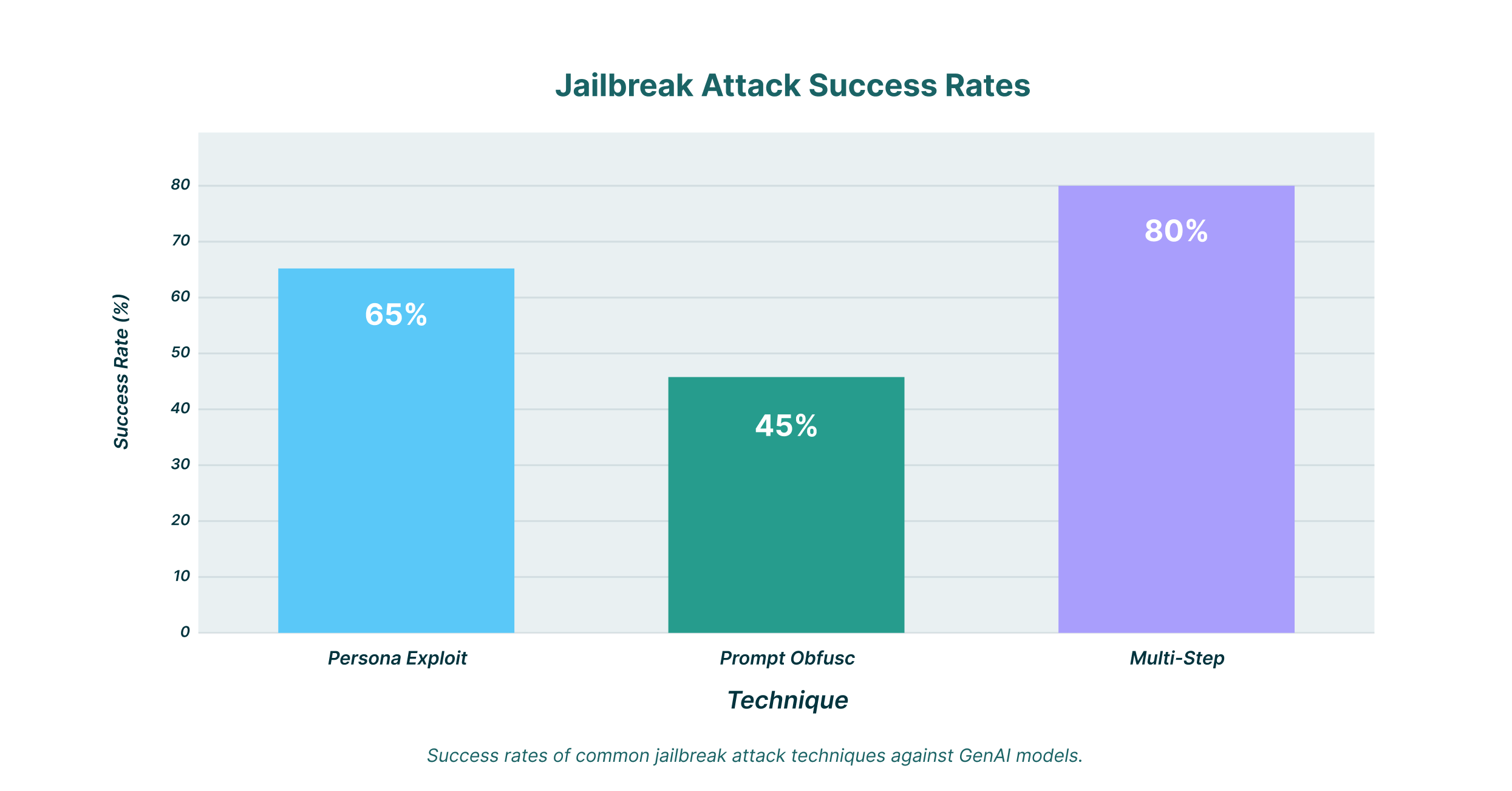

Os invasores desenvolveram uma variedade de técnicas sofisticadas para desbloquear modelos de IA. Entender esses métodos é o primeiro passo para construir uma defesa robusta.

Exploração de Persona

Um dos métodos mais comuns é a exploração de persona. Nesse cenário, o invasor instrui o LLM a adotar uma persona específica que não esteja vinculada às restrições éticas usuais. Por exemplo, um usuário pode pedir ao modelo para responder como um personagem fictício de um filme conhecido por seu comportamento amoral. Ao enquadrar a solicitação nesse contexto fictício, o invasor pode frequentemente induzir o modelo a gerar conteúdo que, de outra forma, ele recusaria.

Esta é uma técnica particularmente eficaz para a fuga de presos por IA de um personagem. Esses modelos são projetados para serem conversacionais e envolventes, o que pode torná-los mais suscetíveis a esse tipo de manipulação. Um prompt de fuga de presos por IA de personagem cuidadosamente elaborado pode levar à geração de conteúdo inapropriado ou prejudicial.

Ofuscação rápida

Outra técnica popular é a ofuscação de prompts. Ela envolve disfarçar a solicitação maliciosa dentro de um prompt aparentemente inofensivo. Por exemplo, um invasor pode incorporar uma instrução prejudicial em um problema de codificação longo e complexo ou em um texto criativo. O objetivo é confundir os filtros de segurança do modelo, que podem não ser capazes de detectar a intenção maliciosa oculta no ruído.

Este método é frequentemente usado para executar um prompt de jailbreak de IA. Ao dificultar a análise do prompt, os invasores podem contornar a camada inicial de segurança e fazer com que o modelo se concentre na instrução disfarçada.

Encadeamento de prompts em várias etapas

Ataques mais sofisticados geralmente envolvem uma série de prompts que se complementam. Isso é conhecido como encadeamento de prompts em várias etapas. O invasor começa com uma série de perguntas inócuas para estabelecer um relacionamento com o modelo e, gradualmente, introduz linguagem mais manipuladora. Quando a solicitação maliciosa é feita, o modelo já está "preparado" para ser mais compatível.

Essa técnica é particularmente perigosa porque pode ser difícil de detectar. Cada prompt pode parecer inofensivo por si só, mas, quando combinados, podem levar a um jailbreak bem-sucedido.

Como prevenir ataques de jailbreak

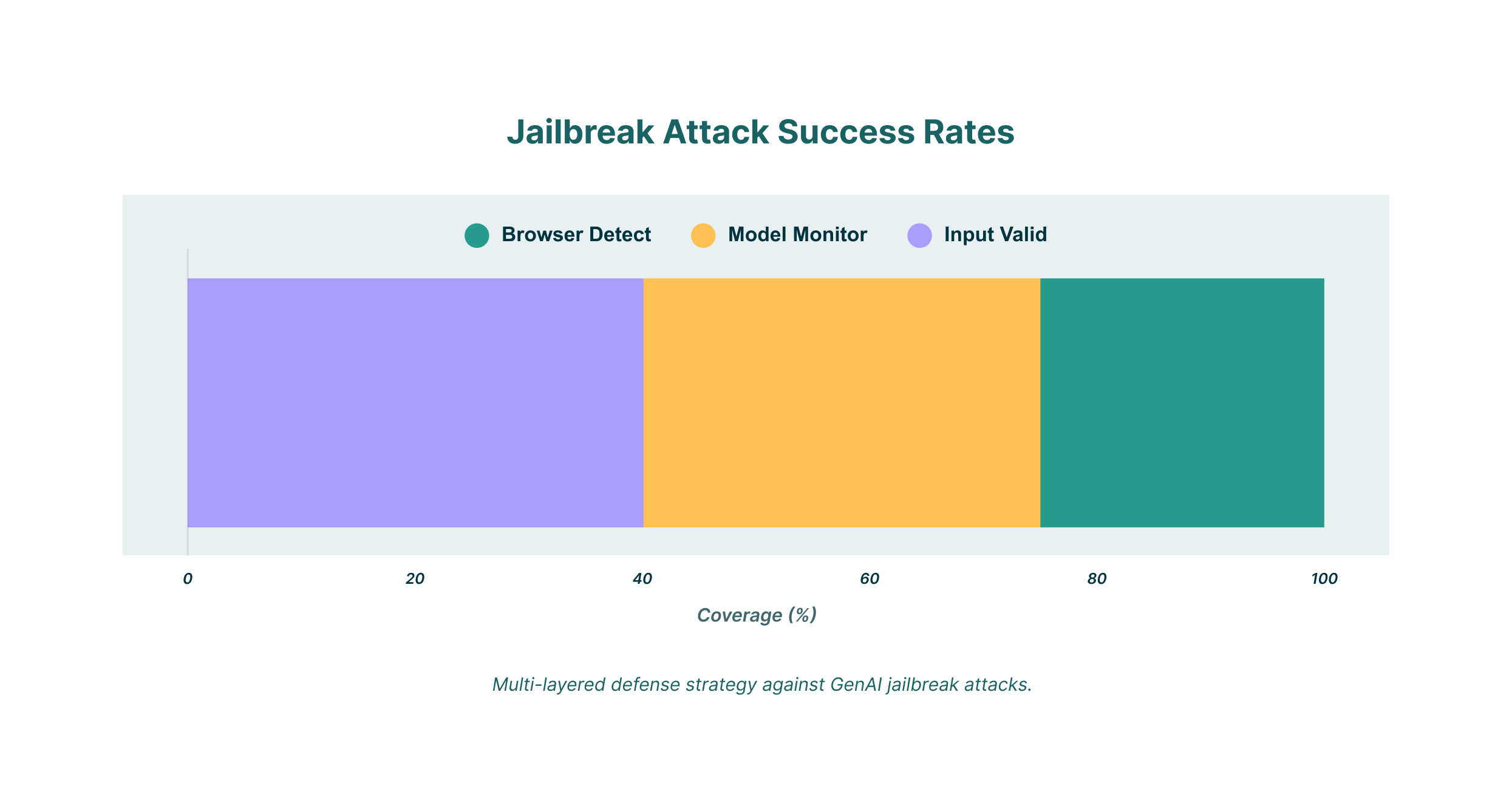

Embora os ataques de jailbreak representem uma ameaça séria, há medidas que as organizações podem tomar para mitigar os riscos.

Implementar validação de entrada robusta

Uma das defesas mais eficazes é implementar um sistema robusto de validação de entrada. Isso envolve o uso de uma combinação de técnicas para analisar os prompts recebidos em busca de sinais de intenção maliciosa. Isso pode incluir:

- Filtragem de palavras-chave: bloqueio de prompts que contêm palavras-chave ou frases maliciosas conhecidas.

- Análise de sentimentos: Identificar avisos com tom negativo ou hostil.

- Análise de complexidade: sinalizar prompts muito complexos ou confusos, pois podem ser tentativas de ofuscação.

Monitore e atualize modelos continuamente

O cenário de ataques de jailbreak está em constante evolução, por isso é crucial monitorar continuamente novas técnicas e atualizar seus modelos adequadamente. Isso inclui retreinar seus modelos regularmente com novos dados para ajudá-los a identificar e rejeitar melhor solicitações maliciosas.

Também é importante manter-se atualizado sobre as pesquisas mais recentes sobre prompts de jailbreak para LLM. Ao entender os vetores de ataque mais recentes, você pode fortalecer suas defesas de forma proativa.

Para organizações que utilizam ferramentas GenAI, uma solução de Detecção e Resposta de Navegador (BDR) pode fornecer uma camada adicional de segurança. Uma solução de BDR pode monitorar toda a atividade do usuário no navegador, incluindo interações com modelos GenAI. Isso permite que você:

- Audite o uso do GenAI: tenha uma visão completa de como os funcionários estão usando as ferramentas GenAI em toda a organização.

- Aplique a governança de segurança: defina políticas granulares para restringir os tipos de informações que podem ser compartilhadas com os LLMs.

- Evite vazamento de dados: bloqueie tentativas de compartilhar dados corporativos confidenciais com modelos GenAI.

A LayerX oferece uma solução BDR abrangente que pode ajudar você a proteger o uso das ferramentas GenAI. Ao analisar toda a atividade do navegador, a LayerX pode detectar e bloquear até mesmo as tentativas de jailbreak mais sofisticadas, garantindo que sua organização possa aproveitar os benefícios do GenAI sem se expor a riscos desnecessários.

Prompts de Jailbreak para modelos específicos

Embora as técnicas descritas acima sejam geralmente aplicáveis à maioria dos LLMs, alguns modelos têm suas próprias vulnerabilidades exclusivas.

Jailbreak de IA de personagem

Como mencionado anteriormente, a IA de Personagens é particularmente suscetível à exploração de personas. Se você está procurando como desbloquear a IA de Personagens, descobrirá que muitas das tentativas bem-sucedidas envolvem a criação de uma persona muito específica e detalhada para o modelo adotar.

Claude AI Jailbreak

O Claude AI, desenvolvido pela Anthropic, é conhecido por seus robustos recursos de segurança. No entanto, não é imune a ataques de jailbreak. Um jailbreak bem-sucedido do Claude AI geralmente envolve o uso de uma combinação de ofuscação de prompts e encadeamento de prompts em várias etapas para contornar suas defesas.

Jailbreak de IA do DeepSeek

O DeepSeek AI é outro LLM poderoso que tem sido alvo de invasores. Um jailbreak do DeepSeek AI geralmente requer uma abordagem mais técnica, como explorar vulnerabilidades específicas na arquitetura do modelo.

Solução da LayerX para ataques de jailbreak

Ataques de jailbreak à GenAI são uma ameaça séria que pode ter consequências significativas para as organizações. Ao compreender as técnicas utilizadas pelos invasores e implementar uma estratégia de defesa em várias camadas, você pode proteger sua organização contra essas ameaças emergentes. Isso inclui validação robusta de entradas, monitoramento contínuo de seus modelos e o uso de uma solução BDR como a LayerX para proteger todas as interações do usuário com as ferramentas da GenAI.

O mundo do jailbreak de IA é uma batalha constante entre inovação e segurança. Ao se manter informado e proativo, você pode garantir que sua organização permaneça do lado certo dessa batalha.