Verktyg för AI-användningskontroll tillhandahåller det kritiska styrningslager som företag behöver för att implementera generativ AI på ett säkert sätt. Dessa lösningar övervakar medarbetarinteraktioner, tillämpar policyer för realtidsdata och förhindrar läckage av känslig information till offentliga modeller som ChatGPT och Gemini.

Vad är AI-användningskontrollverktyg och varför de är viktiga

AI-användningskontroll (AIUC) är specialiserade säkerhetsplattformar som styr interaktionen mellan företagsanvändare och generativa AI-applikationer. Till skillnad från traditionell DLP eller brandväggar som fokuserar på filöverföringar och nätverksperimeter, inspekterar AIUC-lösningar konversationsinnehållet i uppmaningar och svar i realtid. De gör det möjligt för organisationer att definiera avsiktsbaserade policyer, till exempel att tillåta marknadsföringsteam att använda AI för kopieringsgenerering samtidigt som de blockerar teknikteam från att klistra in proprietär kod i samma verktyg.

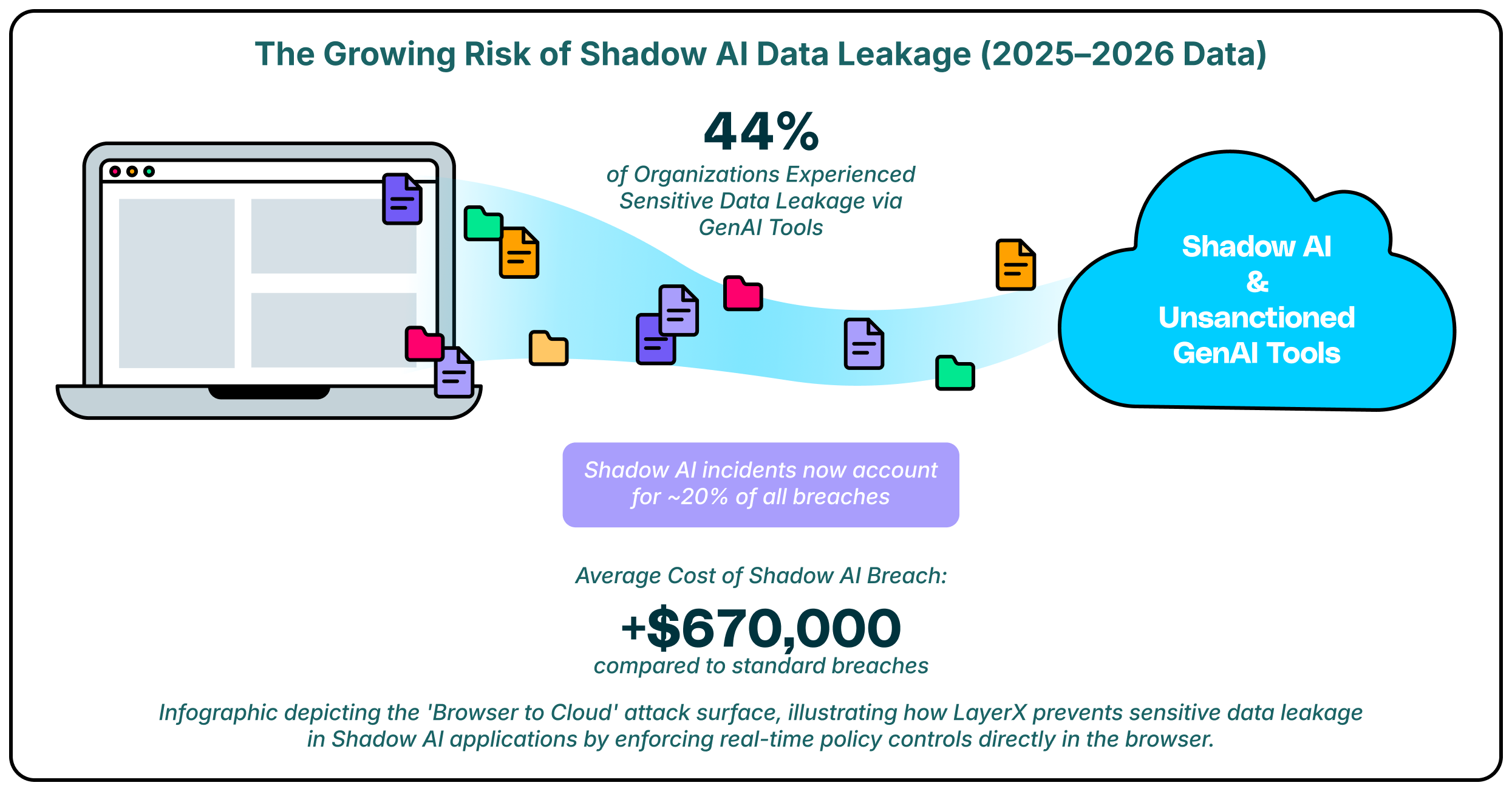

Denna kategori har blivit viktig i takt med att attackytan "från webbläsare till moln" expanderar. Anställda kringgår i allt större utsträckning företagsnätverk för att få direkt åtkomst till AI-verktyg via webbläsare, vilket skapar blinda fläckar för äldre säkerhetsstackar. Genom att upprätthålla säkerhet på webbläsar- och identitetsnivå minskar dessa verktyg risker relaterade till skugg-AI, fiendtliga uppmaningar och obehörig datadelning utan att kräva ett generellt förbud som hämmar innovation.

Viktiga trender inom AI-användningskontroll att hålla koll på under 2026

Ett stort skifte under 2026 är övergången mot identitetscentrerad styrning. Säkerhetsledare inser att blockering av AI-URL:er är ineffektivt och att kontext är viktigare än enkel åtkomstkontroll. De ledande strategierna fokuserar nu på att förstå "vem" som interagerar med "vilka" data, vilket gör det möjligt för organisationer att tillämpa detaljerade policyer som anpassar sig baserat på användarens roll. Detta säkerställer att en ekonomichef och en mjukvaruutvecklare möter olika, lämpliga skyddsräcken när de använder samma AI-verktyg.

En annan dominerande trend är konsolideringen av kontroller inom företagets webbläsare. Eftersom majoriteten av AI-interaktionen sker via webbgränssnitt har webbläsaren blivit den mest effektiva punkten för "sista milen"-tillämpning. Verktyg som kan inspektera Document Object Model (DOM) i realtid ersätter nätverksbaserade proxyservrar, eftersom de erbjuder djupare insikt i det faktiska innehållet som klistras in eller genereras. Detta möjliggör upptäckt av dynamiska risker som snabba injektionsattacker som nätverksinspektörer ofta missar på grund av kryptering eller obfuskation.

Dessa plattformar erbjuder olika metoder för att säkra AI-implementering, från webbläsarbaserade tillägg till API-drivna styrningslager.

| Lösning | Nyckelfunktioner | Bäst för |

| LayerX | Webbläsarbaserad tillämpning, skugg-AI-upptäckt | DLP i sista minuten och säker åtkomst |

| Island | Ersättning av webbläsare för företag, självskydd | Kontrollerade, hanterade miljöer |

| Palo Alto Networks | SASE-integration, Precision AI | Befintliga kunder i Palo Alto |

| Harmonisk säkerhet | "Zero Touch"-dataskydd, Shadow AI | Innovationsfokuserade team |

| Snabb säkerhet | Snabbt injektionsförsvar, synlighet för skugg-AI | Säkra AI-in-/utdata |

| AIM-säkerhet | GenAI-inventering, AI-SPM | IT-chefer behöver bred synlighet |

| Lassosäkerhet | Kontextbaserad åtkomstkontroll, RAG-säkerhet | LLM- och RAG-ramverk |

| Nightfall AI | AI-driven DLP, realtidsremediering | Datamaskering och sanering |

| Bevittna AI | Analys av regulatorisk risk, insiderhot | Regelefterlevnadstunga sektorer |

| Menlo Security | Säker molnwebbläsare, kopiera-klistra-kontroll | Användare av fjärrbrowserisolering (RBI) |

| Serafisk säkerhet | Exploitskydd, DLP i webbläsaren | Stoppa webbläsarattacker |

1. LayerX

LayerX levererar en webbläsarcentrerad metod för AI-användningskontroll, med djupgående insyn och verkställighetsfunktioner direkt där användare interagerar med AI-verktyg. Det fungerar som ett webbläsartillägg för företag som övervakar varje händelse i sessionen, vilket gör det möjligt att skilja mellan säkra frågor och riskfyllda åtgärder som att klistra in källkod eller ladda upp känsliga filer. Denna detaljerade kontroll gör det möjligt för organisationer att sanktionera produktivitetshöjande verktyg samtidigt som dataexfiltrering strikt förbjuds.

Utöver enkel blockering erbjuder LayerX omfattande upptäckt av användningen av skugg-AI inom hela arbetsstyrkan. Den identifierar varje AI-applikation som används, oavsett om det är ett företagsgodkänt verktyg eller ett personligt konto, och tillämpar konsekventa säkerhetspolicyer för alla. Denna funktion säkerställer att dataskydd följer med användaren, vilket effektivt minskar gapet mellan strikta interna efterlevnadsstandarder och den smidiga karaktären hos webbaserad AI-användning.

2. Ö

Island omtolkar själva webbläsaren som den primära säkerhetskontrollpunkten och erbjuder en dedikerad "Enterprise Browser" som ersätter vanliga konsumentwebbläsare som Chrome eller Edge. Denna kontrollerade miljö gör det möjligt för IT-team att bädda in säkerhetspolicyer direkt i webbläsarupplevelsen, inklusive begränsningar för att kopiera och klistra in data i AI-chattrobotar. Den tillhandahåller en mycket säker behållare för känsligt arbete, vilket säkerställer att ingen data kan lämna den hanterade miljön utan auktorisering.

Specifikt för AI-användning erbjuder Island inbyggda funktioner för att förhindra dataförlust som kan redigera känslig information innan den når en extern modell. Webbläsarens arkitektur ger fullständig insyn i användaråtgärder, vilket möjliggör revisionsloggar som visar exakt vad som delades med AI-plattformar. Denna kontrollnivå är idealisk för organisationer som kan kräva en specifik webbläsare för allt företagsarbete.

3. Palo Alto Networks (Prisma Access-webbläsare)

Prisma Access Browser från Palo Alto Networks integrerar säker surfning direkt i sin bredare SASE-arkitektur. Den använder "Precision AI" för att upptäcka och blockera hot i realtid, och utnyttjar företagets massiva datauppsättning av hotinformation. För AI-användning erbjuder den policykontroller som kan identifiera och blockera känsliga dataöverföringar till GenAI-applikationer, vilket säkerställer att användarna följer företagets datastandarder.

Denna lösning är utformad för att fungera sömlöst med befintlig säkerhetsinfrastruktur i Palo Alto, vilket ger en enhetlig bild av hot över nätverket och webbläsaren. Den förenklar policyhanteringen för team som redan använder Prisma Access, vilket gör det möjligt för dem att utöka sina befintliga dataskyddsregler för att täcka de nya risker som introduceras av webbaserade AI-verktyg. Webbläsaren fungerar som en edge enforcement-punkt som håller jämna steg med de snabba förändringarna i AI-landskapet.

4. Harmonisk säkerhet

Harmonic Security betonar en "Zero Touch"-strategi för dataskydd, med syftet att säkra AI-implementering utan tung konfiguration. Plattformen fokuserar på att klassificera AI-appar baserat på risk och värde, vilket hjälper organisationer att skilja mellan ofarliga produktivitetsverktyg och farliga dataläckor. Målet är att möjliggöra ett säkert införande av AI snarare än att bara blockera det.

Verktyget ger djupgående insyn i dataflödet till AI-leverantörer, vilket gör det möjligt för team att identifiera trender inom implementering av "högt värde". Harmonic använder färdiga riskmodeller för att automatisera godkännandeprocessen för nya verktyg, vilket minskar bördan för säkerhetsanalytiker. Denna strategi tilltalar företag som vill uppmuntra innovation samtidigt som de upprätthåller ett säkerhetsnät för kritisk data.

5. Snabb säkerhet

Prompt Security fokuserar starkt på att säkra in- och utdata från generativa AI-system för att förhindra dataläckage och manipulation. Deras plattform inspekterar prompts i realtid för att upptäcka försök till jailbreaking eller promptinjektion, vilket säkerställer att AI-modeller fungerar som avsett. Det ger ett kritiskt försvarslager för anställda som använder verktyg som ChatGPT, och rengör känslig PII från frågor innan de skickas till molnet.

Lösningen erbjuder också insyn i Shadow AI genom att övervaka anställdas interaktioner med externa verktyg. Den ger organisationer möjlighet att tillämpa "sanerad" användning, där anställda kan dra nytta av AI-hjälp utan att exponera företagets immateriella rättigheter. Att säkra dataflödet på promptnivå hjälper organisationer att upprätthålla integriteten utan att behöva bygga komplex anpassad infrastruktur.

6. AIM-säkerhet

AIM Security tillhandahåller en specialiserad plattform utformad för att hjälpa ITSO:er att skapa en omfattande inventering av all GenAI-användning inom företaget. Den fokuserar på "AI Security Posture Management" (AI-SPM) och erbjuder en tydlig bild av vilka verktyg som används och de potentiella risker som är förknippade med dem. Denna insyn är avgörande för organisationer som kämpar med att kvantifiera omfattningen av sitt Shadow AI-problem.

Plattformen använder en "AI-brandvägg"-metod för att styra interaktioner med både publika och privata modeller. Den kan upptäcka och blockera snabba injektionsattacker och förhindra att känslig data skickas till obehöriga modeller. AIMs fokus på de specifika sårbarheterna hos LLM:er gör den till ett starkt val för säkerhetsteam som behöver djupa, specialiserade insikter i sin generativa AI-stack.

7. Lassosäkerhet

Lasso Security introducerar kontextbaserad åtkomstkontroll (CBAC) i AI-styrningslandskapet, specifikt inriktat på behoven hos LLM- och RAG-distributioner (Retrieval-Augmented Generation). Denna metod utvärderar dynamiskt åtkomstförfrågningar baserat på användaridentitet, beteende och datatyp, vilket säkerställer att interaktioner är säkra och kompatibla. Den är särskilt effektiv för organisationer som bygger sina egna interna AI-applikationer som kräver strikta datagränser.

Lösningen integreras med olika GenAI-miljöer för att övervaka dataöverföringar och upptäcka avvikelser i realtid. Lasso skyddar mot nya hot som modellmanipulation och dataförgiftning, vilka blir mer relevanta i takt med att företag finjusterar sina egna modeller. Dess betoning på kontext möjliggör mer flexibel och korrekt policytillämpning än enkel nyckelordsblockering.

8. Nattfalls-AI

Nightfall AI utnyttjar sin etablerade styrka inom dataförlustprevention (DLP) för att hantera AI-användningskontroll. Dess plattform använder maskininlärningsdetektorer tränade på 125 miljoner parametrar för att identifiera PII, PCI och hemligheter med hög noggrannhet. För AI-användning tillhandahåller Nightfall realtidsåtgärder genom att automatiskt maskera känslig data i prompter (som ChatGPT) innan den lämnar webbläsaren eller API:et.

Denna metod med "redigering först" gör det möjligt för anställda att fortsätta använda AI-verktyg utan avbrott, eftersom endast känslig information tas bort medan resten av prompten förblir funktionell. Nightfalls fokus på "kontextuell" detektering hjälper till att minska falska positiva resultat, vilket är en vanlig smärtpunkt i traditionella DLP-system som tillämpas på konversations-AI.

9. Bevittna AI

Witness AI riktar sig mot efterlevnads- och regelverksaspekterna av AI-användning, vilket gör den lämplig för hårt reglerade branscher som finans och hälso- och sjukvård. Plattformen tillhandahåller analyser av beteenderisker och regelexponering, vilket hjälper organisationer att kartlägga sin AI-användning mot interna policyer. Den är utformad för att upptäcka insiderhot genom att analysera konversationsmönster över tid.

Lösningen skapar en specialiserad revisionslogg för AI-interaktioner, vilket är avgörande för att bevisa efterlevnad under revisioner. Genom att fokusera på "säker användning" hjälper Witness AI organisationer att navigera i det komplexa skärningspunkten mellan snabb teknologisk implementering och strikta interna krav. Den ger den nödvändiga tillsynen för att säkerställa att AI-strategier inte bryter mot regler för datastyrning.

10. Menlo Säkerhet

Menlo Security använder sin RBI-teknik (Remote Browser Isolation) för att skapa en säker buffert mellan användare och GenAI-applikationer. Deras lösning ”Menlo for GenAI” erbjuder detaljerade kopiera-klistra-kontroller, vilket säkerställer att användare inte kan mata in känslig kod eller PII i chatbot-gränssnitt. Denna metod behandlar i huvudsak AI-applikationen som en opålitlig destination och isolerar interaktionen för att förhindra dataförlust.

Utöver isolering tillhandahåller Menlo även surfforensik för att logga exakt vilken data som delas med AI-plattformar. Denna insyn hjälper säkerhetsteam att granska användningsmönster och upprätthålla efterlevnad utan att behöva distribuera agenter på varje slutpunkt. Det är en stark lösning för organisationer som redan förlitar sig på isolering för webbsäkerhet.

11. Serafisk säkerhet

Seraphic Security tillhandahåller en säkerhetsplattform för företagswebbläsare som fungerar i alla standardwebbläsare, med fokus på att förebygga exploateringar och skydd vid körning. Dess "In-Browser DLP"-funktioner övervakar användarinteraktioner med AI-verktyg och blockerar delning av känslig data i realtid. Seraphics teknik injicerar ett säkerhetslager i webbläsarsessionen för att kontrollera JavaScript-körning, vilket hjälper till att förhindra avancerade attacker riktade mot själva webbläsaren.

Lösningen erbjuder djupgående insyn i hur anställda använder AI, loggar uppmaningar och svar för att säkerställa efterlevnad av datastyrningspolicyer. Genom att stoppa attacker på webbläsarmotornivå skyddar Seraphic mot sofistikerade hot som kan försöka kringgå traditionella detekteringsmetoder. Den är utformad för att vara lättviktig och kompatibel med befintliga företagsarbetsflöden.

Hur man väljer den bästa leverantören av AI-användningskontroll

- Bedöm om lösningen erbjuder insyn på webbläsarnivå för att upptäcka användning av skugg-AI som nätverksproxyservrar kan missa på grund av kryptering.

- Leta efter identitetsmedvetna policyer som låter dig variera åtkomstregler baserat på användarens roll och den specifika datakontexten.

- Utvärdera distributionsmodellen för att säkerställa att den passar din infrastruktur, oavsett om det är ett lätt webbläsartillägg eller en fullständig webbläsarersättning.

- Verifiera att verktyget kan upptäcka och blockera fiendtliga hot som snabb injektion och jailbreaking i realtid.

- Kontrollera integrationsmöjligheter med era befintliga SIEM- och IdP-system för att säkerställa ett enhetligt säkerhetsarbetsflöde.

Vanliga frågor

Vad är skillnaden mellan AI-användningskontroll och traditionell DLP?

Traditionell DLP är ofta utformad för filbaserat skydd och saknar kontext för att förstå konversationsbaserade AI-uppmaningar. AI-användningskontrollverktyg är specifikt byggda för att analysera avsikten och innehållet i interaktioner med LLM:er, vilket gör att de kan blockera specifika riskfyllda åtgärder, som att klistra in kod, utan att blockera hela applikationen.

Kan dessa verktyg upptäcka "Shadow AI"-appar?

Ja, de flesta plattformar för AI-användningskontroll inkluderar identifieringsfunktioner som loggar alla AI-applikationer som anställda har åtkomst till. De tillhandahåller dashboards som visar vilka verktyg som används, hur ofta och av vem, vilket gör det möjligt för säkerhetsteam att identifiera obehöriga appar som kan utgöra en risk.

Behöver jag en speciell webbläsare för att använda dessa verktyg?

Inte nödvändigtvis. Medan vissa lösningar som Island och Palo Alto Networks kräver en dedikerad företagswebbläsare, fungerar andra som LayerX och Reco som tillägg eller API-integrationer som fungerar med dina befintliga standardwebbläsare (Chrome, Edge) och SaaS-miljöer.

Hur hanterar dessa verktyg krypterad trafik?

Webbläsarbaserade lösningar som LayerX och Island kan inspektera data i webbläsaren innan den krypteras och skickas över nätverket. Detta gör att de kan se hela innehållet i uppmaningar och svar, vilket ger en insyn som nätverksbaserade verktyg ofta saknar.

Är dessa lösningar nödvändiga om vi har en policy om att inte ha AI?

Ja, eftersom en policy om att inte använda AI är svår att upprätthålla utan tekniska kontroller. Anställda använder ofta personliga enheter eller hittar lösningar för att få tillgång till användbara AI-verktyg. AI-användningskontroll ger insyn för att verifiera efterlevnad och de tekniska medlen för att upprätthålla policyn effektivt.