Implementeringen av generativ AI omformar företaget. Dessa kraftfulla modeller erbjuder oöverträffade produktivitetsökningar, men den här nya funktionen kommer med en betydande nackdel: en ny och komplex attackyta. Organisationer upptäcker att om de anställda tillåts använda GenAI-verktyg utan ordentlig tillsyn utsätts de för kritiska risker, inklusive exfiltrering av känslig personlig information, läckage av immateriella rättigheter och regelöverträdelser. Att genomföra en grundlig AI-riskbedömning är det grundläggande steget för alla organisationer som vill utnyttja kraften i AI på ett säkert sätt.

Många säkerhetschefer befinner sig i en svår situation. Hur kvantifierar man riskerna med att en anställd klistrar in proprietär kod i en offentlig LLM? Vilken är den verkliga effekten av att ett team förlitar sig på ett "skugg-AI"-verktyg som inte har granskats? Den här artikeln ger en strukturerad metod för att besvara dessa frågor. Vi kommer att utforska ett praktiskt ramverk för AI-riskbedömning, erbjuda en handlingsbar mall, undersöka de typer av verktyg som behövs för tillämpning och beskriva bästa praxis för att skapa ett hållbart AI-styrningsprogram. En proaktiv generativ AI-riskbedömning är inte längre valfri; den är avgörande för säker innovation.

Varför en specialiserad AI-säkerhetsriskbedömning inte är förhandlingsbar

Traditionella ramverk för riskhantering utformades inte för de unika utmaningar som generativ AI innebär. Den interaktiva, svarta lådformen hos stora språkmodeller (LLM) introducerar dynamiska hotvektorer som äldre säkerhetslösningar har svårt att hantera. En specialiserad AI-säkerhetsriskbedömning är avgörande eftersom riskerna är fundamentalt annorlunda och mer flytande än de som är förknippade med konventionell programvara.

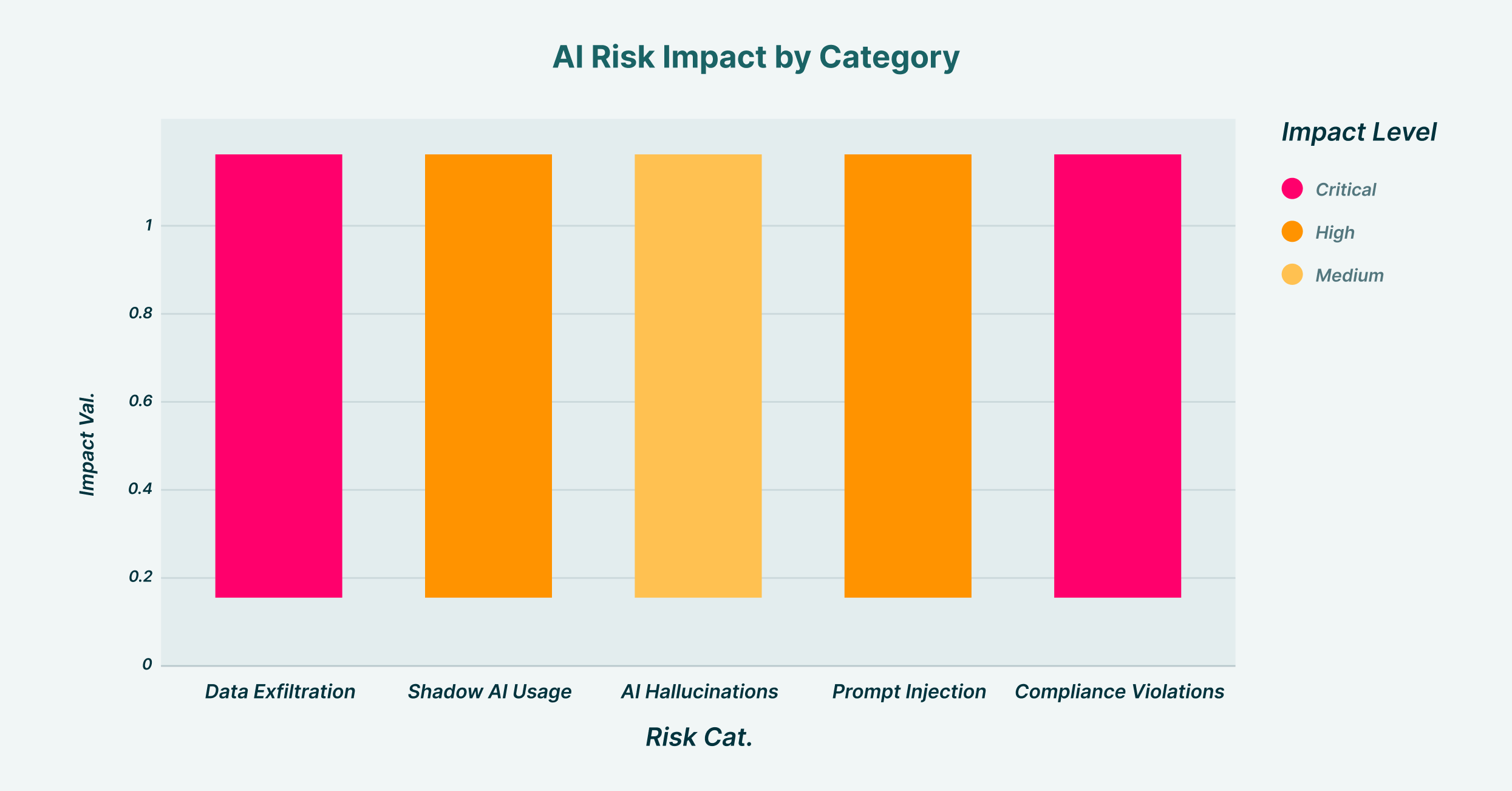

AI-riskkategorier efter konsekvensbedömning

De centrala utmaningar som kräver en särskild bedömning inkluderar:

- Datasekretess och exfiltrering: Detta är utan tvekan den mest omedelbara och betydande risken. Utan ordentliga kontroller kan anställda enkelt kopiera och klistra in känslig företagsdata i offentliga GenAI-plattformar. Detta kan inkludera kundlistor, finansiella prognoser, outgiven källkod eller M&A-strategidokument. När dessa data har skickats till en offentlig LLM förlorar organisationen kontrollen över dem, och de kan användas för att träna framtida versioner av modellen.

- Skugg-AI och otillåten användning: Tillgängligheten av webbläsarbaserade AI-verktyg innebär att alla anställda kan börja använda en ny applikation utan IT:s vetskap eller godkännande. Detta "Shadow SaaS"-fenomen skapar massiva säkerhetsblinda fläckar. En effektiv AI-strategi för riskbedömning måste börja med att upptäcka och kartlägga all AI-användning i hela organisationen, inte bara de officiellt godkända verktygen.

- Felaktiga utdata och "hallucinationer": GenAI-modeller kan producera säker men helt felaktig information. Om en anställd använder AI-genererad kod som innehåller en subtil brist eller baserar ett strategiskt beslut på en fabricerad datapunkt kan konsekvenserna bli allvarliga. Denna riskvektor påverkar den operativa integriteten och affärskontinuiteten.

- Snabbinjicering och skadlig användning: Hotaktörer utforskar aktivt sätt att manipulera GenAI. Genom noggrant utformade uppmaningar kan en angripare lura ett AI-verktyg att generera sofistikerade nätfiskemejl, skadlig kod eller desinformation. Tänk dig ett scenario där ett komprometterat medarbetarkonto används för att interagera med en intern AI-assistent och instruerar den att strö data genom att dölja den som en rutinrapport.

- Compliance- och immateriella rättigheter (IP-risker): Att navigera i det juridiska landskapet för AI är komplext. Att använda ett GenAI-verktyg som är tränat på upphovsrättsskyddat material kan exponera organisationen för intrångsanspråk i IP-rättigheter. Dessutom kan det leda till allvarliga påföljder enligt regler som GDPR och CCPA att mata in kunddata i en LLM utan korrekt samtycke eller säkerhetsåtgärder.

Bygga ditt ramverk för AI-riskbedömning

En slumpmässig strategi för AI-säkerhet är dömd att misslyckas. Ett ramverk för AI-riskbedömning ger en systematisk, repeterbar process för att identifiera, analysera och mildra GenAI-relaterade hot. Denna strukturerade strategi säkerställer att alla potentiella risker beaktas och att kontroller tillämpas konsekvent i hela organisationen.

Ett omfattande ramverk bör byggas kring fem kärnsteg:

- Inventering och identifiering: Den första säkerhetsprincipen är synlighet. Du kan inte skydda det du inte kan se. Det första steget är att skapa en komplett inventering av alla GenAI-applikationer och plattformar som används av anställda. Detta inkluderar både företagsgodkända verktyg och de skugg-AI-tjänster som nås direkt via webbläsaren. Detta steg är avgörande för att förstå den verkliga omfattningen av din organisations AI-avtryck.

- Riskidentifiering och analys: När du har din inventering är nästa steg att analysera varje applikation för att identifiera potentiella hot. För varje verktyg, överväg vilka typer av data det kan komma åt och hur det kan missbrukas. Till exempel har en AI-driven kodassistent en annan riskprofil än en AI-bildgenerator. Denna analys bör vara kontextuell och koppla verktyget till specifika affärsprocesser och datakänsligheter.

- Konsekvensbedömning: Efter att ha identifierat risker måste du kvantifiera deras potentiella påverkan på verksamheten. Detta innebär att utvärdera det värsta tänkbara scenariot för varje risk över flera vektorer: ekonomisk (t.ex. myndighetsavgifter, kostnader för incidenter), anseendemässig (t.ex. förlust av kundförtroende), operativ (t.ex. störningar i verksamheten) och juridisk (t.ex. rättstvister, intrång i immateriella rättigheter). Att tilldela en konsekvenspoäng (t.ex. Hög, Medel, Låg) hjälper till att prioritera vilka risker som ska åtgärdas först.

- Kontrolldesign och implementering: Det är här riskbedömning omsätts i handling. Baserat på riskanalysen och konsekvensbedömningen kommer du att utforma och implementera specifika säkerhetskontroller. Dessa är inte bara policyer på hyllan; de är tekniska skyddsräcken som upprätthålls av tekniken. För GenAI kan kontroller inkludera:

- Blockera åtkomst till högrisk-, okontrollerade AI-webbplatser.

- Förhindra inklistring av känsliga datamönster (som API-nycklar, PII eller interna projektkodnamn) i någon GenAI-prompt.

- Begränsa filuppladdningar till AI-plattformar.

- Tillämpa skrivskyddade behörigheter för att förhindra dataöverföring.

- Visar varningsmeddelanden i realtid för att utbilda användare om riskfyllda handlingar.

- Övervakning och kontinuerlig granskning: GenAI-ekosystemet utvecklas i en häpnadsväckande takt. Nya verktyg och nya hot dyker upp varje vecka. En AI-riskbedömning är inte ett engångsprojekt utan en kontinuerlig livscykel. Ert ramverk måste innehålla bestämmelser för kontinuerlig övervakning av AI-användning och regelbundna granskningar av era riskbedömningar och kontroller för att säkerställa att de förblir effektiva.

Din handlingsbara mall för AI-riskbedömning

För att omsätta teori till praktik är en standardiserad mall för AI-riskbedömning en ovärderlig tillgång. Den säkerställer att bedömningar utförs konsekvent över alla avdelningar och applikationer. Även om ett enkelt kalkylblad kan vara en utgångspunkt är målet att skapa ett levande dokument som informerar er säkerhetsställning.

Här är en exempelmall som ditt tvärfunktionella AI-styrningsteam kan anpassa och använda.

| AI-applikation | Affärsanvändningsfall | Datakänslighet | Identifierad(a) risk(er) | Sannolikhet | Inverkan | Riskpoäng | Reducerande kontroller | Kvarstående risk |

| Offentlig chattGPT-4 | Generellt innehållsskapande, sammanfattningar | Offentlig, Intern (Ej känslig) | Dataexfiltrering, felaktiga utdata | Hög | Medium | Hög | Blockklistring av känsliga datamönster (t.ex. PII, 'Project Phoenix'), användarutbildning | Låg |

| Otillåten PDF-analysator | Sammanfattning av externa rapporter | Okänd, potentiellt konfidentiell | Skugg-AI, Risk för skadlig kod, Dataläckage | Medium | Hög | Hög | Blockera åtkomst till applikationer helt | - |

| GitHub Copilot | Kodgenerering och hjälp | Proprietär källkod | IP-läckage, förslag på osäkra koder | Hög | Hög | Kritisk | Övervaka aktivitet, förhindra uppladdning av viktiga arkivfiler, kodskanning | Medium |

| Sanktionerad intern juristexamen | Interna kunskapsbasfrågor | Intern, konfidentiell | Snabb injektion, insiderhot | Låg | Medium | Låg | Rollbaserad åtkomstkontroll (RBAC), granskningsloggar | Låg |

Denna mall fungerar som utgångspunkt för alla generativa AI-riskbedömningar, och tvingar team att tänka igenom det specifika sammanhanget för hur varje verktyg används och vilka specifika kontroller som är nödvändiga för att minska risken till en acceptabel nivå.

Från manuella kalkylblad till ett dedikerat AI-riskbedömningsverktyg

Även om en manuell mall för AI-riskbedömning är ett bra första steg, har den begränsningar. Kalkylblad är statiska, svåra att underhålla i stor skala och saknar kapacitet för verkställighet i realtid. Allt eftersom din organisations användning av AI mognar behöver du ett dedikerat AI-riskbedömningsverktyg för att gå från en reaktiv till en proaktiv säkerhetsställning. Marknaden för AI-riskverktyg expanderar, men alla är inte skapade lika.

När du utvärderar ett AI-riskbedömningsverktyg, överväg dessa kategorier:

- SaaS Security Posture Management (SSPM): Dessa verktyg är effektiva för att upptäcka godkända SaaS-applikationer och identifiera felkonfigurationer. De saknar dock ofta insyn i webbläsarbaserad "skugg-AI"-användning och kan inte kontrollera användarinteraktioner i själva applikationen.

- Dataförlustskydd (DLP): Traditionella DLP-lösningar kan konfigureras för att blockera känsliga datamönster, men de saknar ofta den kontextuella förståelse som moderna webbapplikationer har. De kan ha svårt att skilja mellan en legitim och en riskabel interaktion i ett GenAI-chattgränssnitt, vilket leder till antingen falska positiva resultat som stör arbetsflöden eller missade hot.

- Webbläsartillägg för företag: Denna framväxande kategori representerar en mer effektiv metod. Ett säkerhetsfokuserat webbläsartillägg, som det som erbjuds av LayerX, fungerar direkt i webbläsaren. Detta ger detaljerad insyn och kontroll över användaraktivitet på vilken webbplats som helst, inklusive GenAI-plattformar. Denna lösning gör det möjligt för säkerhetsteam att övervaka alla användarinteraktioner, såsom inklistring, formulärinlämningar och uppladdningar, och tillämpa policyer i realtid. Till exempel kan en policy förhindra att en anställd klistrar in text som identifieras som "källkod" i en offentlig LLM, vilket effektivt minskar risken för IP-läckage utan att blockera verktyget helt. Detta gör webbläsartillägget till ett kraftfullt verktyg för att implementera de kontroller som definieras i din AI-säkerhetsriskbedömning.

I slutändan innebär den mest effektiva strategin ofta att använda AI för riskbedömning i en bredare bemärkelse, utnyttja intelligenta verktyg för att automatisera upptäckt och övervakning, samtidigt som man använder en lösning som LayerX för att upprätthålla detaljerade, kontextmedvetna policyer vid riskpunkten: webbläsaren.

Bästa praxis för ett hållbart AI-riskbedömningsprogram

En framgångsrik GenAI-säkerhetsstrategi går utöver ramverk och verktyg; den kräver ett kulturellt skifte och ett engagemang för kontinuerlig förbättring. Följande bästa praxis kan bidra till att säkerställa att ditt AI-riskbedömningsprogram är både effektivt och hållbart.

- Inrätta en tvärfunktionell AI-styrningskommitté: AI-risk är inte bara ett säkerhetsproblem; det är ett affärsproblem. Ert styrningsteam bör inkludera representanter från säkerhet, IT, juridik, efterlevnad och viktiga affärsenheter. Detta säkerställer att riskbeslut är balanserade med affärsmål och att policyer är praktiska att implementera.

- Utveckla en tydlig policy för acceptabel användning (AUP): Anställda behöver tydlig vägledning. Policyn bör uttryckligen ange vilka AI-verktyg som är godkända, vilka typer av data som är tillåtna att använda med dem och användarens ansvar för säker användning. Denna policy bör vara ett direkt resultat av er riskbedömningsprocess.

- Prioritera kontinuerlig användarutbildning: Era anställda är den första försvarslinjen. Utbildningen bör gå bortom årliga efterlevnadsmoduler och fokusera på verkliga scenarier. Använd "lärbara ögonblick" i realtid; till exempel en popup-varning när en användare försöker klistra in känsliga data, för att förstärka säkra beteenden.

- Använd en riskbaserad, detaljerad metod: Istället för att blockera all AI, vilket kan hämma innovation, använd din riskbedömning för att tillämpa detaljerade kontroller. Tillåt användningsfall med låg risk samtidigt som du tillämpar strikta kontroller på högriskaktiviteter. Tillåt till exempel användningen av ett offentligt GenAI-verktyg för marknadsföringstexter men blockera dess användning för att analysera finansiella data. Denna nyanserade metod är endast möjlig med ett verktyg som ger djupgående insyn i användaråtgärder.

- Integrera teknik för verkställighet i realtid: Policy och utbildning är viktiga men otillräckliga i sig själva. Teknik krävs för att verkställa reglerna. Ett webbläsartillägg för företag utgör den tekniska ryggraden för ert användarvänligt bruk (AUP), vilket översätter skriftlig policy till förebyggande åtgärder i realtid och gör er AI-riskbedömning till en aktiv försvarsmekanism snarare än ett passivt dokument.

Säkra din AI-drivna framtid med proaktiv riskhantering

Generativ AI erbjuder transformativ potential, men att realisera dess fördelar på ett säkert sätt kräver en proaktiv och strukturerad strategi för att hantera dess risker. Genom att implementera ett robust ramverk för AI-riskbedömning, använda en praktisk mall och distribuera rätt verkställighetsverktyg kan organisationer bygga en säker bro till en AI-driven framtid.

Resan börjar med insyn och går vidare till kontroll. Att förstå var och hur GenAI används är det första steget. LayerX ger den kritiska insyn och detaljerade kontroll som behövs för att förvandla din AI-riskbedömning från en checklista till ett dynamiskt försvarssystem, vilket gör att din organisation kan förnya sig tryggt och säkert.