Integreringen av generativ AI i företagsarbetsflöden är inte ett framtidsperspektiv; det sker just nu, i en takt som ofta överträffar säkerhets- och styrningskapaciteten. För varje dokumenterad, sanktionerad användning av ett AI-verktyg som ökar produktiviteten finns det otaliga fall av "skugganvändning", vilket utsätter organisationer för betydande hot. Utmaningen för säkerhetsanalytiker, IT-chefer och IT-ledare är tydlig: hur möjliggör vi den innovation som AI lovar utan att bjuda in till oacceptabla risker? Svaret ligger i en disciplinerad, proaktiv strategi för AI-riskhantering. Det handlar inte om att blockera framsteg; det handlar om att bygga skyddsräcken som gör att din organisation kan accelerera på ett säkert sätt.

Det växande behovet av AI-styrning

Innan någon effektiv riskstrategi kan implementeras måste en grund för AI-styrning etableras. Det snabba, decentraliserade införandet av AI-verktyg innebär att organisationer utan en formell styrningsstruktur arbetar i mörkret. Anställda, ivriga att förbättra sin effektivitet, kommer självständigt att använda olika AI-plattformar och plugins, ofta utan att beakta säkerhetskonsekvenserna. Detta skapar ett komplext nätverk av osanktionerad SaaS-användning, där känslig företagsdata; från PII och finansiella register till immateriella rättigheter; oavsiktligt kan föras till tredjeparts stora språkmodeller (LLM).

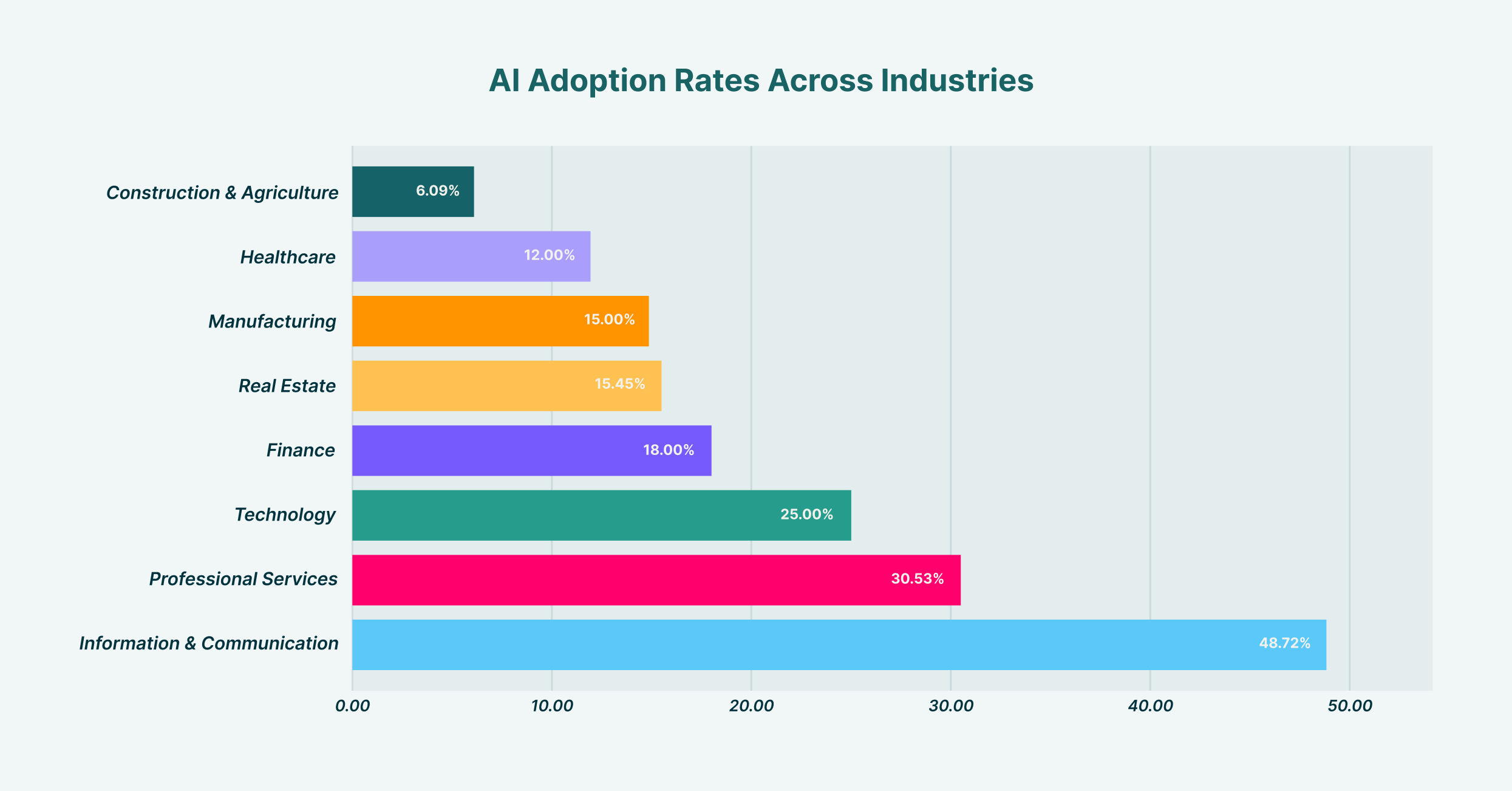

AI-användningen varierar avsevärt mellan olika branscher, där information och kommunikation leder med 48.7 % och bygg och jordbruk lägst med 6.1 %.

Att etablera en robust AI-styrning innebär att skapa ett tvärfunktionellt team, vanligtvis bestående av representanter från IT-, säkerhets-, juridik- och affärsavdelningar. Denna kommitté har till uppgift att definiera organisationens inställning till AI. Vad är vår riskaptit? Vilka användningsfall uppmuntras och vilka är förbjudna? Vem är ansvarig när en AI-relaterad incident inträffar? Att besvara dessa frågor ger den klarhet som behövs för att bygga policyer och kontroller. Utan denna top-down strategiska inriktning blir alla försök att hantera risker en serie osammanhängande, reaktiva åtgärder snarare än ett sammanhängande försvar. Detta styrningsramverk blir ritning för alla efterföljande säkerhetsinsatser och säkerställer att teknik, policy och användarbeteende är i linje.

Bygga ditt ramverk för AI-riskhantering

Med en styrningsstruktur på plats är nästa steg att konstruera ett formellt ramverk för AI-riskhantering. Detta ramverk operationaliserar era styrningsprinciper och omvandlar övergripande strategier till konkreta, repeterbara processer. Det tillhandahåller en strukturerad metod för att identifiera, bedöma, mildra och övervaka AI-relaterade risker i hela organisationen. Istället för att uppfinna hjulet på nytt kan organisationer anpassa etablerade modeller, såsom NIST AI Risk Management Framework, för att passa deras specifika operativa sammanhang och hotbild.

Utvecklingen av ett effektivt ramverk för riskhantering inom AI bör vara en metodisk process. Den börjar med att skapa en omfattande inventering av alla AI-system som används; både godkända och icke-godkända. Denna inledande upptäcktsfas är avgörande; man kan inte skydda det man inte kan se. Efter upptäckten bör ramverket beskriva procedurer för riskbedömning, tilldela poäng baserat på faktorer som vilken typ av data som behandlas, modellens kapacitet och dess integration med andra kritiska system. Reduceringsstrategier utformas sedan baserat på denna bedömning, allt från tekniska kontroller och användarutbildning till fullständigt förbud mot högriskapplikationer. Slutligen måste ramverket innehålla en kadens för kontinuerlig övervakning och granskning, eftersom både AI-ekosystemet och din organisations användning av det ständigt kommer att utvecklas. Det finns olika ramverk för riskhantering inom AI, men de mest framgångsrika är de som inte är statiska dokument utan levande, andande komponenter i organisationens säkerhetsprogram.

Kategorisering av AI-risker: Från dataexfiltrering till modellförgiftning

En kärnkomponent i AI och riskhantering är att förstå de specifika typer av hot du står inför. Riskerna är inte monolitiska; de spänner över ett spektrum från dataskyddsintrång till sofistikerade attacker mot själva AI-modellerna. Ett av de mest omedelbara och vanliga hoten är dataläckage. Tänk dig en marknadsanalytiker som klistrar in en lista med värdefulla leads, komplett med kontaktinformation, i ett offentligt GenAI-verktyg för att skriva personliga e-postmeddelanden. I det ögonblicket har känslig kunddata stjälps och är nu en del av juridikingenjörens utbildningsdata, utanför din organisations kontroll och i potentiellt brott mot dataskyddsföreskrifter som GDPR eller CCPA.

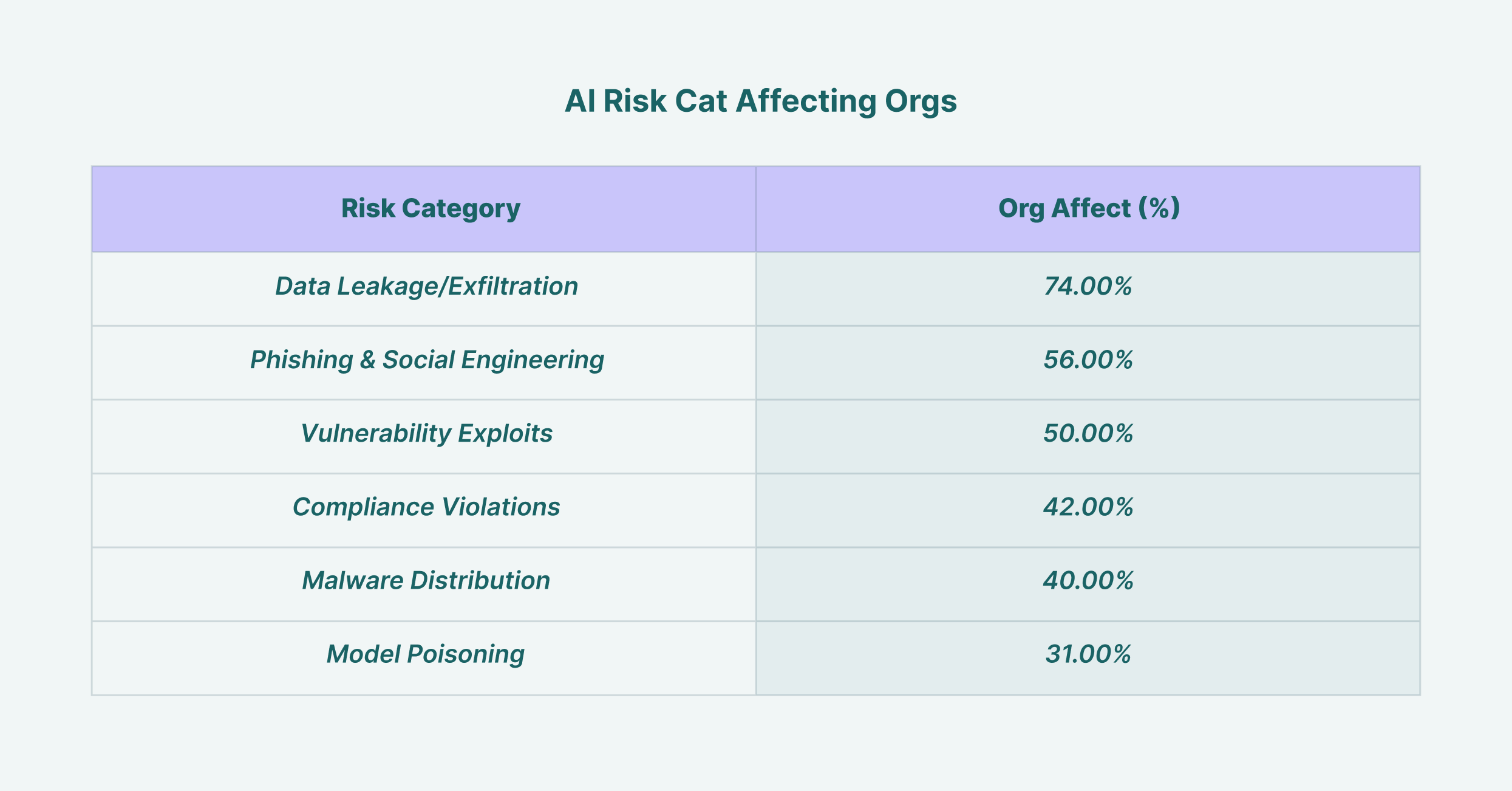

Dataläckage drabbar 74 % av organisationer, vilket gör det till den vanligaste AI-säkerhetsrisken, följt av nätfiskeattacker med 56 %.

Utöver dataläckage måste säkerhetschefer hantera mer avancerade hot. Modellförgiftning inträffar när en angripare avsiktligt matar en modell med skadlig data under dess träningsfas, vilket får den att producera partiska, felaktiga eller skadliga utdata. Undvikningsattacker innebär att skapa indata som är specifikt utformade för att kringgå ett AI-systems säkerhetsfilter. För CISO:er innebär effektiv användning av AI i riskhantering också att utnyttja AI-drivna säkerhetsverktyg för att upptäcka just dessa hot. Avancerade system för hotdetektering kan analysera användarbeteende och dataflöden för att identifiera avvikande aktiviteter som indikerar en AI-relaterad säkerhetsincident, vilket förvandlar tekniken från en riskkälla till en del av lösningen.

Den avgörande rollen för en AI-säkerhetspolicy

För att översätta ert ramverk till tydliga direktiv för era anställda är en dedikerad AI-säkerhetspolicy oförhandlingsbar. Detta dokument fungerar som den auktoritativa källan för acceptabel användning av AI inom organisationen. Den bör vara tydlig, koncis och lättillgänglig för alla anställda, och lämna inget utrymme för tvetydigheter. En väl utformad AI-säkerhetspolicy går bortom enkla "gör och gör inte" och ger sammanhang och förklarar varför Vissa restriktioner finns på plats för att främja en kultur av säkerhetsmedvetenhet snarare än enbart efterlevnad.

Policyn måste uttryckligen definiera flera nyckelområden. För det första bör den lista alla sanktionerade och godkända AI-verktyg, tillsammans med processen för att begära utvärdering av ett nytt verktyg. Detta förhindrar spridning av skugg-AI. För det andra måste den fastställa tydliga riktlinjer för datahantering som specificerar vilka typer av företagsinformation (t.ex. offentlig, intern, konfidentiell, begränsad) som kan användas med vilken kategori av AI-verktyg. Till exempel kan det vara acceptabelt att använda ett offentligt GenAI-verktyg för att sammanfatta offentligt tillgängliga nyhetsartiklar, men att använda det för att analysera konfidentiella finansiella prognoser skulle vara strängt förbjudet. Policyn bör också beskriva användaransvar, konsekvenser av bristande efterlevnad och incidenthanteringsprotokollet för misstänkta AI-relaterade intrång, vilket säkerställer att alla förstår sin roll i att skydda organisationen.

Utvärdering av modeller och plugins: Fokus på AI-riskhantering från tredje part

Det moderna AI-ekosystemet är byggt på en komplex leveranskedja av modeller, plattformar och plugins som utvecklats av tredje part. Denna verklighet gör AI-riskhantering från tredje part till en avgörande pelare i er övergripande säkerhetsstrategi. Varje gång en anställd aktiverar ett nytt plugin för sin AI-assistent eller ert utvecklingsteam integrerar ett tredjeparts-API, utökar de er organisations attackyta. Var och en av dessa externa komponenter har sin egen uppsättning potentiella sårbarheter, dataskyddspolicyer och säkerhetsställningar, som nu ärvs av er organisation.

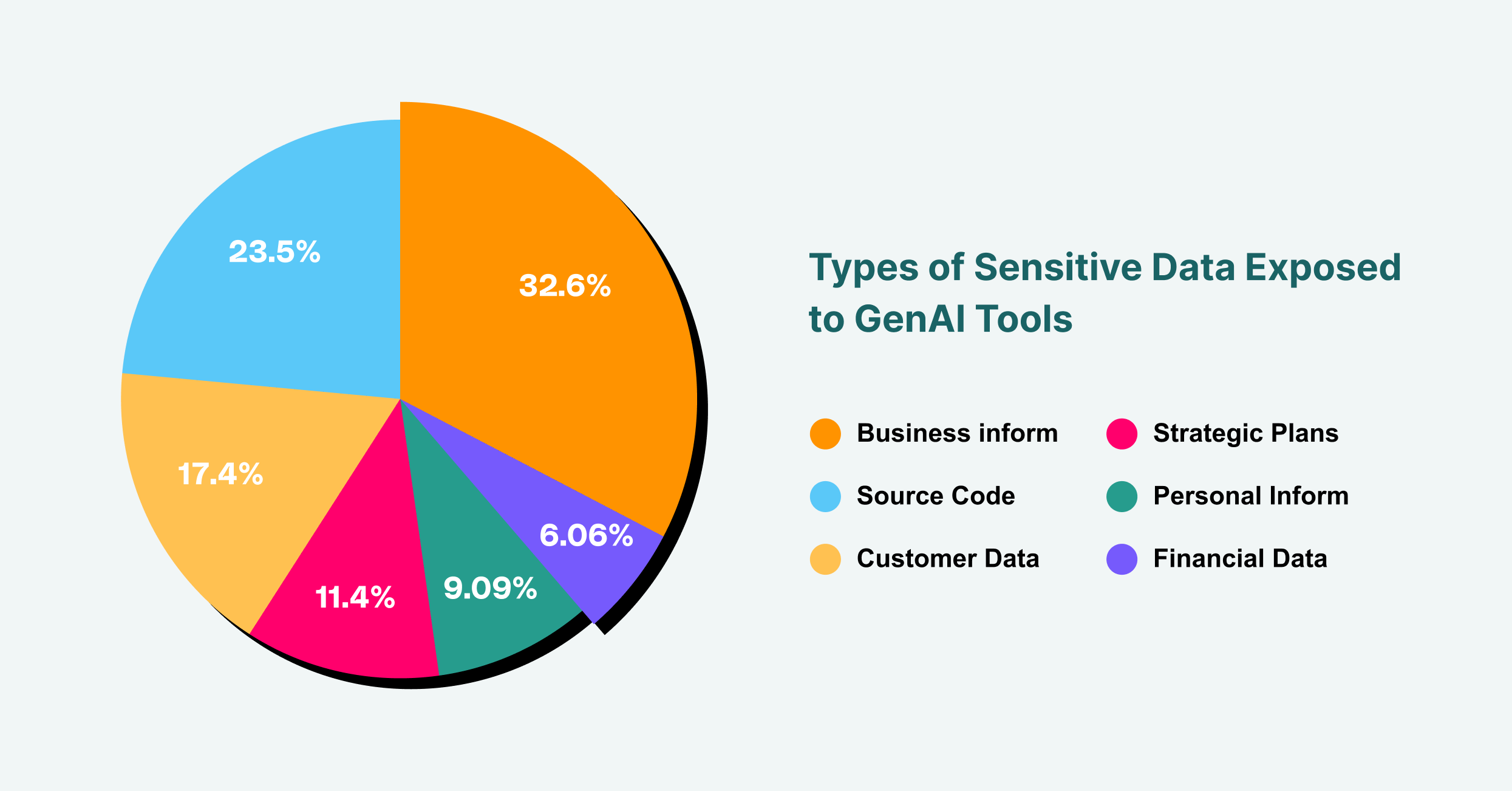

Affärsinformation står för 43 % av känsliga dataexponeringar för GenAI, följt av källkod med 31 % och kunddata med 23 %.

En rigorös utvärderingsprocess är därför avgörande. Innan ett AI-verktyg eller en AI-komponent från tredje part godkänns för användning måste det genomgå en grundlig säkerhets- och integritetsgranskning. Detta innebär att man granskar leverantörens säkerhetscertifieringar, datahanteringspraxis och incidenthanteringskapacitet. Vilka data samlar verktyget in? Var lagras de och vem har åtkomst till dem? Har leverantören en historia av säkerhetsintrång? För AI-plugins, som är en växande vektor för webbläsarbaserade attacker, bör granskningsprocessen vara ännu strängare. Frågor att ställa inkluderar: Vilka behörigheter kräver pluginet? Vem är utvecklaren? Har dess kod granskats? Genom att behandla varje AI-tjänst från tredje part med samma granskningsnivå som alla andra kritiska leverantörer kan du minska risken för att en attack i leveranskedjan äventyrar din organisation.

Implementera AI-riskhanteringsverktyg

Policy och processer är grundläggande, men de är otillräckliga utan teknisk tillämpning. Det är här AI-riskhanteringsverktyg blir avgörande. Dessa lösningar ger den insyn och kontroll som krävs för att säkerställa att din AI-säkerhetspolicy följs i praktiken, inte bara i teorin. Med tanke på att det primära gränssnittet för de flesta användare som interagerar med GenAI är webbläsaren, är verktyg som kan fungera på detta lager unikt positionerade för att ge effektiv tillsyn.

Webbläsartillägg eller plattformar för företag, som LayerX, erbjuder en kraftfull mekanism för AI-riskhantering. De kan upptäcka och kartlägga all GenAI-användning i hela organisationen, vilket ger en realtidsinventering av vilka användare som använder vilka plattformar. Denna insyn är det första steget i att stänga ner skugg-AI. Därifrån kan dessa verktyg tillämpa detaljerade, riskbaserade skyddsräcken. Du kan till exempel konfigurera en policy som förhindrar användare från att klistra in text som identifierats som "konfidentiell" i en offentlig AI-chattrobot, eller som varnar användare innan de laddar upp ett känsligt dokument. Detta skyddslager övervakar och kontrollerar dataflödet mellan användarens webbläsare och webben, och fungerar effektivt som en DLP-lösning (Data Loss Prevention) som är specifikt skräddarsydd för AI-åldern. Rätt AI-riskhanteringsverktyg överbryggar klyftan mellan policy och verklighet och tillhandahåller de tekniska medlen för att genomdriva dina styrningsbeslut.

Incidenthantering och respons i AI-åldern

Även med de bästa förebyggande åtgärderna kan incidenter fortfarande inträffa. Hur din organisation reagerar är en avgörande faktor för att minimera effekterna av ett intrång. En effektiv incidenthanteringsplan för AI måste vara både specifik och väl inövad. När en varning utlöses, oavsett om det är från en användarrapport eller en automatiserad detektering av ett av dina säkerhetsverktyg, behöver responsteamet en tydlig handbok att följa.

Det första steget är inneslutning. Om en användare oavsiktligt har läckt känslig data till en LLM är den omedelbara prioriteten att återkalla åtkomst och förhindra ytterligare exponering. Detta kan innebära att tillfälligt inaktivera användarens åtkomst till verktyget eller till och med isolera deras maskin från nätverket. Nästa fas är utredning. Vilka data läckte ut? Vem var ansvarig? Hur misslyckades våra kontroller? Denna forensiska analys är avgörande för att förstå grundorsaken och förhindra en upprepning. Slutligen måste planen ta itu med utrotning och återställning, vilket inkluderar att meddela berörda parter enligt lag, vidta åtgärder för att få data borttagna av AI-leverantören om möjligt, och uppdatera säkerhetspolicyer och kontroller baserat på de lärdomar som dragits. En mogen AI- och riskhanteringsposition innebär att vara lika förberedd på att reagera på en incident som du är på att förhindra en.

Spåra och förbättra din AI-riskposition

AI-riskhantering är inte ett engångsprojekt; det är en kontinuerlig cykel av bedömning, begränsning och förbättring. Hotlandskapet är dynamiskt, med nya AI-verktyg och attackvektorer som ständigt dyker upp. Därför är det viktigt att spåra organisationens AI-riskställning över tid för att säkerställa att era försvar förblir effektiva. Detta kräver ett engagemang för kontinuerlig övervakning och användning av mätvärden för att kvantifiera er risknivå och prestandan hos era kontroller.

Nyckeltal (KPI:er) kan inkludera antalet upptäckta icke-godkända AI-verktyg, antalet förhindrade dataläckage och andelen anställda som har genomfört AI-säkerhetsutbildning. Regelbundna revisioner och penetrationstester, särskilt inriktade på AI-system, kan också ge ovärderliga insikter i svagheter i era försvar. Genom att kontinuerligt mäta och förfina er strategi skapar ni ett motståndskraftigt säkerhetsprogram som anpassar sig till de ständigt föränderliga utmaningarna i den AI-drivna världen. Denna proaktiva hållning säkerställer att er organisation kan fortsätta att utnyttja kraften i AI:n på ett tryggt och säkert sätt, och omvandla en potentiell källa till katastrofrisk till en välhanterad strategisk fördel.