Generative KI hat die Arbeitsweise von Unternehmen grundlegend verändert. Teams aller Abteilungen setzen Tools ein, die eine Beschleunigung von Programmierung, Content-Erstellung und Datenanalyse versprechen. Diese rasante Verbreitung erfolgt oft ohne formale Kontrolle. Mitarbeiter warten nicht auf Genehmigungen. Sie registrieren sich mit ihren persönlichen Zugangsdaten und fügen sensible Unternehmensdaten in öffentliche Modelle ein. So entsteht ein riesiges, unkontrolliertes Ökosystem von „Schatten-KI“, das von herkömmlichen Firewalls weder erfasst noch kontrolliert werden kann.

Sicherheitsverantwortliche stehen vor einer schwierigen Herausforderung. KI vollständig zu blockieren ist oft unpraktisch und hemmt Innovationen. Uneingeschränkter Zugriff hingegen birgt die Gefahr von Datenlecks und Compliance-Verstößen. Die Lösung liegt in einer gut strukturierten KI-Richtlinie für Ihr Unternehmen. Dieses Dokument bildet das Fundament Ihrer Governance-Strategie. Es definiert die Spielregeln und legt klare Grenzen für die Weitergabe von Daten und die zulässigen Tools fest. Ohne dieses Rahmenwerk bleibt Ihr Unternehmen anfällig für Datenexfiltration, Bußgelder und Diebstahl geistigen Eigentums.

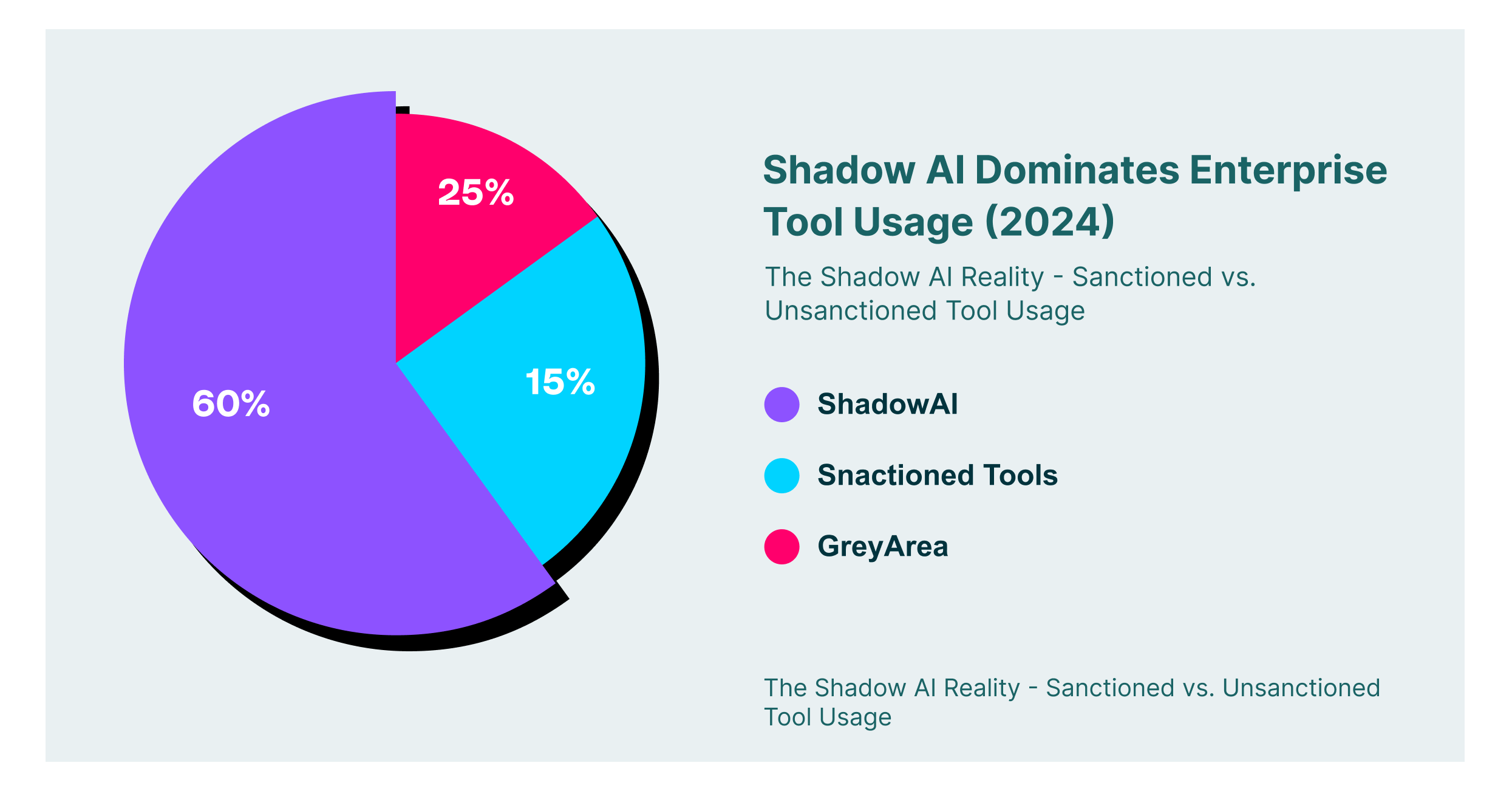

Das Ausmaß des Schatten-KI-Problems

Die Diskrepanz zwischen den von IT-Teams genehmigten Programmen und den tatsächlich von Mitarbeitern genutzten Programmen wächst. Die meisten Unternehmen glauben, ihre Softwarebestände im Griff zu haben. Die Realität sieht jedoch oft ganz anders aus. Browserbasierte Erweiterungen und Webanwendungen umgehen die Netzwerkperimeterkontrollen. Dadurch können Daten direkt vom Bildschirm des Nutzers an Server von Drittanbietern fließen.

Die Schatten-KI-Realität: Genehmigte vs. nicht genehmigte Werkzeugnutzung

Sicherheitsteams müssen erkennen, dass „Schatten-KI“ nicht nur lästig, sondern eine kritische Sicherheitslücke darstellt. Nicht autorisierte Tools verfügen oft nicht über Sicherheitsvorkehrungen auf Unternehmensniveau. Sie könnten behaupten, Ihre Daten für das Modelltraining nutzen zu dürfen. Eine umfassende KI-Sicherheitsrichtlinie ist der erste Schritt, um Transparenz und Kontrolle über diese dezentrale Umgebung zurückzugewinnen.

Kernpfeiler einer KI-Sicherheitsrichtlinienvorlage

Die Erstellung einer Richtlinie von Grund auf kann eine Herausforderung sein. Es hilft, das Dokument als eine Reihe modularer Komponenten zu betrachten. Jedes Modul behandelt einen spezifischen Aspekt der Interaktion zwischen Benutzer und KI. Eine robuste KI-Sicherheitsrichtlinie sollte keine statische Liste von Verboten sein. Sie muss ein dynamisches Framework darstellen, das sich an neue Tools und Bedrohungen anpasst. Sie muss Identitäts-, Daten- und Anwendungssicherheit gleichermaßen abdecken.

Die erste Säule ist die Datenklassifizierung. Was man nicht definiert, kann man nicht schützen. Ihre Richtlinie muss explizit festlegen, welche Datenkategorien für die KI-Eingabe zulässig sind. Öffentliche Marketingtexte sind möglicherweise unbedenklich. Kundenbezogene Daten und unveröffentlichter Quellcode hingegen definitiv nicht. Die Richtlinie darf hier keinerlei Unklarheiten lassen. Nutzer müssen genau wissen, wo die Grenze verläuft, bevor sie ein Eingabeaufforderungsfenster öffnen.

Identitäts- und Zugriffsmanagement

Die zweite Säule konzentriert sich darauf, wer die Tools nutzt. Anonymität gefährdet die Sicherheit. Ihre KI-Sicherheitsrichtlinie sollte die Verwendung von Unternehmensidentitäten für alle geschäftsbezogenen KI-Aufgaben vorschreiben. Private E-Mail-Konten sind für die Arbeit im Unternehmen strengstens untersagt. So wird sichergestellt, dass der Zugriff auf Daten und die Interaktionshistorie auch nach dem Ausscheiden eines Mitarbeiters erhalten bleibt. Zudem ermöglicht dies die Integration von Single Sign-On (SSO). SSO bietet einen zentralen Schutzmechanismus, falls ein Konto kompromittiert wird.

Antragsprüfung und -genehmigung

Die dritte Säule befasst sich mit den Tools selbst. Nicht alle KI-Anwendungen sind gleich. Einige erfüllen strenge Sicherheitsstandards für Unternehmen. Andere sind kaum mehr als Datenerfassungsfunktionen mit einer ansprechenden Benutzeroberfläche. Ihre Richtlinie muss einen Prüfprozess festlegen. Dieser Prozess sollte die Datenverarbeitungspraktiken des Anbieters bewerten. Er sollte prüfen, ob Kundendaten für das Training verwendet werden und ob die Einhaltung von Standards wie SOC 2 oder ISO 27001 verifiziert wird. Nur Tools, die diese Prüfung bestehen, sollten zugelassen werden.

Festlegung von Standards für die akzeptable Nutzung von KI

Ein Abschnitt zur zulässigen KI-Nutzung übersetzt übergeordnete Prinzipien in konkrete Handlungsanweisungen für den Arbeitsalltag. Dieser Teil der Richtlinie wird von den Mitarbeitern am häufigsten gelesen. Er muss klar, prägnant und frei von juristischen Fachbegriffen sein. Der Fokus sollte auf dem Verhalten liegen. Es sollten spezifische Szenarien beschrieben werden, denen Nutzer in ihrem Arbeitsalltag begegnen.

Entwickler nutzen KI beispielsweise häufig zum Debuggen von Code. Eine Richtlinie zur akzeptablen Nutzung von KI könnte das Einfügen von Code-Schnipseln erlauben. Das Einfügen proprietärer Algorithmen oder fest codierter API-Schlüssel wäre hingegen strikt verboten. Marketingteams könnten KI zum Verfassen von E-Mails verwenden. Die Richtlinie würde dies zwar zulassen, aber eine manuelle Überprüfung des finalen Textes auf Richtigkeit und Tonfall vorschreiben. Diese praktischen Beispiele helfen Mitarbeitern zu verstehen, wie sie die Regeln in ihrem jeweiligen Kontext anwenden können.

Das „Ampel“-Protokoll

Um die Entscheidungsfindung zu vereinfachen, verwenden viele Organisationen in ihren Richtlinien zur akzeptablen Nutzung von KI ein Ampelsystem.

- Grün (Genehmigt): Diese Tools verfügen über Unternehmenslizenzen. Datenschutzvereinbarungen wurden unterzeichnet. Mitarbeiter können sie für die meisten Datentypen frei verwenden, ausgenommen streng geheime Informationen.

- Gelb (Toleriert): Dies sind öffentliche Tools, die zwar nützlich sind, aber keine unternehmensweiten Kontrollmechanismen bieten. Die Nutzung ist nur für unkritische Aufgaben zulässig. Es ist keine Anmeldung erforderlich. Die Eingabe interner Daten ist nicht erlaubt.

- Rot (Blockiert): Diese Tools bergen inakzeptable Risiken. Sie weisen möglicherweise eine Vorgeschichte von Sicherheitslücken oder aggressiven Datensammelpraktiken auf. Der Zugriff ist technisch auf Browser- oder Netzwerkebene blockiert.

Umgang mit den Sicherheitsrisiken generativer KI

Generative KI birgt einzigartige Risiken, die von herkömmlichen Softwarerichtlinien nicht abgedeckt werden. Die interaktive Natur großer Sprachmodelle (LLMs) schafft neue Angriffsvektoren. Eine spezialisierte Sicherheitsrichtlinie für generative KI muss diese spezifischen Bedrohungen berücksichtigen. Es genügt nicht, den Zugriff zu sichern; die Interaktion selbst muss geschützt werden.

Ein Hauptproblem ist die sogenannte Prompt-Injection. Diese tritt auf, wenn schädliche Anweisungen in einem Textblock versteckt sind. Fügt ein Mitarbeiter diesen Text in ein LLM ein, kann das Modell dazu verleitet werden, seine Sicherheitsvorkehrungen zu ignorieren. Ihre Richtlinie muss Benutzer davor warnen, nicht vertrauenswürdige Inhalte aus dem Internet direkt in interne KI-Tools einzufügen. Externer Text sollte mit dem gleichen Misstrauen behandelt werden wie ein E-Mail-Anhang von einem unbekannten Absender.

Umgang mit Halluzinationen und Sicherstellung der Ergebnisintegrität

Ein weiterer kritischer Aspekt einer Sicherheitsrichtlinie für generative KI ist die Validierung der Ergebnisse. KI-Modelle arbeiten probabilistisch, nicht deterministisch. Sie können falsche Informationen fälschlicherweise als Fakten darstellen. Dieses Phänomen wird als Halluzination bezeichnet. Die Verwendung ungeprüfter KI-Ergebnisse bei wichtigen Geschäftsentscheidungen kann zu finanziellen Verlusten und Reputationsschäden führen. Die Richtlinie muss daher für alle wichtigen Ergebnisse eine menschliche Überprüfung vorschreiben. Von KI generierter Code muss von einem erfahrenen Entwickler geprüft werden. Von KI erstellte Rechtsdokumente müssen von einem Rechtsanwalt verifiziert werden.

Häufige Verstöße gegen KI-Sicherheitsrichtlinien in Unternehmensumgebungen

KI-Sicherheitspolitik und Governance-Rahmen

Ad-hoc-Regeln sind ein guter Anfang, doch langfristige Resilienz erfordert einen strukturierten Ansatz. Die Ausrichtung an internationalen Standards hebt Ihre KI-Sicherheitsrichtlinie von einer bloßen Regelsammlung zu einem Managementsystem auf. Dies beweist gegenüber Aufsichtsbehörden, Kunden und Vorstandsmitgliedern Ihre Sorgfaltspflicht. Der Fokus verlagert sich von reaktiver Schadensbegrenzung hin zu proaktivem Risikomanagement.

Zwei Rahmenwerke prägen derzeit die Branchendiskussion: ISO 42001 und das NIST AI Risk Management Framework (RMF). Die Übernahme von Elementen dieser Standards gewährleistet eine umfassende und nachvollziehbare KI-Sicherheitsrichtlinie und Governance-Strategie. Sie schafft eine gemeinsame Sprache für die unternehmensweite Diskussion über KI-Risiken.

Implementierung von ISO 42001

ISO 42001 ist der globale Standard für KI-Managementsysteme. Er folgt dem bekannten PDCA-Zyklus (Planen, Durchführen, Überprüfen, Anpassen), der auch in anderen ISO-Normen Anwendung findet. Für eine KI-Sicherheitsrichtlinie und ein Governance-Programm sind die Abschnitte „Führung“ und „Betrieb“ oft die relevantesten.

- Führung: Diese Klausel verpflichtet die oberste Führungsebene, die Verantwortung für die Effektivität des KI-Managementsystems zu übernehmen. Sie stellt sicher, dass die notwendigen Ressourcen verfügbar sind und die Richtlinie mit den strategischen Geschäftszielen übereinstimmt.

- Funktion: Diese Klausel konzentriert sich auf die Bewertung und Behandlung von KI-Risiken. Sie verpflichtet Organisationen, potenzielle unbeabsichtigte Folgen von KI-Systemen zu identifizieren und Kontrollmaßnahmen zu deren Minderung zu implementieren.

Anwendung des NIST AI RMF

Das NIST AI RMF ist ein freiwilliges Rahmenwerk, das im öffentlichen und privaten Sektor der USA hohes Ansehen genießt. Es basiert auf vier Kernfunktionen: Steuerung, Kartierung, Messung und Management.

- Steuerung: Diese Funktion fördert eine Kultur des Risikomanagements. Sie umfasst die Festlegung der Richtlinien und Verfahren, die die Entwicklung und Nutzung von KI steuern.

- Karte: Diese Funktion stellt den Kontext her. Sie identifiziert die spezifischen KI-Systeme, die zum Einsatz kommen, und die damit verbundenen potenziellen Risiken.

- Messung: Diese Funktion nutzt quantitative und qualitative Methoden zur Risikoanalyse. Sie beantwortet die Frage: „Wie hoch ist das tatsächliche Risiko, das wir tragen?“

- Management: Diese Funktion priorisiert und behandelt die Risiken. Sie umfasst den Einsatz spezifischer Kontrollmechanismen, wie beispielsweise der Richtlinie zur akzeptablen Nutzung von KI, um das Risiko auf ein akzeptables Niveau zu senken.

Die Rolle der Browsersicherheit bei der Durchsetzung

Die Erstellung einer KI-Richtlinie für Unternehmen ist nur die halbe Miete. Ihre Durchsetzung ist die andere Hälfte. Herkömmliche Netzwerksicherheitstools stoßen bei der modernen KI-Nutzung an ihre Grenzen. Sie können zwar eine Domain blockieren, aber sie haben keinen Einblick in die Vorgänge innerhalb der Sitzung. Sie können nicht unterscheiden, ob ein Benutzer ChatGPT nach einem Cookie-Rezept fragt oder eine Kundendatenbank einfügt. Dieser Mangel an Granularität führt zu übermäßiger Blockierung oder gefährlichen Sicherheitslücken.

Der Browser bildet die neue Sicherheitsbarriere. Er ist die Schnittstelle, über die nahezu alle modernen Arbeitsabläufe stattfinden. Um eine KI-Sicherheitsrichtlinie effektiv durchzusetzen, benötigen Sie im Browser selbst integrierte Kontrollmechanismen. Dies ermöglicht die Echtzeitanalyse von Nutzeraktionen und kontextbezogene Entscheidungen, die Sicherheit und Produktivität in Einklang bringen. Anstelle eines binären „Blockieren oder Zulassen“ bietet die Browsersicherheit differenzierte Steuerungsmöglichkeiten wie „Nur-Lese-Zugriff zulassen“ oder „Zulassen, aber sensible Daten schwärzen“.

Richtlinienautomatisierung mit LayerX

LayerX bietet die technischen Möglichkeiten, Ihre KI-Sicherheitsrichtlinie in die Praxis umzusetzen. Es fungiert als Browsererweiterung für Unternehmen. Diese einzigartige Position ermöglicht es, Benutzerinteraktionen mit beliebigen Webanwendungen zu überwachen und zu steuern, einschließlich genehmigter und nicht genehmigter KI-Tools. LayerX setzt Ihre Governance-Strategie durch.

Eine der Kernfunktionen von LayerX ist die Erkennung von „Schatten-KI“. Es katalogisiert automatisch alle KI-Websites, auf die Ihre Mitarbeiter zugreifen. So erhalten Sie ein umfassendes Inventar, das Ihnen genau zeigt, welche Tools im Einsatz sind. Diese Transparenz ist unerlässlich, um Ihre KI-Sicherheitsrichtlinie zu aktualisieren und relevant zu halten. Man kann nur kontrollieren, was man kennt. LayerX bringt Licht in die verborgenen Bereiche Ihres SaaS-Ökosystems.

Echtzeit-DLP und Bildung

LayerX geht über die einfache Erkennung hinaus. Es bietet aktive Funktionen zur Verhinderung von Datenverlust (DLP), die speziell für GenAI entwickelt wurden. Versucht ein Benutzer, Daten einzufügen, die gegen die Nutzungsrichtlinien für KI verstoßen, greift LayerX ein. Der Einfügevorgang kann vollständig blockiert werden. Zudem können sensible Zeichenketten wie Kreditkartennummern oder personenbezogene Daten (PII) gezielt geschwärzt werden, während der Rest der Eingabeaufforderung weiterläuft. So können Mitarbeiter das Tool sicher nutzen, ohne das Unternehmen einem Risiko auszusetzen. Darüber hinaus kann LayerX ein benutzerdefiniertes Popup anzeigen, das den Verstoß erläutert. Dadurch wird jede blockierte Aktion zu einem kurzen Lernmoment, der die KI-Sicherheitsrichtlinien in Echtzeit festigt.

Checkliste zur Umsetzung der KI-Sicherheitsrichtlinie

Nutzen Sie die folgende Checkliste, um sicherzustellen, dass Ihre Richtlinie alle kritischen Bereiche abdeckt. Diese Tabelle ordnet spezifische Richtlinienbestandteile den technischen Kontrollen zu, die zu deren Durchsetzung erforderlich sind.

| Richtlinienkomponente | Schlüsselanforderung | LayerX-Durchsetzungsfähigkeit |

| Werkzeugbestand | Führen Sie eine aktuelle Liste der zugelassenen und gesperrten Tools. | Echtzeit-Erkennung von Schatten-SaaS- und KI-Anwendungen im gesamten Unternehmen. |

| Daten-DLP | Definieren Sie spezifische Datentypen, die von der KI-Eingabe ausgeschlossen sind. | Verhindern des Einfügens oder Hochladens bestimmter sensibler Datentypen |

| Identitätsmanagement | Unternehmensweite SSO-Registrierung für alle KI-Konten vorschreiben. | Die Nutzung privater E-Mail-Konten für geschäftliche Anwendungen erkennen und blockieren. |

| Erweiterungssteuerung | Überprüfen Sie alle Browser-Plugins, die auf KI-Daten zugreifen. | Risikobewertung und Blockierung schädlicher oder riskanter Erweiterungen. |

| Buchungskontrolle | Alle Eingabeaufforderungen und KI-Interaktionen sind zur Gewährleistung der Compliance zu protokollieren. | Detaillierte forensische Protokolle der Benutzer-KI-Interaktionen für Prüfungszwecke |

| Rollenbasierter Zugriff | Definiere, wer welches Werkzeug wie benutzen darf. | Zugriffsrichtlinien basierend auf Benutzergruppen und Active Directory durchsetzen. |

Wir freuen uns auf die Einführung von KI in der Unternehmenssicherheit

Die Einführung generativer KI ist kein vorübergehender Trend, sondern ein grundlegender Wandel in der Geschäftswelt. Ihre KI-Richtlinie ist der Mechanismus, der Ihrem Unternehmen ermöglicht, diesen Wandel sicher zu gestalten. Es geht nicht darum, Hürden zu errichten, sondern Leitplanken zu bauen. Indem Sie klare Richtlinien für die zulässige KI-Nutzung definieren und diese durch strenge technische Kontrollen absichern, befähigen Sie Ihre Mitarbeiter zu Innovationen.

Sicherheit im KI-Zeitalter erfordert eine Kombination aus klarer Governance und deren konsequenter Durchsetzung. Eine statische KI-Sicherheitsrichtlinie ist ein guter Ausgangspunkt, muss aber in die Praxis umgesetzt werden. LayerX bietet die notwendige Transparenz und Kontrolle auf Browserebene, um Ihre Richtlinie wirksam zu gestalten. Es schließt die Lücke zwischen Dokument und Nutzer und stellt sicher, dass Ihre Maßnahmen zur KI-Sicherheit und -Governance tatsächlich zu einer Risikominderung führen. Beginnen Sie mit Transparenz, definieren Sie Ihre Regeln und setzen Sie diese direkt am Netzwerkrand durch. Dies ist der Weg zu einer sicheren KI-Einführung.