Effektive Sicherheit erfordert heute, dass wir nicht nur die Modelle selbst, sondern auch die Interaktion der Mitarbeiter mit generativen Modellen kontrollieren. Die zehn wichtigsten KI-Governance-Praktiken für 2026 konzentrieren sich auf die Absicherung der letzten Meile der Nutzerakzeptanz, also des Übergangs von Daten aus dem Unternehmen in den Browser.

Was sind KI-Governance-Praktiken und warum sind sie wichtig?

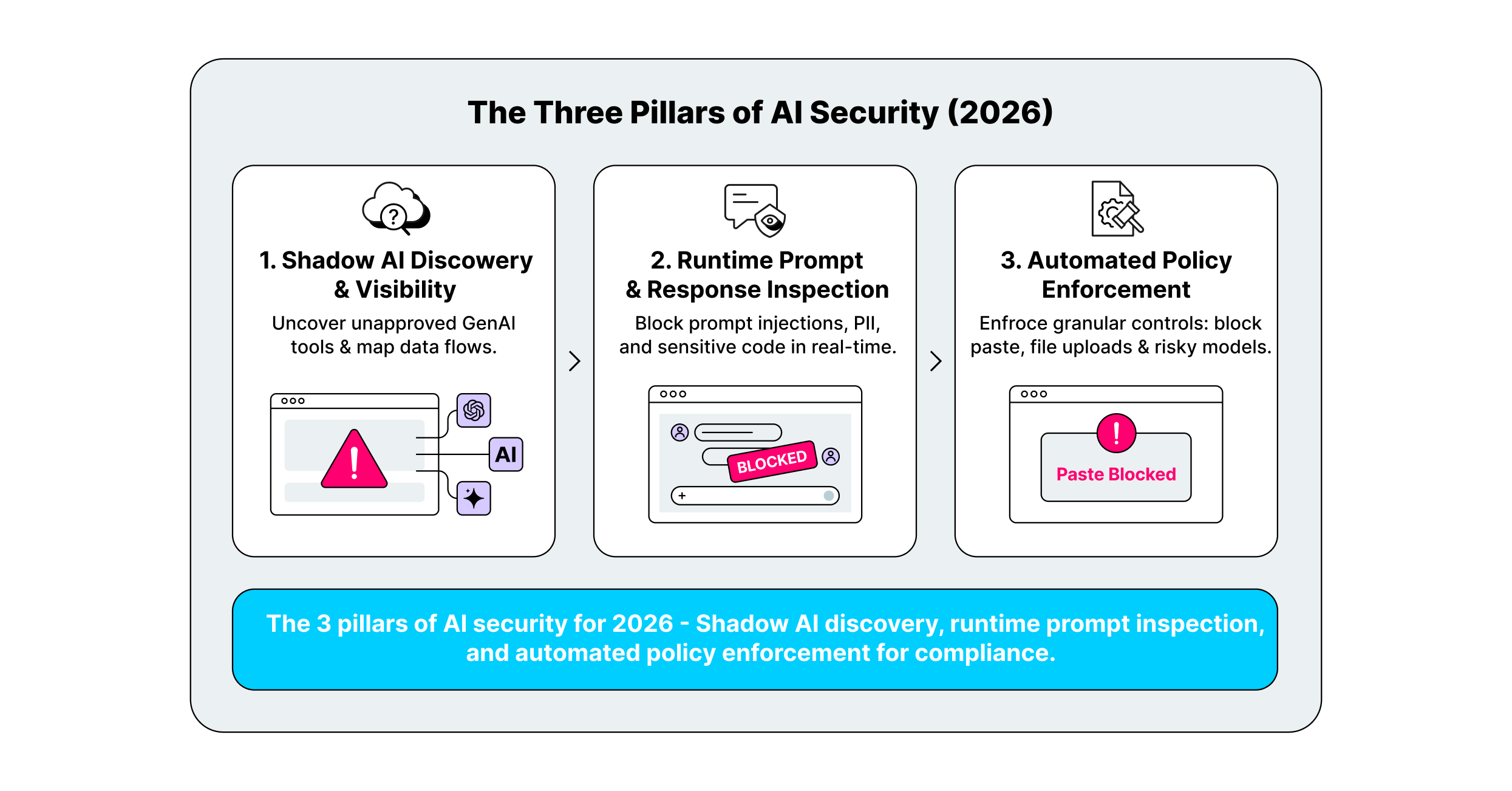

KI-Governance ist kein theoretisches Rahmenwerk mehr, sondern ein aktiver Sicherheitsworkflow zur Bewältigung der Risiken des Einsatzes generativer KI. Diese Praktiken verlagern den Fokus von der Validierung von Modellgewichten hin zur Kontrolle des Einsatzzeitpunkts. Sicherheitsteams müssen nun genau den Moment kontrollieren, in dem ein Mitarbeiter Kundendaten in einen Chatbot einfügt oder eine KI-gestützte Browsererweiterung installiert.

Die größte Schwachstelle moderner Governance liegt in der „letzten Meile“: der Browserschnittstelle, über die Nutzer mit SaaS- und GenAI-Tools interagieren. Herkömmliche Netzwerkverteidigungen können den verschlüsselten Datenverkehr innerhalb einer Chat-Sitzung nicht erfassen, und API-basierte Kontrollen reagieren oft zu spät. Effektive Governance erfordert Echtzeit-Transparenz und -Durchsetzung direkt im Arbeitsbereich des Mitarbeiters, um Datenlecks zu verhindern und schädliche Eingaben zu blockieren, bevor sie verarbeitet werden.

Wichtige Trends in der KI-Governance, die 2026 zu beobachten sind

Der Trend hin zu browserbasierten Sicherheitsfunktionen ist für 2026 prägend. Sicherheitsverantwortliche verabschieden sich von umständlichen Netzwerkproxys, die die Benutzerfreundlichkeit beeinträchtigen, und setzen stattdessen auf schlanke Browsererweiterungen. Diese Tools integrieren sich direkt in den Arbeitsablauf und ermöglichen es Unternehmen, den Kontext von Eingabeaufforderungen zu überwachen, Berechtigungen von Erweiterungen zu prüfen und sensible Daten zu schwärzen, ohne den Datenverkehr umzuleiten.

Eine weitere wichtige Entwicklung ist der Aufstieg identitätsbasierter Governance für autonome KI-Agenten. Da „agentische KI“ zunehmend im Auftrag von Nutzern agiert – beispielsweise Termine bucht, Code schreibt oder Datenbanken abfragt –, stoßen statische Zulassungslisten an ihre Grenzen. Governance-Strategien entwickeln sich weiter, um rollenbasierte Zugriffskontrollen (RBAC) durchzusetzen, die die Aktionen eines KI-Agenten basierend auf den spezifischen Berechtigungen des Nutzers und der Sensibilität der Daten einschränken.

Die 10 besten KI-Governance-Tools für 2026

Nachfolgend sind die wichtigsten Lösungen aufgeführt, die eine sichere KI-Einführung durch Durchsetzung, Transparenz und Risikomanagement ermöglichen.

| Praxis | Schwerpunkte | Am besten geeignet, |

| LayerX | Browserbasierte Durchsetzung | Schließung der Sicherheitslücke auf der „letzten Meile“ |

| Harmonische Sicherheit | Shadow AI Discovery | Vollständige Transparenz über die KI-Einführung erlangen |

| Schnelle Sicherheit | Sofortige Injektionsabwehr | Sicherung von GenAI-Interaktionen vor Missbrauch |

| Lasso-Sicherheit | Rollenbasierte Zugriffssteuerung | Kontextsensitive Richtliniendurchsetzung |

| Einbruch der Dunkelheit KI | Datenverlustprävention (DLP) | Verhinderung von PII/IP-Lecks in Echtzeit |

| AIM Security | KI-Asset-Inventar | Zentralisierte Nachverfolgung aller KI-Tools |

| Zeuge KI | Automatisierte Risikobewertung | Vereinfachung der Genehmigung sicherer KI-Tools |

| Knostisch | Audit- und Compliance-Protokollierung | Erfüllung regulatorischer Anforderungen |

| Polymer | Schulung und Sensibilisierung der Mitarbeiter | Aufbau einer sicherheitsbewussten Kultur |

| Lakera | Kontinuierliche Überwachung | Anomalien und Richtlinienabweichungen erkennen |

1. LayerX

LayerX ist eine Browser-Sicherheitsplattform, die als schlanke Erweiterung fungiert und Kontrollmechanismen direkt dort platziert, wo Nutzer mit KI interagieren. Sie schließt die Sicherheitslücke, indem sie jeden Tastendruck, jede Einfügeaktion und jeden Datei-Upload in Echtzeit überwacht. So können Sicherheitsteams detaillierte Richtlinien durchsetzen, beispielsweise das Einfügen von Quellcode in ChatGPT blockieren oder die Installation riskanter KI-Erweiterungen verhindern, ohne den Arbeitsablauf der Nutzer zu beeinträchtigen oder einen dedizierten Unternehmensbrowser zu erfordern.

Die Plattform bietet umfassende Transparenz hinsichtlich der Nutzung sowohl genehmigter als auch inoffizieller KI („Shadow AI“) auf verwalteten und privaten Geräten. LayerX analysiert den Kontext von Browserinteraktionen, um zwischen sicheren Aufgaben und riskanten Verhaltensweisen zu unterscheiden und so sicherzustellen, dass sensible Unternehmensdaten die Browserumgebung niemals ungeschützt verlassen. Dieser Ansatz ermöglicht es Unternehmen, GenAI-Tools sicher einzuführen, indem Risiken wie Datenexfiltration und Kontoübernahmen direkt an der Quelle minimiert werden.

2. Harmonische Sicherheit

Harmonic Security konzentriert sich auf die Lösung des Problems der Schatten-KI, indem es alle von Mitarbeitern genutzten KI-Tools identifiziert und kategorisiert – unabhängig davon, ob diese formell genehmigt wurden. Anstatt auf statische Sperrlisten zu setzen, analysiert Harmonic mithilfe spezialisierter, kleiner Sprachmodelle die Absicht und den Inhalt von Datenübertragungen. Dadurch kann zwischen harmlosen Anfragen und riskanten Uploads regulierter Daten unterschieden werden. Dies ermöglicht eine standardmäßig sichere Umgebung, in der Mitarbeiter neue Tools nutzen können, ohne das Unternehmen einem Risiko auszusetzen.

Die Plattform erstellt eine umfassende Übersicht über die KI-Nutzung im gesamten Unternehmen und bietet Sicherheitsverantwortlichen einen klaren Einblick, welche Abteilungen welche Tools einsetzen. Durch das Verständnis des Geschäftskontexts der KI-Nutzung unterstützt Harmonic Teams bei der Entwicklung von Richtlinien, die Innovationen fördern und gleichzeitig risikoreiche Anwendungen, die die Sicherheitsstandards nicht erfüllen, automatisch kennzeichnen oder blockieren.

3. Sofortige Sicherheit

Prompt Security ist auf die Abwehr von Prompt-Injection-Angriffen spezialisiert, einer kritischen Sicherheitslücke, bei der manipulierte Eingaben das Verhalten von GenAI beeinflussen. Ihre Lösung überwacht das Document Object Model (DOM) und Benutzereingaben, um Versuche zu erkennen, Modelle zu manipulieren oder Daten über versteckte Befehle abzugreifen. Dadurch ist Prompt Security eine unverzichtbare Verteidigungsebene für Organisationen, die öffentlich zugängliche GenAI-Anwendungen entwickeln oder einsetzen, bei denen Benutzereingaben nicht vollständig vertrauenswürdig sind.

Über den Schutz vor Einschleusungsangriffen hinaus bietet Prompt Security Werkzeuge zur Bereinigung von Eingaben und zur Überprüfung von Ausgaben, um sicherzustellen, dass LLMs nicht unbeabsichtigt schädliche Inhalte erzeugen oder Systemanweisungen offenlegen. Ihre Technologie lässt sich in den Entwicklungsprozess integrieren und unterstützt Entwicklerteams dabei, ihre KI-Funktionen abzusichern, bevor diese in Produktion gehen.

4. Lasso-Sicherheit

Lasso Security bietet kontextbezogene rollenbasierte Zugriffskontrolle (RBAC) für GenAI und stellt so sicher, dass Benutzer nur auf die für ihre jeweilige Funktion relevanten Modelle und Daten zugreifen können. Die Plattform geht über einfache Zugriffsprotokolle hinaus und setzt Richtlinien basierend auf der Identität des Benutzers, der Sensibilität der Daten und dem vorgesehenen Anwendungsfall durch. Diese detaillierte Kontrolle verhindert, dass Zugriffsrechte unkontrolliert erweitert werden und Mitarbeiter weiterhin Zugriff auf leistungsstarke KI-Tools behalten, die sie nicht mehr benötigen.

Die Lösung überwacht zudem Anomalien in Echtzeit, beispielsweise wenn ein Marketingmitarbeiter plötzlich einen Programmierassistenten nach Datenbankzugangsdaten fragt. Durch die Korrelation von Benutzeridentität und Verhaltensmustern hilft Lasso Unternehmen, den internen Missbrauch von KI-Tools zu erkennen und zu unterbinden, bevor es zu einem Datenleck kommt.

5. Nightfall-KI

Nightfall AI revolutioniert den Datenschutz (Data Loss Prevention, DLP) im KI-Zeitalter. Mithilfe von Machine-Learning-Detektoren, die auf Millionen von Beispielen trainiert wurden, identifizieren sie sensible Daten mit höchster Präzision. Die Lösung scannt Daten sowohl in Bewegung als auch im Ruhezustand und erkennt personenbezogene Daten (PII), Gesundheitsdaten und vertrauliche Informationen wie API-Schlüssel, bevor diese auf GenAI-Plattformen hochgeladen werden. Die Detektoren von Nightfall sind kontextbezogen und reduzieren Fehlalarme im Vergleich zu herkömmlichen, auf regulären Ausdrücken basierenden DLP-Tools deutlich.

Für die KI-Governance integriert Nightfall Browser- und Cloud-Workflows, um sensible Informationen in Echtzeit zu schwärzen oder zu blockieren. Diese Funktion ermöglicht es Mitarbeitern, Produktivitätstools wie Chatbots zu nutzen und gleichzeitig die Einhaltung von Compliance-Vorgaben wie DSGVO und HIPAA sicherzustellen – selbst bei unstrukturierten Eingabeaufforderungen.

6. AIM-Sicherheit

AIM Security konzentriert sich auf die Erstellung eines vollständigen KI-Asset-Inventars, das als „KI-Stückliste“ für Unternehmen dient. Die Plattform scannt die IT-Umgebung, um alle eingesetzten Modelle, Trainingsdatensätze und KI-integrierten Anwendungen zu ermitteln. Diese zentrale Übersicht ermöglicht es Sicherheitsteams, den Lebenszyklus jedes KI-Assets von der Beschaffung bis zur Außerbetriebnahme zu verfolgen und sicherzustellen, dass keine unkontrollierten „Zombie“-Modelle weiterlaufen.

Durch die Pflege eines Echtzeit-Inventars unterstützt AIM Security Unternehmen bei der Identifizierung von Abhängigkeiten und potenziellen Risiken in der Lieferkette. Wird eine Schwachstelle in einem bestimmten Open-Source-Modell entdeckt, können Administratoren umgehend alle Instanzen dieses Modells in ihrer Infrastruktur lokalisieren und die erforderlichen Patches oder Schutzmaßnahmen einspielen.

7. Zeuge KI

Witness AI bietet eine automatisierte Risikobewertung, um die Evaluierung und Genehmigung neuer KI-Tools zu optimieren. Die Plattform vergibt dynamische Risikobewertungen für Anwendungen basierend auf deren Nutzungsbedingungen, Datenschutzpraktiken und Compliance-Zertifizierungen. So können Sicherheitsteams Anfragen für neue Software schnell prüfen und zeitaufwändige manuelle Prüfungen durch datengestützte Entscheidungen ersetzen.

Die Plattform überwacht zudem kontinuierlich das Risikoprofil zugelassener Tools und benachrichtigt Administratoren, wenn ein Anbieter seine Datenschutzrichtlinie ändert oder ein Sicherheitsvorfall auftritt. Diese fortlaufende Bewertung gewährleistet, dass die Liste der zugelassenen Software des Unternehmens stets aktuell und sicher bleibt.

8. Knostisch

Knostic begegnet der Herausforderung von Audit und Autorisierung, indem es genau protokolliert, wer auf welche Informationen in den KI-Systemen einer Organisation zugreift. Die Lösung beantwortet die Frage nach dem „Need-to-know“-Prinzip und stellt sicher, dass GenAI-Tools bestehende Dateiberechtigungen nicht umgehen, um vertrauliche Dokumente unbefugten Nutzern zugänglich zu machen. Knostic generiert detaillierte Audit-Trails, die Abfragen den spezifischen Dokumenten zuordnen, die zur Generierung der Antwort verwendet wurden.

Diese Transparenz ist unerlässlich für regulierte Branchen, die eine strenge Kontrolle des Informationsflusses nachweisen müssen. Die Autorisierungskontrollen von Knostic verhindern „Wissenslecks“, bei denen ein LLM versehentlich sensible Strategieentscheidungen oder Personaldaten an Mitarbeiter weitergibt, die keinen Zugriff auf diese Informationen haben sollten.

9. Polymer

Polymer verfolgt einen nutzerzentrierten Governance-Ansatz, indem es mithilfe von „Nudges“ und Echtzeit-Schulungen eine sicherheitsbewusste Kultur fördert. Anstatt eine riskante Aktion einfach zu blockieren, greift das System von Polymer mit einem Pop-up ein, das die Sicherheitshinweise erklärt. warum Die Maßnahme ist riskant und schlägt eine sicherere Alternative vor. Diese situative Schulung trägt dazu bei, die ständige Alarmmüdigkeit zu reduzieren und ermutigt Mitarbeiter, sich aktiv am Sicherheitsprozess zu beteiligen.

Ihre Plattform ist besonders effektiv für Unternehmen, die ihre SOC-Teams entlasten möchten. Indem Polymer Nutzern die Möglichkeit gibt, Fehler mit geringem Risiko selbst zu korrigieren, können sich Sicherheitsanalysten auf echte Bedrohungen konzentrieren und gleichzeitig die Datenverarbeitungsgewohnheiten des Unternehmens kontinuierlich verbessern.

10. Lakera

Lakera ist auf kontinuierliche Überwachung und „Red Teaming“ von KI-Anwendungen spezialisiert, um Richtlinienabweichungen und Angriffe zu erkennen. Ihre Plattform Lakera Guard fungiert als Firewall für LLMs und schaltet sich zwischen Benutzer und Modell, um unerwünschte Befehle, Jailbreaks und schädliche Eingaben herauszufiltern. Diese kontinuierlichen Tests gewährleisten, dass KI-Modelle auch bei fortschreitender Entwicklung der Angreifertechniken den Sicherheitsrichtlinien entsprechen.

Lakera bietet zudem eine Datenbank bekannter Angriffsmuster und -vektoren, mit der Unternehmen ihre Abwehrmaßnahmen gegen die neuesten Bedrohungen vergleichen können. Dieser proaktive Ansatz hilft Entwicklern, Schwachstellen in ihren KI-Anwendungen zu identifizieren, bevor diese produktiv eingesetzt werden, und reduziert so das Risiko eines Sicherheitsvorfalls.

Wie man den besten Anbieter für KI-Governance auswählt

- Priorisieren Sie die Transparenz von „Schatten-KI“, um den vollen Umfang der unkontrollierten Tools zu verstehen, die Ihre Mitarbeiter bereits verwenden.

- Wählen Sie eine Lösung mit browsernativer Durchsetzung, um Daten direkt bei der Eingabe zu sichern, ohne den Datenverkehr über komplexe Proxys zu leiten.

- Stellen Sie sicher, dass das Tool detaillierte, identitätsbasierte Kontrollmöglichkeiten bietet, damit Sie unterschiedliche Zugriffsebenen für Entwickler, Personalabteilung und Marketing aktivieren können.

- Achten Sie auf automatisierte Korrekturfunktionen, die sensible Daten in Echtzeit unkenntlich machen können, anstatt einfach die gesamte Anwendung zu blockieren.

- Vergewissern Sie sich, dass der Anbieter kontinuierliche Compliance-Audits unterstützt, um regulatorische Standards wie ISO 42001 und den EU-AI-Act zu erfüllen.

Häufig gestellte Fragen

Was bedeutet KI-Governance in praktischen Sicherheitskontexten?

In der Praxis umfasst KI-Governance die technischen Kontrollen und Richtlinien, die festlegen, wie Mitarbeiter und Anwendungen mit generativer KI interagieren. Dazu gehört die Überwachung von Abfragen nach sensiblen Daten, die Überprüfung der Sicherheitslage von KI-Anbietern und die Gewährleistung, dass KI-generierte Ergebnisse korrekt und sicher sind.

Worin unterscheidet sich KI-Governance von der Sicherheit von KI-Modellen?

Die Sicherheit von KI-Modellen konzentriert sich auf den Schutz der Gewichte, Parameter und der Infrastruktur des Modells selbst vor Diebstahl oder Manipulation. Die KI-Governance ist umfassender und konzentriert sich auf die Verwendung des Modells; Sicherstellung, dass die eingespeisten Daten konform sind, die Benutzer, die darauf zugreifen, autorisiert sind und die Geschäftsrisiken der Implementierung beherrscht werden.

Was sollten wir zuerst kontrollieren: Eingabeaufforderungen, Dateien oder den Zugriff auf Werkzeuge?

Sie sollten zunächst die Sichtbarkeit und den Zugriff auf Tools kontrollieren. Was man nicht sieht, kann man nicht kontrollieren. Daher ist die Identifizierung der verwendeten Tools (Shadow AI) der grundlegende Schritt. Sobald die Transparenz gewährleistet ist, können Sie Kontrollen für Eingabeaufforderungen und Datei-Uploads implementieren, um Datenlecks zu verhindern.

Benötigen wir einen dedizierten Unternehmensbrowser für die KI-Governance?

Nein, Sie benötigen keinen speziellen Unternehmensbrowser. Moderne Browser-Sicherheitsplattformen wie LayerX funktionieren als Erweiterungen, die auf Standardbrowsern wie Chrome und Edge aufgesetzt werden. So können Sie Governance- und Sicherheitskontrollen auf Unternehmensniveau implementieren, ohne dass Benutzer auf eine neue, ungewohnte Browseroberfläche umsteigen müssen.

Wie misst man die Effektivität der KI-Governance?

Die Effektivität wird anhand der Reduzierung von „Schatten-KI“-Vorfällen, der Geschwindigkeit der Genehmigung neuer sicherer Tools und der Anzahl verhinderter Datenlecks gemessen. Erfolgreiche Governance sollte auch anhand der Nutzerakzeptanzraten überprüft werden; umgehen Mitarbeiter Kontrollen, um ihre Aufgaben zu erledigen, muss die Governance-Strategie angepasst werden.