Die Einführung generativer KI verändert Unternehmen grundlegend. Diese leistungsstarken Modelle ermöglichen beispiellose Produktivitätssteigerungen, bringen aber auch einen erheblichen Nachteil mit sich: eine neue und komplexe Angriffsfläche. Unternehmen stellen fest, dass die unkontrollierte Nutzung von GenAI-Tools für Mitarbeiter kritische Risiken birgt, darunter die Exfiltration sensibler personenbezogener Daten, der Verlust geistigen Eigentums und Compliance-Verstöße. Eine gründliche KI-Risikobewertung ist daher der grundlegende Schritt für jedes Unternehmen, das die Leistungsfähigkeit von KI sicher nutzen möchte.

Viele Sicherheitsverantwortliche befinden sich in einer schwierigen Lage. Wie quantifizieren Sie die Risiken, die entstehen, wenn ein Mitarbeiter proprietären Code in ein öffentliches LLM einfügt? Welche tatsächlichen Auswirkungen hat es, wenn ein Team auf ein ungeprüftes „Schatten-KI“-Tool setzt? Dieser Artikel bietet einen strukturierten Ansatz zur Beantwortung dieser Fragen. Wir untersuchen ein praktisches Rahmenwerk zur KI-Risikobewertung, bieten eine umsetzbare Vorlage, untersuchen die für die Durchsetzung erforderlichen Tools und skizzieren Best Practices für die Erstellung eines nachhaltigen KI-Governance-Programms. Eine proaktive, generative KI-Risikobewertung ist nicht länger optional, sondern für sichere Innovationen unerlässlich.

Warum eine spezialisierte KI-Sicherheitsrisikobewertung unverzichtbar ist

Herkömmliche Risikomanagement-Frameworks sind nicht auf die besonderen Herausforderungen der generativen KI ausgelegt. Die interaktive Blackbox-Natur von Large Language Models (LLMs) führt zu dynamischen Bedrohungsvektoren, die mit herkömmlichen Sicherheitslösungen kaum zu bewältigen sind. Eine spezialisierte KI-Sicherheitsrisikobewertung ist unerlässlich, da die Risiken grundlegend anders und flexibler sind als bei herkömmlicher Software.

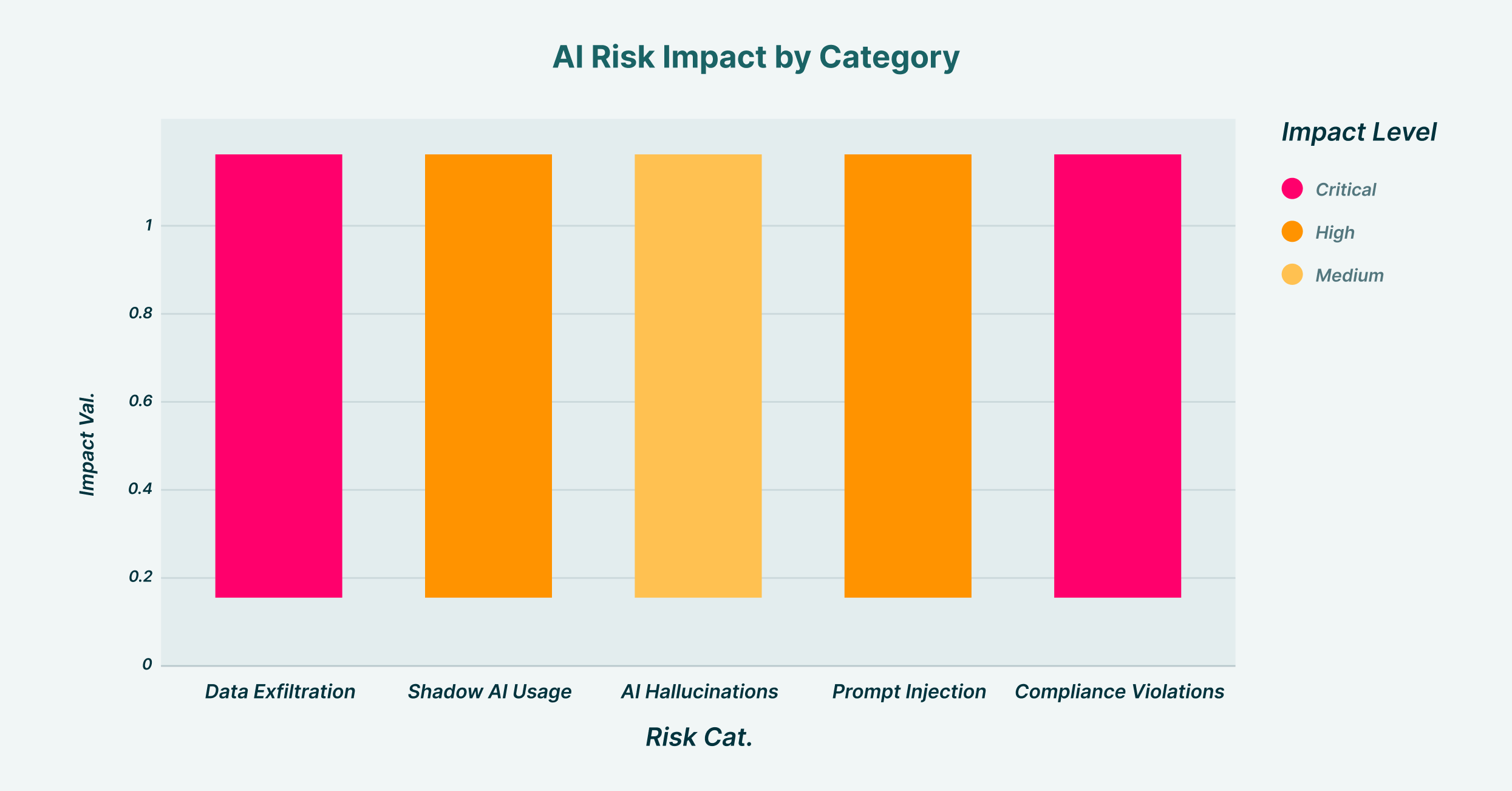

KI-Risikokategorien nach Auswirkungsniveau

Zu den zentralen Herausforderungen, die eine spezielle Bewertung erforderlich machen, gehören:

- Datenschutz und Datenexfiltration: Dies ist wohl das unmittelbarste und größte Risiko. Ohne entsprechende Kontrollen können Mitarbeiter vertrauliche Unternehmensdaten problemlos in öffentliche GenAI-Plattformen kopieren und einfügen. Dazu können Kundenlisten, Finanzprognosen, unveröffentlichter Quellcode oder M&A-Strategiedokumente gehören. Sobald diese Daten an ein öffentliches LLM übermittelt werden, verliert das Unternehmen die Kontrolle darüber, und sie können zum Trainieren zukünftiger Versionen des Modells verwendet werden.

- Schatten-KI und nicht genehmigte Nutzung: Die Verfügbarkeit browserbasierter KI-Tools bedeutet, dass jeder Mitarbeiter eine neue Anwendung ohne Wissen oder Genehmigung der IT-Abteilung nutzen kann. Dieses „Shadow SaaS“-Phänomen schafft massive Sicherheitslücken. Eine effektive KI-Strategie zur Risikobewertung muss mit der Erfassung und Abbildung der gesamten KI-Nutzung im gesamten Unternehmen beginnen, nicht nur der offiziell genehmigten Tools.

- Ungenaue Ergebnisse und „Halluzinationen“: GenAI-Modelle können zwar zuverlässige, aber völlig falsche Informationen liefern. Wenn ein Mitarbeiter KI-generierten Code verwendet, der einen subtilen Fehler enthält, oder eine strategische Entscheidung auf der Grundlage eines gefälschten Datenpunkts trifft, kann dies schwerwiegende Folgen haben. Dieser Risikovektor beeinträchtigt die Betriebsintegrität und die Geschäftskontinuität.

- Prompte Injection und böswillige Nutzung: Bedrohungsakteure suchen aktiv nach Möglichkeiten, GenAI zu manipulieren. Durch sorgfältig gestaltete Eingabeaufforderungen könnte ein Angreifer ein KI-Tool dazu bringen, ausgeklügelte Phishing-E-Mails, Malware oder Desinformationen zu generieren. Stellen Sie sich ein Szenario vor, in dem ein kompromittiertes Mitarbeiterkonto zur Interaktion mit einem internen KI-Assistenten verwendet wird und dieser angewiesen wird, Daten zu exfiltrieren, indem er sie als Routinebericht tarnt.

- Compliance- und geistige Eigentumsrisiken: Die rechtlichen Rahmenbedingungen für KI sind komplex. Der Einsatz eines GenAI-Tools, das auf urheberrechtlich geschütztes Material trainiert wurde, kann Unternehmen mit Ansprüchen wegen Urheberrechtsverletzungen konfrontieren. Darüber hinaus kann die Eingabe von Kundendaten in ein LLM ohne entsprechende Einwilligung oder Sicherheitsmaßnahmen zu empfindlichen Strafen gemäß DSGVO und CCPA führen.

Erstellen Sie Ihr KI-Risikobewertungsframework

Ein planloser Ansatz zur KI-Sicherheit ist zum Scheitern verurteilt. Ein KI-Risikobewertungsrahmen bietet einen systematischen, wiederholbaren Prozess zur Identifizierung, Analyse und Eindämmung von GenAI-bezogenen Bedrohungen. Dieser strukturierte Ansatz stellt sicher, dass alle potenziellen Risiken berücksichtigt und die Kontrollen unternehmensweit einheitlich angewendet werden.

Ein umfassender Rahmen sollte um fünf Kernphasen herum aufgebaut sein:

- Inventarisierung und Erkennung: Das oberste Sicherheitsprinzip ist Transparenz. Man kann nicht schützen, was man nicht sieht. Der erste Schritt besteht darin, ein vollständiges Inventar aller von Mitarbeitern genutzten GenAI-Anwendungen und -Plattformen zu erstellen. Dies umfasst sowohl unternehmenseigene Tools als auch die Schatten-KI-Dienste, auf die direkt über den Browser zugegriffen wird. Diese Phase ist entscheidend, um den wahren Umfang des KI-Fußabdrucks Ihres Unternehmens zu verstehen.

- Risikoidentifizierung und -analyse: Sobald Sie Ihr Inventar erstellt haben, besteht der nächste Schritt darin, jede Anwendung zu analysieren, um potenzielle Bedrohungen zu identifizieren. Berücksichtigen Sie bei jedem Tool, auf welche Datentypen es zugreifen kann und wie diese missbraucht werden könnten. Beispielsweise hat ein KI-gestützter Code-Assistent ein anderes Risikoprofil als ein KI-Bildgenerator. Diese Analyse sollte kontextbezogen sein und das Tool mit bestimmten Geschäftsprozessen und Datensensibilitäten verknüpfen.

- Folgenabschätzung: Nachdem Sie die Risiken identifiziert haben, müssen Sie deren potenzielle geschäftliche Auswirkungen quantifizieren. Dazu müssen Sie das Worst-Case-Szenario für jedes Risiko anhand mehrerer Faktoren bewerten: finanzielle (z. B. Bußgelder, Kosten für die Reaktion auf Vorfälle), Reputationsrisiken (z. B. Verlust des Kundenvertrauens), betriebliche Risiken (z. B. Geschäftsunterbrechung) und rechtliche Risiken (z. B. Rechtsstreitigkeiten, Verletzung des geistigen Eigentums). Die Vergabe eines Auswirkungswerts (z. B. hoch, mittel, niedrig) hilft bei der Priorisierung der Risiken, die zuerst angegangen werden müssen.

- Entwurf und Implementierung von Kontrollen: Hier wird die Risikobewertung in die Tat umgesetzt. Basierend auf der Risikoanalyse und Folgenabschätzung entwerfen und implementieren Sie spezifische Sicherheitskontrollen. Dabei handelt es sich nicht nur um Richtlinien, sondern um technische Leitplanken, die durch Technologie durchgesetzt werden. Für GenAI könnten Kontrollen Folgendes umfassen:

- Blockieren des Zugriffs auf risikoreiche, nicht überprüfte KI-Websites.

- Verhindern Sie das Einfügen sensibler Datenmuster (wie API-Schlüssel, PII oder interne Projektcodenamen) in eine GenAI-Eingabeaufforderung.

- Beschränkung des Hochladens von Dateien auf KI-Plattformen.

- Erzwingen von Nur-Lese-Berechtigungen, um die Datenübertragung zu verhindern.

- Anzeige von Warnmeldungen in Echtzeit, um Benutzer auf riskante Aktionen aufmerksam zu machen.

- Überwachung und kontinuierliche Überprüfung: Das GenAI-Ökosystem entwickelt sich rasant weiter. Wöchentlich tauchen neue Tools und neue Bedrohungen auf. Eine KI-Risikobewertung ist kein einmaliges Projekt, sondern ein kontinuierlicher Lebenszyklus. Ihr Rahmenwerk muss Vorkehrungen für die kontinuierliche Überwachung der KI-Nutzung und regelmäßige Überprüfungen Ihrer Risikobewertungen und -kontrollen enthalten, um deren Wirksamkeit zu gewährleisten.

Ihre umsetzbare Vorlage zur KI-Risikobewertung

Um die Theorie in die Praxis umzusetzen, ist eine standardisierte Vorlage zur KI-Risikobewertung von unschätzbarem Wert. Sie stellt sicher, dass Bewertungen abteilungs- und anwendungsübergreifend einheitlich durchgeführt werden. Eine einfache Tabelle kann zwar ein Ausgangspunkt sein, das Ziel ist jedoch die Erstellung eines lebendigen Dokuments, das Ihre Sicherheitslage aufzeigt.

Hier ist eine Beispielvorlage, die Ihr funktionsübergreifendes KI-Governance-Team anpassen und verwenden kann.

| KI-Anwendung | Geschäftsanwendungsfall | Datensensibilität | Identifizierte Risiken | Wahrscheinlichkeit | Auswirkungen | Risiko-Score | Minderungskontrollen | Restrisiko |

| Öffentlicher ChatGPT-4 | Allgemeine Inhaltserstellung, Zusammenfassung | Öffentlich, Intern (nicht vertraulich) | Datenexfiltration, ungenaue Ausgaben | Hoch | Medium | Hoch | Blockieren des Einfügens sensibler Datenmuster (z. B. PII, „Project Phoenix“), Benutzerschulung | Niedrig |

| Nicht genehmigter PDF-Analysator | Externe Berichte zusammenfassen | Unbekannt, möglicherweise vertraulich | Schatten-KI, Malware-Risiko, Datenlecks | Medium | Hoch | Hoch | Anwendungszugriff vollständig blockieren | N / A |

| GitHub-Copilot | Codegenerierung und Unterstützung | Proprietärer Quellcode | IP-Leck, Vorschläge für unsicheren Code | Hoch | Hoch | Kritische | Aktivität überwachen, Hochladen wichtiger Repository-Dateien verhindern, Code-Scan | Medium |

| Sanktionierter interner LLM | Interne Wissensdatenbankabfragen | Intern, Vertraulich | Sofortige Injektion, Insider-Bedrohung | Niedrig | Medium | Niedrig | Rollenbasierte Zugriffskontrolle (RBAC), Audit-Protokolle | Niedrig |

Diese Vorlage dient als Ausgangspunkt für jede generative KI-Risikobewertung und zwingt die Teams, den spezifischen Kontext der Verwendung jedes Tools zu durchdenken und zu überlegen, welche spezifischen Kontrollen erforderlich sind, um das Risiko auf ein akzeptables Niveau zu reduzieren.

Von manuellen Tabellenkalkulationen zu einem speziellen KI-Risikobewertungstool

Eine manuelle Vorlage zur KI-Risikobewertung ist zwar ein guter erster Schritt, hat aber auch ihre Grenzen. Tabellenkalkulationen sind statisch, schwer zu pflegen und bieten keine Echtzeit-Durchsetzungsmöglichkeiten. Mit zunehmender KI-Nutzung in Ihrem Unternehmen benötigen Sie ein dediziertes KI-Risikobewertungstool, um von einer reaktiven zu einer proaktiven Sicherheitsstrategie zu wechseln. Der Markt für KI-Risikotools wächst, aber nicht alle sind gleich.

Berücksichtigen Sie bei der Bewertung eines KI-Risikobewertungstools diese Kategorien:

- SaaS Security Posture Management (SSPM): Diese Tools sind effektiv, um genehmigte SaaS-Anwendungen zu erkennen und Fehlkonfigurationen zu identifizieren. Allerdings fehlt ihnen oft der Einblick in die browserbasierte Nutzung der sogenannten Schatten-KI und sie können Benutzerinteraktionen innerhalb der Anwendung selbst nicht steuern.

- Data Loss Prevention (DLP): Herkömmliche DLP-Lösungen können zwar so konfiguriert werden, dass sensible Datenmuster blockiert werden, verfügen aber oft nicht über das Kontextverständnis moderner Webanwendungen. Sie können möglicherweise nicht zwischen legitimen und riskanten Interaktionen innerhalb einer GenAI-Chat-Oberfläche unterscheiden. Dies kann zu Fehlalarmen führen, die Arbeitsabläufe stören, oder zu übersehenen Bedrohungen.

- Enterprise-Browsererweiterungen: Diese neue Kategorie bietet einen effektiveren Ansatz. Eine sicherheitsorientierte Browsererweiterung, wie die von LayerX, wird direkt im Browser ausgeführt. Dies bietet detaillierte Transparenz und Kontrolle über die Benutzeraktivitäten auf jeder Website, einschließlich GenAI-Plattformen. Mit dieser Lösung können Sicherheitsteams alle Benutzerinteraktionen wie Einfügen, Formularübermittlungen und Uploads überwachen und Richtlinien in Echtzeit durchsetzen. Beispielsweise könnte eine Richtlinie verhindern, dass Mitarbeiter als „Quellcode“ gekennzeichneten Text in ein öffentliches LLM einfügen. Dadurch wird das Risiko von IP-Leaks effektiv verringert, ohne das Tool vollständig zu blockieren. Dies macht die Browsererweiterung zu einem leistungsstarken Tool für die Umsetzung der in Ihrer KI-Sicherheitsrisikobewertung definierten Kontrollen.

Letztendlich besteht die effektivste Strategie oft darin, KI für die Risikobewertung im weiteren Sinne einzusetzen, intelligente Tools zur Automatisierung der Erkennung und Überwachung zu nutzen und gleichzeitig eine Lösung wie LayerX zu verwenden, um granulare, kontextbezogene Richtlinien am Risikopunkt durchzusetzen: dem Browser.

Best Practices für ein nachhaltiges KI-Risikobewertungsprogramm

Eine erfolgreiche GenAI-Sicherheitsstrategie geht über Frameworks und Tools hinaus; sie erfordert einen kulturellen Wandel und die Verpflichtung zur kontinuierlichen Verbesserung. Die folgenden Best Practices können dazu beitragen, dass Ihr KI-Risikobewertungsprogramm sowohl effektiv als auch nachhaltig ist.

- Richten Sie ein funktionsübergreifendes KI-Governance-Komitee ein: KI-Risiken sind nicht nur ein Sicherheitsproblem, sondern auch ein Geschäftsproblem. Ihr Governance-Team sollte Vertreter aus den Bereichen Sicherheit, IT, Recht, Compliance und wichtigen Geschäftsbereichen umfassen. So stellen Sie sicher, dass Risikoentscheidungen mit den Geschäftszielen in Einklang stehen und Richtlinien praktisch umsetzbar sind.

- Entwickeln Sie eine klare Nutzungsrichtlinie (AUP): Mitarbeiter benötigen klare Richtlinien. Die AUP sollte explizit festlegen, welche KI-Tools zugelassen sind, welche Datentypen damit verwendet werden dürfen und welche Verantwortung der Nutzer für die sichere Nutzung trägt. Diese Richtlinie sollte ein direktes Ergebnis Ihres Risikobewertungsprozesses sein.

- Kontinuierliche Benutzerschulung priorisieren: Ihre Mitarbeiter sind die erste Verteidigungslinie. Schulungen sollten über jährliche Compliance-Module hinausgehen und sich auf reale Szenarien konzentrieren. Nutzen Sie lehrreiche Momente in Echtzeit, beispielsweise eine Popup-Warnung, wenn ein Benutzer versucht, vertrauliche Daten einzufügen, um sicheres Verhalten zu fördern.

- Setzen Sie auf einen risikobasierten, granularen Ansatz: Anstatt KI vollständig zu blockieren, was Innovationen hemmen kann, nutzen Sie Ihre Risikobewertung, um granulare Kontrollen anzuwenden. Erlauben Sie Anwendungsfälle mit geringem Risiko, während Sie Aktivitäten mit hohem Risiko streng kontrollieren. Erlauben Sie beispielsweise die Nutzung eines öffentlichen GenAI-Tools für Marketingtexte, blockieren Sie jedoch dessen Nutzung für die Analyse von Finanzdaten. Dieser differenzierte Ansatz ist nur mit einem Tool möglich, das tiefe Einblicke in Benutzeraktionen bietet.

- Integrieren Sie Technologie für die Echtzeit-Durchsetzung: Richtlinien und Schulungen sind zwar wichtig, allein jedoch nicht ausreichend. Zur Durchsetzung der Regeln ist Technologie erforderlich. Eine Enterprise-Browsererweiterung bildet das technische Rückgrat Ihrer AUP, indem sie schriftliche Richtlinien in Echtzeit-Prävention umsetzt und Ihre KI-Risikobewertung zu einem aktiven Abwehrmechanismus statt einem passiven Dokument macht.

Sichern Sie Ihre KI-gestützte Zukunft mit proaktivem Risikomanagement

Generative KI bietet transformatives Potenzial. Um ihre Vorteile jedoch sicher zu nutzen, ist ein proaktiver und strukturierter Ansatz zur Risikobewältigung erforderlich. Durch die Implementierung eines robusten KI-Risikobewertungsrahmens, die Verwendung einer praktischen Vorlage und den Einsatz der richtigen Durchsetzungstools können Unternehmen eine sichere Brücke in eine KI-gestützte Zukunft bauen.

Der Weg beginnt mit Transparenz und führt zur Kontrolle. Der erste Schritt besteht darin, zu verstehen, wo und wie GenAI eingesetzt wird. LayerX bietet die notwendige Transparenz und granulare Kontrolle, um Ihre KI-Risikobewertung von einer Checkliste in ein dynamisches Abwehrsystem zu verwandeln. So kann Ihr Unternehmen selbstbewusst und sicher Innovationen vorantreiben.